Wikipédia sofre com aumento de tráfego causado por robôs de IA

Enciclopédia enfrenta lentidão e crescimento de gastos. "Nosso conteúdo é gratuito, mas nossa infraestrutura não é", diz fundação. Wikipédia sofre com aumento de tráfego causado por robôs de IA

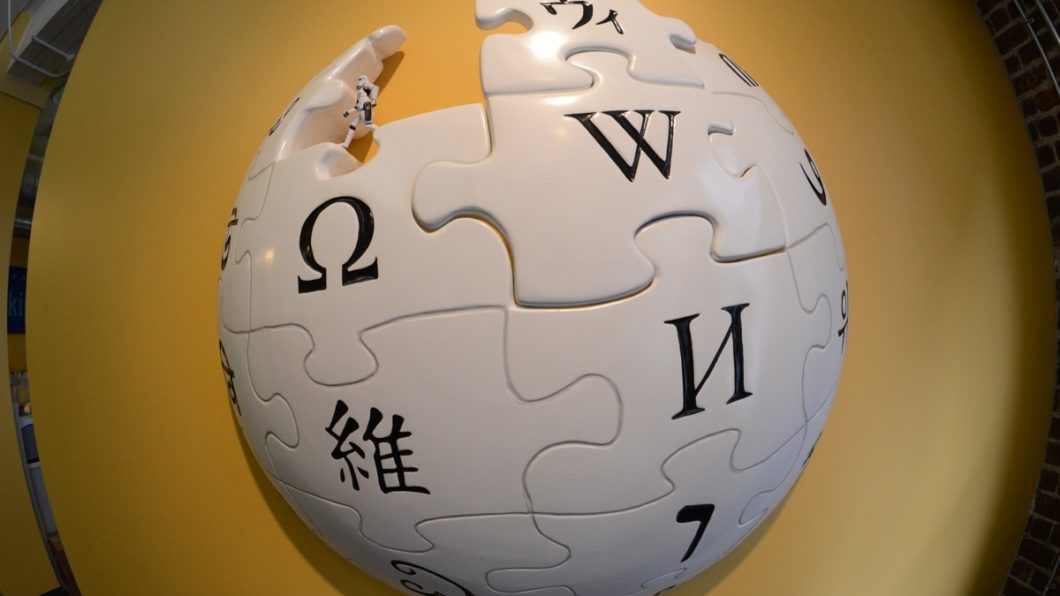

A Wikimedia Foundation, responsável pela Wikipédia e por outros projetos colaborativos, revelou que o uso de banda da Wikimedia Commons teve um aumento de 50% desde janeiro de 2024. Os principais responsáveis por isso são robôs que baixam fotos e vídeos para treinar sistemas de inteligência artificial.

Outros números comprovam o grande número de acessos automatizados. A fundação afirma que 65% do tráfego intensivo de dados tem sido feito por robôs, mas apenas 35% dos acessos a páginas vêm dessas ferramentas.

Qual o problema de robôs acessarem a Wikipédia?

O acesso massivo de robôs ao acervo do Wikimedia Commons tem causado lentidão para os leitores da Wikipédia e aumento de custos para a organização.

O comunicado da Wikimedia Foundation traz um exemplo: em dezembro de 2024, quando o ex-presidente dos Estados Unidos Jimmy Carter morreu, alguns usuários acessaram um vídeo de uma hora e meia, com um debate entre Carter e o também ex-presidente Ronald Reagan.

Em condições normais, isso não seria um problema, já que é possível mudar as rotas das conexões. Mesmo assim, a enciclopédia online sofreu com lentidão, pois seus sistemas estão sendo constantemente usados pelos robôs e é difícil gerenciar este uso.

Além de prejudicar a experiência, os “raspadores” de conteúdo também aumentam os custos da operação. A organização explica que leitores humanos tendem a visitar algumas páginas frequentemente, dependendo dos assuntos em evidência.

Essas páginas mais populares ficam armazenadas em cache, enquanto conteúdos pouco acessados são guardados em data centers. Os bots, porém, acessam todos os conteúdos igualmente, e as requisições encaminhadas a data centers usam uma quantidade maior de recursos.

O que a Wikimedia Foundation pretende fazer?

A fundação responsável pela Wikipédia está estudando maneiras sustentáveis para desenvolvedores e robôs acessarem o conteúdo de suas plataformas.

Para isso, a organização quer aumentar a identificação do tráfego automatizado, exigindo autenticação e autorização para acesso a um grande volume de dados. A meta é reduzir o tráfego gerado por robôs em 20% de volume de requisições e 30% de uso de banda.

Como a Wikimedia Foundation faz questão de dizer em seu comunicado, “nosso conteúdo é gratuito, mas nossa infraestrutura não é”.

Desenvolvedores também têm problemas com bots

A Wikipédia não é a única que está tendo dificuldades com este assunto. Desenvolvedores relatam que robôs usados para treinar IA estão “mentindo” para acessar o conteúdo. Entre as táticas, estão usar IPs residenciais e mudar o agente.

Para lidar com o problema, a CloudFlare, empresa especializada em serviços de internet, criou um “labirinto de IA”. Quando um robô desrespeita as diretrizes, a ferramenta entra em ação e, ironicamente, usa IA para gerar conteúdo falso. Assim, o bot perde tempo e recursos, sem conseguir chegar ao conteúdo verdadeiro.

Com informações da Wikimedia Foundation, TechCrunch e Engadget

Wikipédia sofre com aumento de tráfego causado por robôs de IA

![Como ativar e usar os resumos de notificações da Apple Intelligence [iPhone, iPad e Mac]](https://macmagazine.com.br/wp-content/uploads/2024/12/04-apple-intelligence-iphone-1260x842.jpg?#)

![Como receber apenas notificações prioritárias usando a Apple Intelligence [iPhone e iPad]](https://macmagazine.com.br/wp-content/uploads/2025/03/top_notifications__d2uimve94ro2_large_2x-1260x814.jpg?#)