JFrog : sécurité du machine learning, JFrog ML NVIDIA NIM

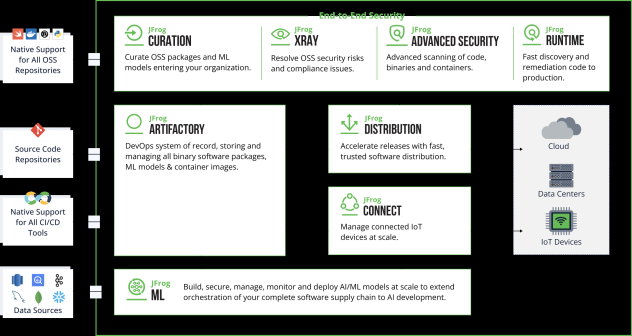

JFrog, éditeur spécialisé dans les solutions de sécurité, a lancé plusieurs outils dédiés à l'IA et au machine learning. Tout d'abord, l'éditeur travaille avec Hugging Face pour améliorer la sécurité et la transparence dans le machine learning, notamment pour mieux scanner les LLM. Un des défis est de garantir l'intégration et la sécurité des LLM que l'on utilise ensemble dans l'IA et le machine learning. « À mesure que les modèles ML deviennent essentiels pour les applications métier critiques, garantir la sécurité de ces modèles est crucial pour prévenir les violations, les fuites de données et les erreurs de prise de décision », a déclaré Asaf Karas, CTO de JFrog Security. « Nous travaillons avec Hugging Face depuis 2023 pour aider à amener les modèles ML en production de manière sécurisée. Nous avons également trouvé des modèles malveillants intentionnels dans Hugging Face au début de 2024, ce qui nous a poussés à consacrer davantage de nos experts en sécurité pour scanner et évaluer l'intégrité de tous les modèles Hugging Face afin de garantir leur sécurité pour une utilisation dans le développement d'applications IA. »Un des défis est l'intégration des LLM. Pour ce faire, on dispose de JFROG Advanced Security et de Xray. Ces deux solutions sont présentes dans la plateforme globale Software Supply Chain. "Ces menaces incluent des attaques par sérialisation de modèles, des CVEs connus, des portes dérobées, et plus encore. Désormais, Hugging Face utilisera les scans JFrog Advanced Security dans son Hugging Face Hub, permettant à chaque modèle contenu dans la plateforme d’être scanné avant d'être téléchargé pour utilisation. Les résultats de chaque scan seront affichés de manière proéminente pour que tous les utilisateurs puissent les voir." précise l'éditeur.Autre annonce récente, JFrog intègre NVIDIA NIM. Pour les développeurs, cela permettra de simplifier l'accès aux plateformes NVIDIA : NIM mais aussi NGC, un hub dédié au machine learning. Pour les développeurs, JFrog promet plusieurs avantages :Flux de travail ML et DevOps unifiés : Les data scientists et les ingénieurs ML peuvent désormais versionner, sécuriser et déployer des modèles en utilisant les mêmes workflows de développement logiciel DevSecOps de JFrog qu'ils connaissent et en lesquels ils ont confiance. Cela élimine le besoin pour les équipes d'utiliser des outils ML distincts tout en garantissant des vérifications automatisées de la conformité, des pistes d'audit et une gouvernance des modèles ML via JFrog Curation.Sécurité et intégrité de bout en bout : Mise en œuvre de scans de sécurité continus sur les conteneurs, les modèles IA et leurs dépendances – fournissant des informations contextuelles sur les microservices NIM – pour identifier les vulnérabilités, complétées par une détection intelligente des menaces axée sur les risques réels et une protection proactive contre les modèles IA et les packages compromis.Performances et évolutivité exceptionnelles des modèles : Optimisation des performances des applications d’IA en utilisant l'infrastructure de calcul accélérée NVIDIA, offrant une faible latence et un haut débit pour un déploiement évolutif des LLM dans des environnements de production à grande échelle. Regrouper facilement les modèles ML avec leurs dépendances pour réduire les exigences externes et utiliser les workflows existants pour un déploiement IA sans faille. De plus, la plateforme JFrog offre des options de déploiement flexibles pour augmenter l'évolutivité, y compris les déploiements auto-hébergés, multi-cloud et en environnement isolé.Enfin, l'éditeur annonce JFrog ML. Cette solution combine MLOps et DevSecOps. L'objectif est de permettre de mieux garantir des modèles plus fiables et plus sécurisées. Ces modèles peuvent ensemble être déployés en production. Catégorie actualité: TechnologiesJFrog, LLMImage actualité AMP:

JFrog, éditeur spécialisé dans les solutions de sécurité, a lancé plusieurs outils dédiés à l'IA et au machine learning. Tout d'abord, l'éditeur travaille avec Hugging Face pour améliorer la sécurité et la transparence dans le machine learning, notamment pour mieux scanner les LLM. Un des défis est de garantir l'intégration et la sécurité des LLM que l'on utilise ensemble dans l'IA et le machine learning.

« À mesure que les modèles ML deviennent essentiels pour les applications métier critiques, garantir la sécurité de ces modèles est crucial pour prévenir les violations, les fuites de données et les erreurs de prise de décision », a déclaré Asaf Karas, CTO de JFrog Security. « Nous travaillons avec Hugging Face depuis 2023 pour aider à amener les modèles ML en production de manière sécurisée. Nous avons également trouvé des modèles malveillants intentionnels dans Hugging Face au début de 2024, ce qui nous a poussés à consacrer davantage de nos experts en sécurité pour scanner et évaluer l'intégrité de tous les modèles Hugging Face afin de garantir leur sécurité pour une utilisation dans le développement d'applications IA. »

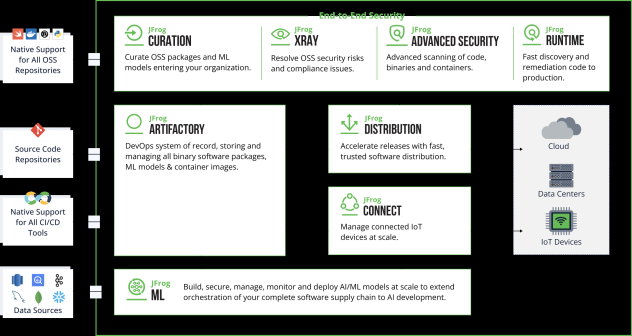

Un des défis est l'intégration des LLM. Pour ce faire, on dispose de JFROG Advanced Security et de Xray. Ces deux solutions sont présentes dans la plateforme globale Software Supply Chain. "Ces menaces incluent des attaques par sérialisation de modèles, des CVEs connus, des portes dérobées, et plus encore. Désormais, Hugging Face utilisera les scans JFrog Advanced Security dans son Hugging Face Hub, permettant à chaque modèle contenu dans la plateforme d’être scanné avant d'être téléchargé pour utilisation. Les résultats de chaque scan seront affichés de manière proéminente pour que tous les utilisateurs puissent les voir." précise l'éditeur.

Autre annonce récente, JFrog intègre NVIDIA NIM. Pour les développeurs, cela permettra de simplifier l'accès aux plateformes NVIDIA : NIM mais aussi NGC, un hub dédié au machine learning.

Pour les développeurs, JFrog promet plusieurs avantages :

- Flux de travail ML et DevOps unifiés : Les data scientists et les ingénieurs ML peuvent désormais versionner, sécuriser et déployer des modèles en utilisant les mêmes workflows de développement logiciel DevSecOps de JFrog qu'ils connaissent et en lesquels ils ont confiance. Cela élimine le besoin pour les équipes d'utiliser des outils ML distincts tout en garantissant des vérifications automatisées de la conformité, des pistes d'audit et une gouvernance des modèles ML via JFrog Curation.

- Sécurité et intégrité de bout en bout : Mise en œuvre de scans de sécurité continus sur les conteneurs, les modèles IA et leurs dépendances – fournissant des informations contextuelles sur les microservices NIM – pour identifier les vulnérabilités, complétées par une détection intelligente des menaces axée sur les risques réels et une protection proactive contre les modèles IA et les packages compromis.

- Performances et évolutivité exceptionnelles des modèles : Optimisation des performances des applications d’IA en utilisant l'infrastructure de calcul accélérée NVIDIA, offrant une faible latence et un haut débit pour un déploiement évolutif des LLM dans des environnements de production à grande échelle. Regrouper facilement les modèles ML avec leurs dépendances pour réduire les exigences externes et utiliser les workflows existants pour un déploiement IA sans faille. De plus, la plateforme JFrog offre des options de déploiement flexibles pour augmenter l'évolutivité, y compris les déploiements auto-hébergés, multi-cloud et en environnement isolé.

Enfin, l'éditeur annonce JFrog ML. Cette solution combine MLOps et DevSecOps. L'objectif est de permettre de mieux garantir des modèles plus fiables et plus sécurisées. Ces modèles peuvent ensemble être déployés en production.

![[podcast] L’Intelligence artificielle : utopie dystopique](https://www.radiofrance.fr/pikapi/images/c3fa27d4-1615-4438-8ac0-faa742fa8c39/200x200?webp=false)