Les tentatives de fraude par « deepfakes » ont augmenté de 2137% au cours des trois dernières années

Les tentatives de fraude par « deepfakes » ont augmenté de 2137% au cours des trois dernières années Signicat a fait appel à la société de recherche indépendante Censuswide pour sonder 1206 décideurs en matière de fraude en Belgique, en Allemagne, aux Pays-Bas, en Norvège, en Espagne, en Suède et au Royaume-Uni. L'évolution des techniques deepfakes pose de nouveaux défis en matière de sécurité. - Investigations

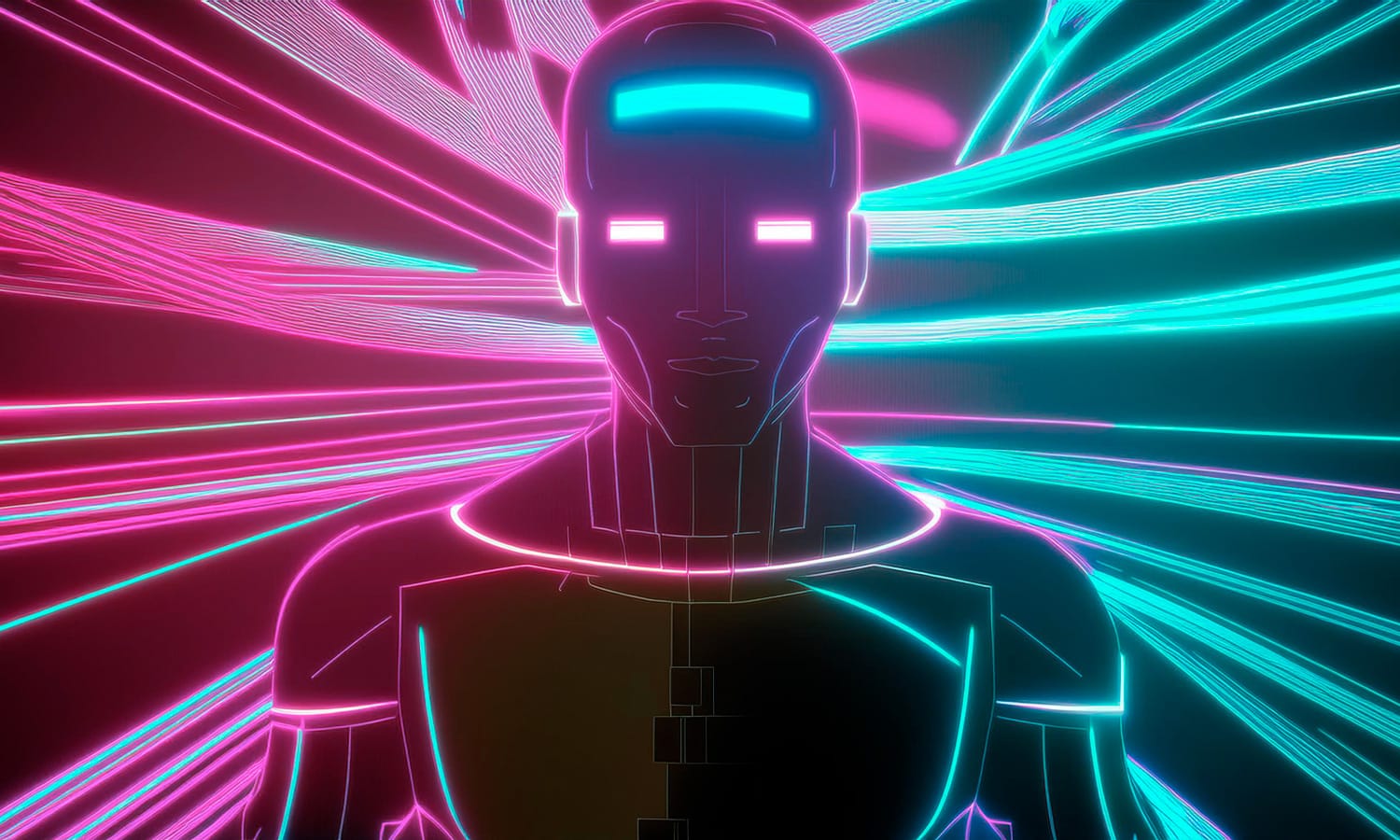

Les entreprises du secteur financier sont confrontées à une hausse significative des tentatives de fraude par deepfake, qui ont augmenté de 2137% au cours des trois dernières années, selon les données du rapport The Battle Against AI-Driven Identity Fraud de Signicat. Les deepfakes devenant de plus en plus sophistiqués, tous les secteurs doivent repenser leurs stratégies de sécurité pour faire face à l'une des formes les plus graves d'usurpation d'identité existant à l'heure actuelle.

Plus de 1 200 personnes interrogées dans les secteurs de la finance et des paiements dans sept pays Européen, ont déclaré que la prise de contrôle des comptes (ATO) est le premier type de fraude auquel leurs clients sont exposés, suivi par la fraude aux paiements par carte et le phishing.

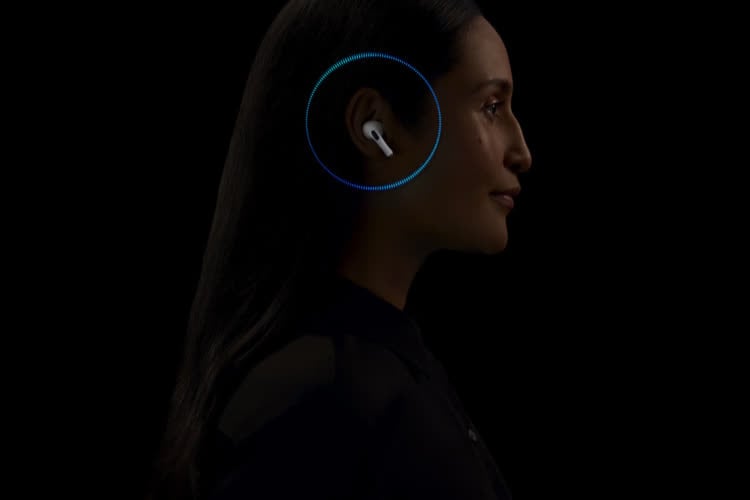

L'étude, la première à se concentrer sur la fraude à l'identité utilisant l'IA, souligne que la technologie deepfake est devenue l'un des trois types de fraude à l'identité les plus courants dans le secteur des finances et des paiements à travers l'Europe. Les deepfakes utilisent l'intelligence artificielle pour créer des falsifications numériques très réalistes. Leur croissance rapide suscite des discussions urgentes sur l'amélioration des capacités de prévention de la fraude des entreprises.

Deepfake Fraud : Presentation vs. Injection Attacks

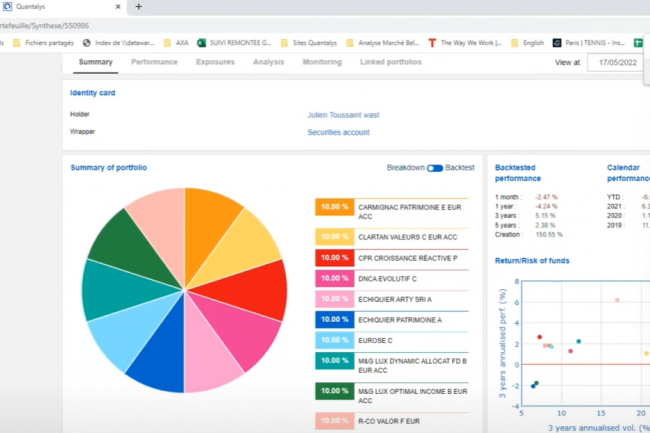

L'évolution de la technologie deepfake a conduit à deux grands types d'attaques :

1. Les attaques par présentation : il s'agit de fraudeurs qui utilisent des masques et du maquillage pour se faire passer pour une autre personne, mais aussi de fraudeurs qui filment un autre écran montrant un deepfake en temps réel, en ciblant des activités telles que les prises de contrôle de comptes ou les demandes de prêt frauduleuses.

2. Les attaques par injection : Dans ces cas, des logiciels malveillants ou des intrants non fiables sont délibérément insérés dans un programme, compromettant son intégrité ou sa fonctionnalité, par exemple sous la forme de vidéos préenregistrées, souvent pendant les processus d'onboarding ou de KYC auxquels sont soumises les banques, les sociétés fintech ou les entreprises de télécommunications.

Évolution des attaques par présentation vs. des attaques par injection

Ces techniques devenant de plus en plus sophistiquées, les systèmes traditionnels de détection des fraudes pourraient avoir du mal à faire face à cette menace croissante.

Deepfakes : une préoccupation croissante dans la fraude financière

Selon l'étude de Signicat, 42,5 % des tentatives de fraude détectées dans le secteur financier sont basées sur l'IA. Il y a trois ans, les deepfakes ne figuraient même pas parmi les trois types de fraude d'identité numérique les plus courants, alors qu'aujourd'hui, c'est le type de fraude d'identité numérique le plus courant auquel sont confrontées les entreprises. Les deepfakes sont devenus plus répandus et plus difficiles à identifier, ce qui a contribué à en faire l'une des principales méthodes d'usurpation d'identité.

Retarder les outils de détection de la fraude alors que les menaces augmentent

Malgré l'augmentation des tentatives de fraude basées sur l'IA, y compris les deepfakes, seulement 22 % des institutions financières ont mis en place des outils de prévention de la fraude basés sur l'IA. Cette lacune laisse de nombreuses entreprises vulnérables à des attaques plus sophistiquées.

« Il y a trois ans, les attaques par deepfake ne représentaient que 0,1 % des tentatives de fraude que nous avons détectées, alors qu'aujourd'hui elles représentent environ 6,5 %, soit 1 cas sur 15. Cela représente une augmentation de 2137 % au cours des trois dernières années, ce qui est alarmant. Les fraudeurs utilisent des techniques basées sur l'IA que les systèmes traditionnels ne peuvent plus détecter. Les organisations devraient envisager des systèmes de détection avancés qui combinent l'IA, la biométrie et la vérification d'identité pour se protéger contre ces menaces », déclare Pinar Alpay, Chief Product & Marketing Officer chez Signicat. « Un cadre de multi-détection est crucial. En combinant une évaluation précoce des risques, une vérification d'identité robuste et des méthodes d'authentification basées sur la biométrie faciale, ainsi qu'une surveillance continue, les entreprises peuvent mieux protéger à la fois leurs opérations et leurs clients », ajoute-t-elle. « La coordination optimale de ces outils est l'essence même de la protection multicouche ».

La forte augmentation des fraudes de type « deepfake » s'inscrit dans une tendance plus large de fraude d'identité basée sur l'IA, les cybercriminels exploitant de plus en plus les technologies avancées pour exploiter les systèmes financiers. Le rapport de Signicat lance un appel urgent à l'action pour que les institutions financières et les entreprises renforcent de manière proactive leurs mesures de cybersécurité.

En mettant à jour les systèmes de détection des fraudes, en améliorant la sensibilisation des employés et des clients et en investissant dans des solutions de prévention des fraudes basées sur l'IA, les organisations peuvent garder une longueur d'avance sur ces menaces en évolution rapide et protéger à la fois leurs opérations et leurs clients.

Méthodologie

Signicat a fait appel à la société de recherche indépendante Censuswide pour sonder 1206 décideurs en matière de fraude en Belgique, en Allemagne, aux Pays-Bas, en Norvège, en Espagne, en Suède et au Royaume-Uni. Les répondants à l'enquête provenaient de banques, de compagnies d'assurance, de prestataires de paiement et de fintech, et tous étaient impliqués dans le processus de prise de décision en matière de fraude. Les réponses ont été recueillies en 2024 via une enquête en ligne.

![[podcast] L’Intelligence artificielle : utopie dystopique](https://www.radiofrance.fr/pikapi/images/c3fa27d4-1615-4438-8ac0-faa742fa8c39/200x200?webp=false)