LivePortrait : animer des images avec PyTorch

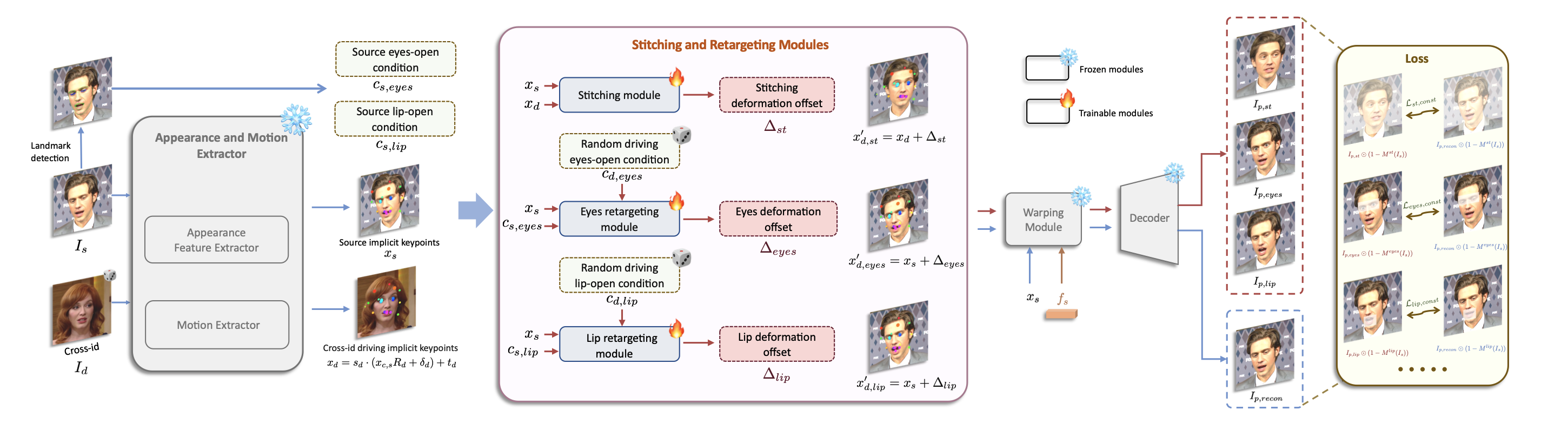

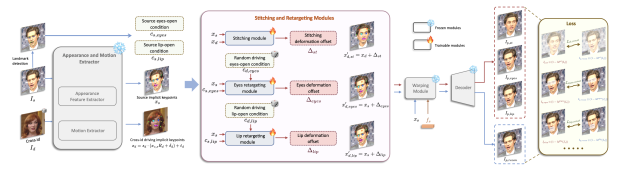

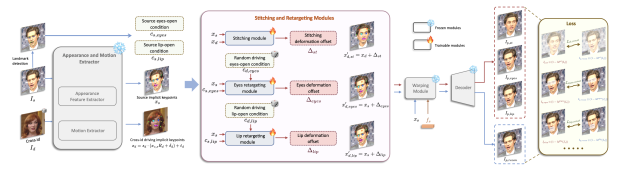

Tu rêves d'animer un tableau, une photo ? LivePortrait est une implémentation (spécifique) de PyTorch. Ce projet open source repose sur la publication LivePortrait : efficient portrait animation for stitching and retargeting contol. Le projet repose sur PyTorch, conda et FFmpeg (pour la partie vidéo). Sur Linux et Windows, il faut installer X-Pose (compatible avec CUDA). Cette dépendance n'est pas supportée actuellement macOS ce qui peut limiter la génération. LivePortrait utilise un LLM entraîné disponible sur HuggingFace. L'inférence se fait localement. Les développeurs préviennent que sur macOS, les performances peuvent être très réduites, faute du support de X-Pose et de NVIDIA. La publication LivePortrait est très intéressante pour comprendre comment les chercheurs créent les animations des visages et l'ensemble des éléments (joues, nez, visage, yeux, etc.) et comment on calque les mouvements sur un modèle défini. GitHub : https://github.com/KwaiVGI/LivePortrait?tab=readme-ov-filePublication : https://arxiv.org/pdf/2407.03168Catégorie actualité: TechnologiesLivePortrait, LLMImage actualité AMP:

Tu rêves d'animer un tableau, une photo ? LivePortrait est une implémentation (spécifique) de PyTorch. Ce projet open source repose sur la publication LivePortrait : efficient portrait animation for stitching and retargeting contol. Le projet repose sur PyTorch, conda et FFmpeg (pour la partie vidéo). Sur Linux et Windows, il faut installer X-Pose (compatible avec CUDA). Cette dépendance n'est pas supportée actuellement macOS ce qui peut limiter la génération.

LivePortrait utilise un LLM entraîné disponible sur HuggingFace. L'inférence se fait localement. Les développeurs préviennent que sur macOS, les performances peuvent être très réduites, faute du support de X-Pose et de NVIDIA.

La publication LivePortrait est très intéressante pour comprendre comment les chercheurs créent les animations des visages et l'ensemble des éléments (joues, nez, visage, yeux, etc.) et comment on calque les mouvements sur un modèle défini.

GitHub : https://github.com/KwaiVGI/LivePortrait?tab=readme-ov-file

Publication : https://arxiv.org/pdf/2407.03168