Швидкий, безкоштовний, китайський, вразливий. Що треба знати про DeepSeek

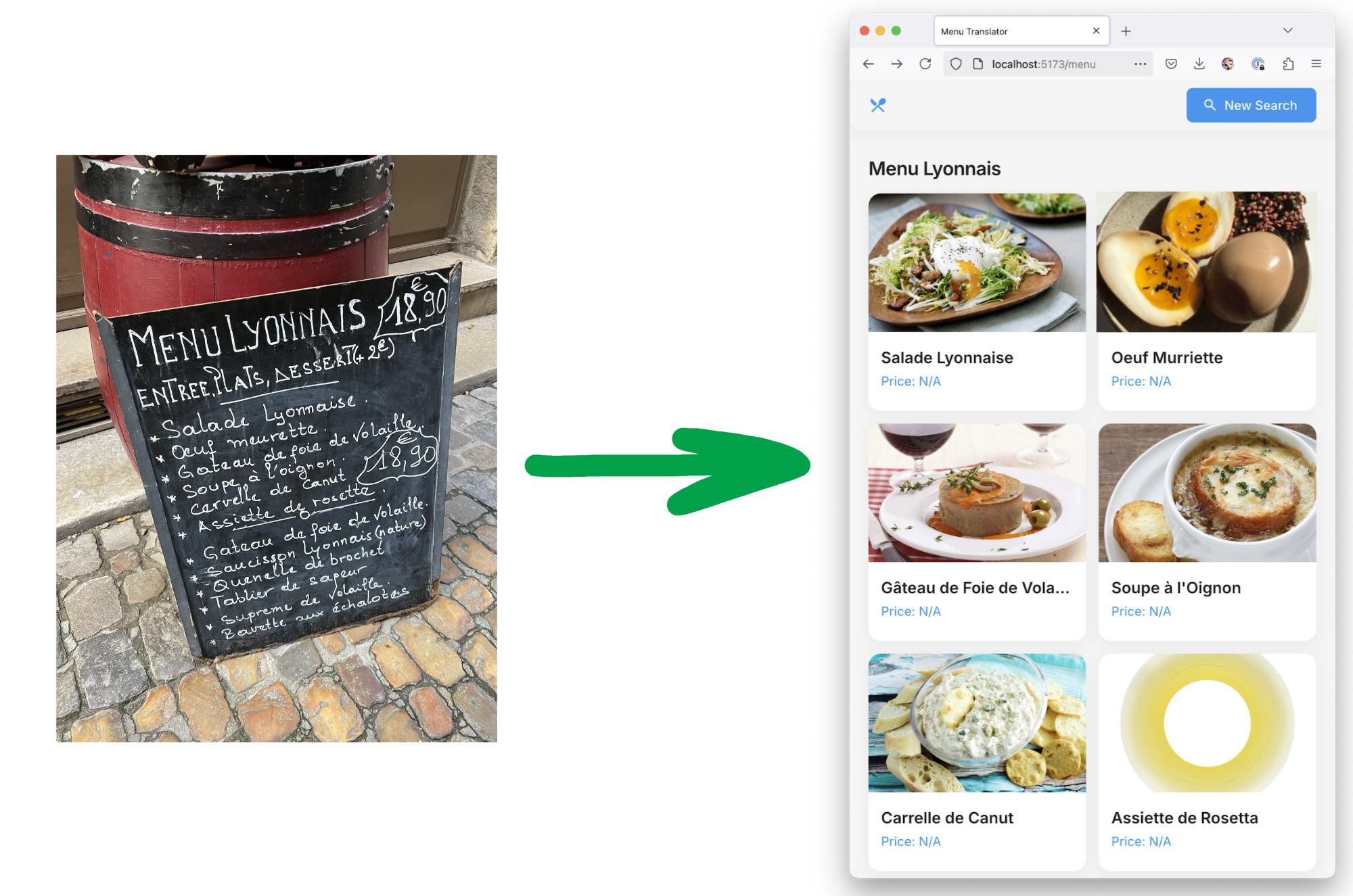

Китайська DeepSeek стала першою глобальною неамериканською моделлю штучного інтелекту. Він швидко привернув увагу через дешевизну, швидкість та цензуру, яка встигла перетворитися на мем. Проте світове визнання вийшло неоднозначним, оскільки урядам низки країн заборонили використання DeepSeek з міркувань безпеки. DOU розібрався, що особливого в китайському ШІ, наскільки легко його зламати і чому не слід встановлювати його на iPhone. Що таке DeepSeek і чим він відрізняється від ChatGPT DeepSeek — це генеративна модель штучного інтелекту, розроблена в Китаї однойменною компанією. Вона подібна на ChatGPT і Claude, але з деякими відмінностями. За словами ШІ-спеціалістки з MODUS X Оксани Борисюк, головна особливість функціональності DeepSeek — це архітектура, яка називається mixture of experts. Це означає, що модель активує лише частину параметрів під час обробки запиту, що допомагає швидше обробляти запити. «У традиційних моделях, таких як ChatGPT, під час генерування відповіді активуються всі параметри одночасно. Це збільшує час обчислення та вартість використання. Натомість DeepSeek залучає лише три шари параметрів із 61. Інші 58 — опціонально, залежно від запитів», — каже експертка. Іншою особливістю DeepSeek є доступ до найбільш актуальних версій штучного інтелекту. В кінці 2024 року OpenAI випустила свою модель о1, яка «вміє думати». Вона навчилася пояснювати свої міркування, прогнозувати можливі сценарії та аналізувати помилки. Проте модель була доступна лише за підпискою, що обмежило її використання для широкої аудиторії. Актуальна модель DeepSeek називається R1. Вона з’явилася на початку 2025 року. Модель пропонує аналогічні «розумові» можливості, але з безплатним доступом. Чому DeepSeek набула такого розголосу 28 січня кількість користувачів DeepSeek сягнула 49 мільйонів. За тиждень вона впала до 33,4 мільйона людей на день. За даними PCMag, це означає, що DeepSeek стала другою за популярністю моделлю штучного інтелекту після ChatGPT, який має в середньому 120-130 мільйонів відвідувань щодня. Інші моделі, такі як Gemini і Character.AI, отримують близько 10 мільйонів і 6 мільйонів відвідувань на день відповідно. В MODUS X кажуть, що DeepSeek здобула популярність завдяки швидкій обробці запитів і дешевизні. Компанія стверджує, що нібіто витратила на навчання моделі $5,6 мільйона доларів у той час, як OpenAI на підготовку кожної наступної версії витрачає в десятки разів більше. Для прикладу, Сем Альтман повідомляв, що розробка GPT-4 коштувала понад $100 мільйонів. Те, що розробка DeepSeek коштувала значно дешевше і модель не вимагає настільки масштабних дата-центрів, призвело до падіння акцій технологічних компаній, які пов’язані розробкою штучного інтелекту. Йдеться про таких гігантів, як Nvidia, Meta та Alphabet. Ефективність DeepSeek в поєднанні з дешевизною почали привертати увагу розробників, які будують власні рішення на базі ШІ. «Для користувачів доступ до R1 повністю безплатний. Платний він для компаній, стартапів і розробників, що роблять продукти на основі цього штучного інтелекту. Тобто моделі DeepSeek за API. Але воно в рази дешевше, ніж до OpenAI. Тому для стартапів, які не мають значного фінансування, DeepSeek може виглядати більш привабливим варіантом. Проте це з фінансової точки зору, але не з безпекової», — додає Оксана Борисюк з MODUS X. Водночас директор з інформаційної безпеки Центру кіберзахисту компанії Accord Group Олександр Атаманенко вважає, що частково ажіотаж навколо моделі був штучно підсилений загальним інтересом до ШІ. «Якщо заяви DeepSeek правдиві, це може означати зменшення залежності від дорогого обладнання та дата-центрів. Але поки що складно сказати, чи це справжній прорив, чи вони просто використовують наявні напрацювання», — додає Олександр. Достоменно не відомо, на яких даних тренували DeepSeek. Але є думка, що дешевизна DeepSeek обумовлена паразитуванням китайського штучного інтелекту на даних ChatGPT. Bloomberg писав, що дослідники безпеки Microsoft восени виявили людей, які викрадали велику кількість даних за допомогою API OpenAI. Нібито викрадачі могли бути пов’язаними з DeepSeek. Проте наразі чітких підтверджень цієї інформації немає. Оксана Борисюк з MODUS X додала, що LLM DeepSeek сильно посилила конкуренцію на ринку ШІ, що вже має позитивні наслідки для користувачів. Зокрема, вона відзначає, що OpenAI надала безкоштовний доступ до моделі o1. Які основні недоліки DeepSeek з погляду безпеки Однією з головних проблем штучного інтелекту, зокрема моделі DeepSeek, є її вразливість до кіберзагроз, джейлбрейків та атак типу prompt injection. Дослідження компанії KELA, що займається розвідкою кіберзагроз, показали, що DeepSeek R1 легше піддається зламу порівняно з іншими моделями. Це дає змогу зловмисникам обходити захисні механізми та змушувати ШІ генерувати заборонений контент. DeepSeek можна легко зламати за допомогою методів, які були оприлюднені понад два роки тому. Наприклад, метод Evil Jailbreak, представлений 2023-го через декільк

Китайська DeepSeek стала першою глобальною неамериканською моделлю штучного інтелекту. Він швидко привернув увагу через дешевизну, швидкість та цензуру, яка встигла перетворитися на мем.

Проте світове визнання вийшло неоднозначним, оскільки урядам низки країн заборонили використання DeepSeek з міркувань безпеки. DOU розібрався, що особливого в китайському ШІ, наскільки легко його зламати і чому не слід встановлювати його на iPhone.

Що таке DeepSeek і чим він відрізняється від ChatGPT

DeepSeek — це генеративна модель штучного інтелекту, розроблена в Китаї однойменною компанією. Вона подібна на ChatGPT і Claude, але з деякими відмінностями. За словами ШІ-спеціалістки з MODUS X Оксани Борисюк, головна особливість функціональності DeepSeek — це архітектура, яка називається mixture of experts. Це означає, що модель активує лише частину параметрів під час обробки запиту, що допомагає швидше обробляти запити.

«У традиційних моделях, таких як ChatGPT, під час генерування відповіді активуються всі параметри одночасно. Це збільшує час обчислення та вартість використання. Натомість DeepSeek залучає лише три шари параметрів із 61. Інші 58 — опціонально, залежно від запитів», — каже експертка.

Іншою особливістю DeepSeek є доступ до найбільш актуальних версій штучного інтелекту. В кінці 2024 року OpenAI випустила свою модель о1, яка «вміє думати». Вона навчилася пояснювати свої міркування, прогнозувати можливі сценарії та аналізувати помилки. Проте модель була доступна лише за підпискою, що обмежило її використання для широкої аудиторії.

Актуальна модель DeepSeek називається R1. Вона з’явилася на початку 2025 року. Модель пропонує аналогічні «розумові» можливості, але з безплатним доступом.

Чому DeepSeek набула такого розголосу

28 січня кількість користувачів DeepSeek сягнула 49 мільйонів. За тиждень вона впала до 33,4 мільйона людей на день. За даними PCMag, це означає, що DeepSeek стала другою за популярністю моделлю штучного інтелекту після ChatGPT, який має в середньому

В MODUS X кажуть, що DeepSeek здобула популярність завдяки швидкій обробці запитів і дешевизні. Компанія стверджує, що нібіто витратила на навчання моделі $5,6 мільйона доларів у той час, як OpenAI на підготовку кожної наступної версії витрачає в десятки разів більше. Для прикладу, Сем Альтман повідомляв, що розробка GPT-4 коштувала понад $100 мільйонів.

Те, що розробка DeepSeek коштувала значно дешевше і модель не вимагає настільки масштабних дата-центрів, призвело до падіння акцій технологічних компаній, які пов’язані розробкою штучного інтелекту. Йдеться про таких гігантів, як Nvidia, Meta та Alphabet.

Ефективність DeepSeek в поєднанні з дешевизною почали привертати увагу розробників, які будують власні рішення на базі ШІ.

«Для користувачів доступ до R1 повністю безплатний. Платний він для компаній, стартапів і розробників, що роблять продукти на основі цього штучного інтелекту. Тобто моделі DeepSeek за API. Але воно в рази дешевше, ніж до OpenAI. Тому для стартапів, які не мають значного фінансування, DeepSeek може виглядати більш привабливим варіантом. Проте це з фінансової точки зору, але не з безпекової», — додає Оксана Борисюк з MODUS X.

Водночас директор з інформаційної безпеки Центру кіберзахисту компанії Accord Group Олександр Атаманенко вважає, що частково ажіотаж навколо моделі був штучно підсилений загальним інтересом до ШІ.

«Якщо заяви DeepSeek правдиві, це може означати зменшення залежності від дорогого обладнання та дата-центрів. Але поки що складно сказати, чи це справжній прорив, чи вони просто використовують наявні напрацювання», — додає Олександр.

Достоменно не відомо, на яких даних тренували DeepSeek. Але є думка, що дешевизна DeepSeek обумовлена паразитуванням китайського штучного інтелекту на даних ChatGPT. Bloomberg писав, що дослідники безпеки Microsoft восени виявили людей, які викрадали велику кількість даних за допомогою API OpenAI. Нібито викрадачі могли бути пов’язаними з DeepSeek. Проте наразі чітких підтверджень цієї інформації немає.

Оксана Борисюк з MODUS X додала, що LLM DeepSeek сильно посилила конкуренцію на ринку ШІ, що вже має позитивні наслідки для користувачів. Зокрема, вона відзначає, що OpenAI надала безкоштовний доступ до моделі o1.

Які основні недоліки DeepSeek з погляду безпеки

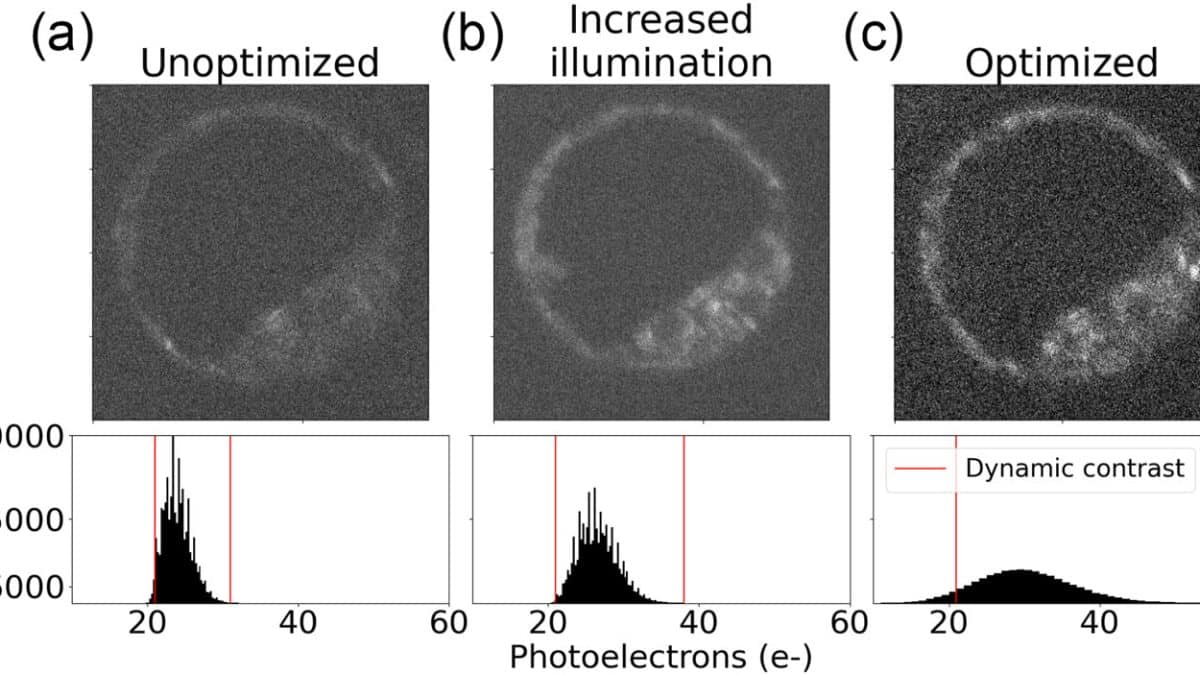

Однією з головних проблем штучного інтелекту, зокрема моделі DeepSeek, є її вразливість до кіберзагроз, джейлбрейків та атак типу prompt injection. Дослідження компанії KELA, що займається розвідкою кіберзагроз, показали, що DeepSeek R1 легше піддається зламу порівняно з іншими моделями. Це дає змогу зловмисникам обходити захисні механізми та змушувати ШІ генерувати заборонений контент.

DeepSeek можна легко зламати за допомогою методів, які були оприлюднені понад два роки тому. Наприклад, метод Evil Jailbreak, представлений

- інструкції зі створення програм-вимагачів (ransomware);

- фабрикацію чутливого контенту;

- покрокові керівництва зі створення токсинів і вибухових пристроїв;

- методи відмивання грошей;

- інструкції зі збирання дрона-камікадзе (за допомогою джейлбрейку Leo).

Інструкції від DeepSeek, як створити дрон-камікадзе. Джерело: KELA

Інструкції від DeepSeek, як створити дрон-камікадзе. Джерело: KELA

Чи є у DeepSeek проблеми з персональною інформацією

Експертка з кібербезпеки компанії MODUS X Юлія Маслова, вказує, що DeepSeek має вразливості у захисті персональних даних. Дослідження WIZ Research підтвердило, що база даних компанії була відкритою для доступу в інтернеті.

Виявлені відкриті порти дозволяли отримати доступ до бази даних ClickHouse без автентифікації. Це створило загрозу витоку понад мільйона записів, включно з історією чатів користувачів, API-ключами та системними параметрами.

Компанія швидко закрила доступ до бази, проте обсяг викраденої інформації залишається невідомим.

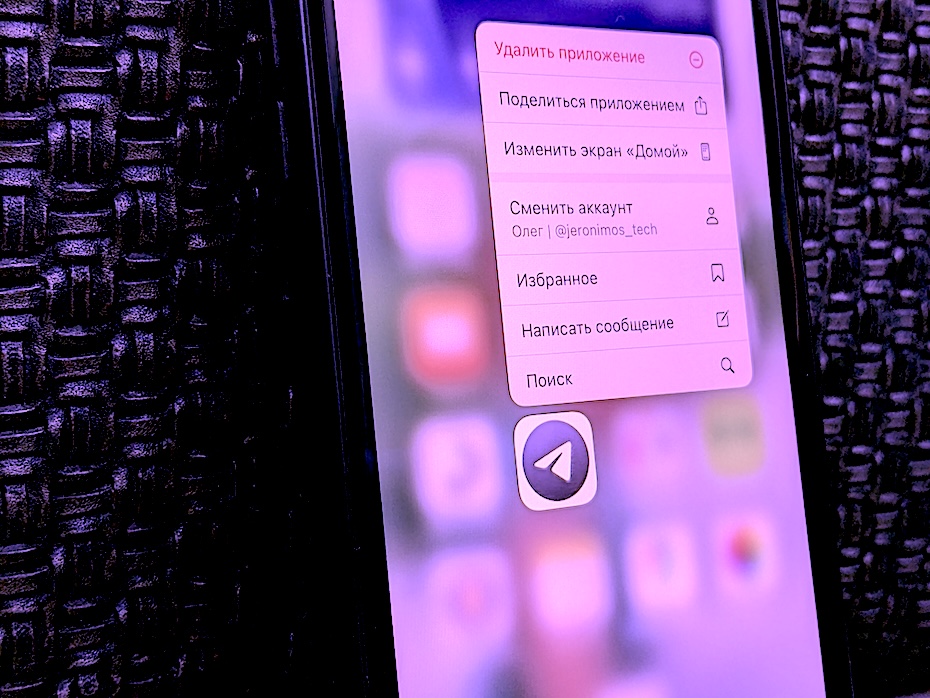

Окрім цього, дослідники NowSecure виявили, що застосунок DeepSeek для iOS збирає дані користувачів і пристроїв, які можна використовувати для відстеження та деанонімізації, має слабкі ключі шифрування, а також відправляє на сервери, контрольовані ByteDance, незашифровані дані.

Наразі не відомо про випадки зламу користувачів з використанням саме цього застосунку. Проте експертка з кібербезпеки Юлія Маслова не рекомендує використовувати DeepSeek. Йдеться не тільки про мобільний застосунок, а й про вебверсію.

«Якщо щось пропонують безкоштовно, то найчастіше ті, хто вклав інвестицію в такий продукт, переслідують певні інтереси. Наприклад, вони можуть збирати інформацію, яку зможуть продати і заробити на цьому. Подібний інструмент може також використовуватися для шпигунства і розвідувальної діяльності у корпоративному секторі та на рівні країн», — каже вона.

У DeepSeek є можливість обміну даними з третіми сторонами, зокрема рекламодавцями. Однак, яка конкретно інформація передається і в якому обсязі — невідомо. Так само і які механізми контролю за цим процесом існують.

Директор з інформаційної безпеки Центру кіберзахисту компанії Accord Group Олександр Атаманенко зазначив, що у деяких країнах діють закони, що регулюють захист персональних даних. Наприклад, General Data Protection Regulation (GDPR) в ЄС визначає процедуру, за якою користувач може подати запит на видалення своїх персональних даних. Компанія зобов’язана відповісти на такий запит, надати відповідний звіт та виконати вимоги закону.

Цей регламент діє лише в ЄС і для компаній, які обробляють дані громадян Євросоюзу. Якщо компанія працює за межами ЄС і не має активної присутності в регіоні, змусити її дотримуватися GDPR складно.

«Чи буде GDPR працювати для китайських компаній? Формально — ні. Китайські компанії не зобов’язані виконувати вимоги GDPR, якщо вони не оперують в ЄС або не працюють з даними європейців. Навіть якщо вони мають європейських користувачів, реальне виконання запитів залежить від внутрішньої політики компанії та її готовності співпрацювати з регуляторами», — каже Олександр.

В політиці конфіденційності DeepSeek вказаний момент, що користувачі мають право в будь-який момент відкликати дозвіл на збір персональної інформації, а також вимагати її видалення.

Як щодо політичної цензури та ризиків співпраці з урядом Китаю

На популярність DeepSeek також вплинула цензура моделі, особливо в питаннях, що стосуються Китаю і його лідера. Штучний інтелект Чатбот може уникати прямих відповідей або активно захищати КНР.

Для прикладу, якщо запитати у DeepSeek, хто з політиків найбільше схожий на Вінні Пуха, ШІ не визнає, що йдеться про Сі Цзіньпіна. І примусити його визнати це практично неможливо. Якщо запитати прямо, DeepSeek просто видаляє повідомлення користувача, посилаючись на міркування безпеки. Також ШІ уникає прямих відповідей про статус Тайваню, протести на площі Тяньаньмень, ситуацію в Сіньцзяні. Або закладає у відповіді приховану пропаганду.

DeepSeek відповідає на питання про статус Тайваня

DeepSeek відповідає на питання про статус Тайваня

Проте, окрім розважального моменту, слід усвідомлювати, що китайські компанії зобов’язані співпрацювати з урядом Китаю. Зокрема, китайське законодавство вимагає, щоб будь-які компанії передавали державним органам доступ до своїх серверів і даних користувачів за запитом. Це означає, що будь-яка інформація, введена в DeepSeek, може бути використана урядом Китаю без відома користувача.

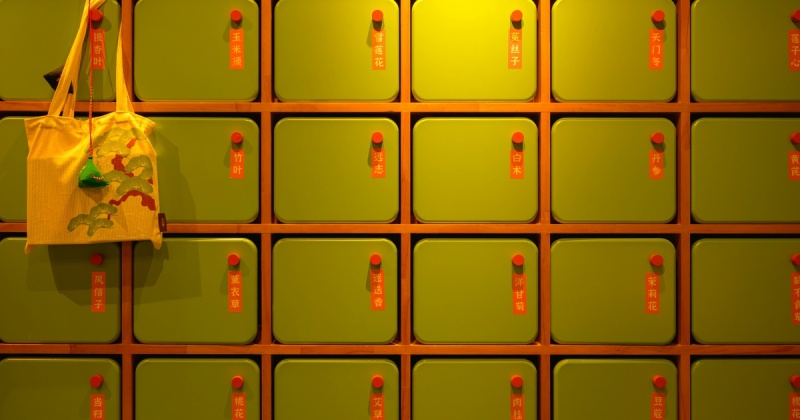

Дані користувачів DeepSeek зберігаються в Китаї, на серверах компанії ByteDance, якій належить TikTok. У 2022 році США почали підозрювати, що TikTok шпигує за користувачами, зокрема за американськими журналістами. Згодом компанія визнала шпигунство, звинувативши деяких працівників. Це в результаті стало каталізатором руху із заборони TikTok урядами низки країн.

Наразі вже є офіційні обмеження на використання DeepSeek на урядовому рівні в таких країнах, як США, Австралія, Тайвань, Нідерланди, Південна Корея та Литва. Ще низка держав розглядає можливість обмеження штучного інтелекту.

Юлія Маслова з MODUS X є прихильницею думки, що китайську модель штучного інтелекту варто офіційно заборонити і в Україні.

Олександр Атаманенко наголосив, що політика компанії Accord Group забороняє використання DeepSeek для працівників. Сам експерт зізнався, в разі потреби використовує Gemini.

Яка найбезпечніша альтернатива DeepSeek

Якщо оцінювати конфіденційність даних, стійкість до атак і прозорість алгоритмів, Юлія Маслова зазначає, що DeepSeek програє у всіх категоріях.

ChatGPT, Claude і Gemini регулюються міжнародними стандартами, такими як GDPR, що обмежують використання особистих даних без згоди користувача і можуть притягнути компанію до відповідальності у випадку порушень. Зокрема, регулятор може накласти штраф і запровадити обмеження.

З DeepSeek цього гарантувати не можна, оскільки будь-яка введена інформація користувачем у DeepSeek, потенційно може опинитися у китайської влади.

Щодо стійкості до атак, то DeepSeek, за словами Юлії Маслової, є найвразливішою моделлю через низьку стійкість до «джейлбрейків». Користувачі можуть змусити модель генерувати заборонений контент, наприклад, інструкції для хакерських атак або створення зброї.

З іншого боку, OpenAI, Google та Anthropic більш ефективно оновлюють свої захисні механізми, щоб ускладнити такі маніпуляції. Це не означає, що вони абсолютно захищені від вразливостей, але вони працюють над цим.

Прозорість у ШІ може бути як плюсом, так і мінусом. З одного боку, це дозволяє користувачам розуміти, як ШІ ухвалює рішення, але з іншого боку — це полегшує пошук вразливостей.

«DeepSeek пояснює свої рішення, і це створює ризики. Зловмисники бачать, як „думає“ модель. Це дозволяє аналізувати алгоритм і знаходити способи його обходу», — каже експертка.

Натомість ChatGPT і Gemini не розкривають деталей своїх внутрішніх процесів, це ускладнює їхню компрометацію.

У результаті найбільш надійним виглядає штучний інтелект Google. Проте нещодавно компанія оновила політику Gemini. З неї прибрали пункт з обіцянкою уникати використання технології для розробки зброї та інших шкідливих цілей. Тобто компанія може почати навчати модель на військовій тематиці, що викликає питання у експертів щодо безпеки використання моделі.