Deepfake-as-a-Service : L'IA au cœur de la cyberfraude 2.0

Deepfake-as-a-Service : L'IA au cœur de la cyberfraude 2.0 Un nouveau rapport de TEHTRIS révèle l'industrialisation des deepfakes et de l'IA au service de la cybercriminalité, avec l'émergence de plateformes comme Haotian AI. Les entreprises et les gouvernements doivent se préparer à une nouvelle vague de menaces automatisées et sophistiquées. - Investigations

TEHTRIS publie un nouveau rapport de Threat Intelligence détaillant l'évolution du paysage des cybermenaces en 2025. L'étude met en lumière l'essor inquiétant du « Deepfake-as-a-Service », où l'intelligence artificielle est utilisée pour automatiser et industrialiser des arnaques en ligne à grande échelle. L'accès à des plateformes DfaaS, offrant des services tels que l'échange de visages par IA, le clonage de voix, la synthèse vocale et l'animation par IA, facilite la création de contenus deepfake réalistes, ouvrant la voie à des abus potentiels.

Principales conclusions du rapport :

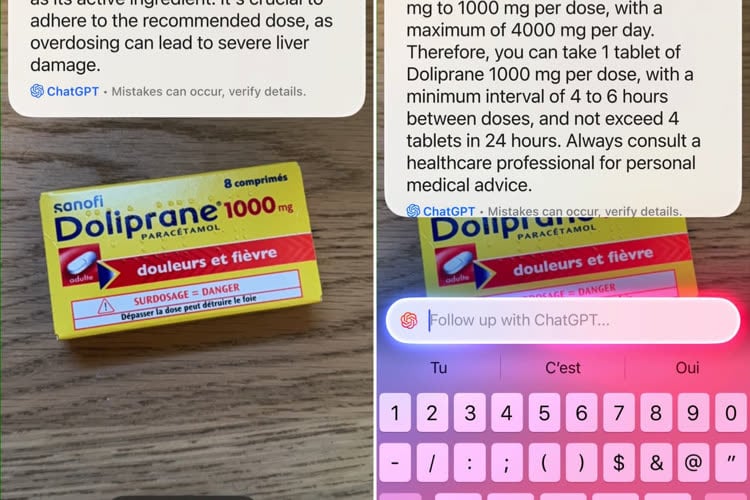

• L'IA, une arme de cybercriminalité accessible à tous : L'accès simplifié aux outils d'IA, combiné à la disponibilité de modèles pré-entraînés et d'API, et l'émergence de plateformes DfaaS permet même aux acteurs peu qualifiés de lancer des cyberattaques sophistiquées.

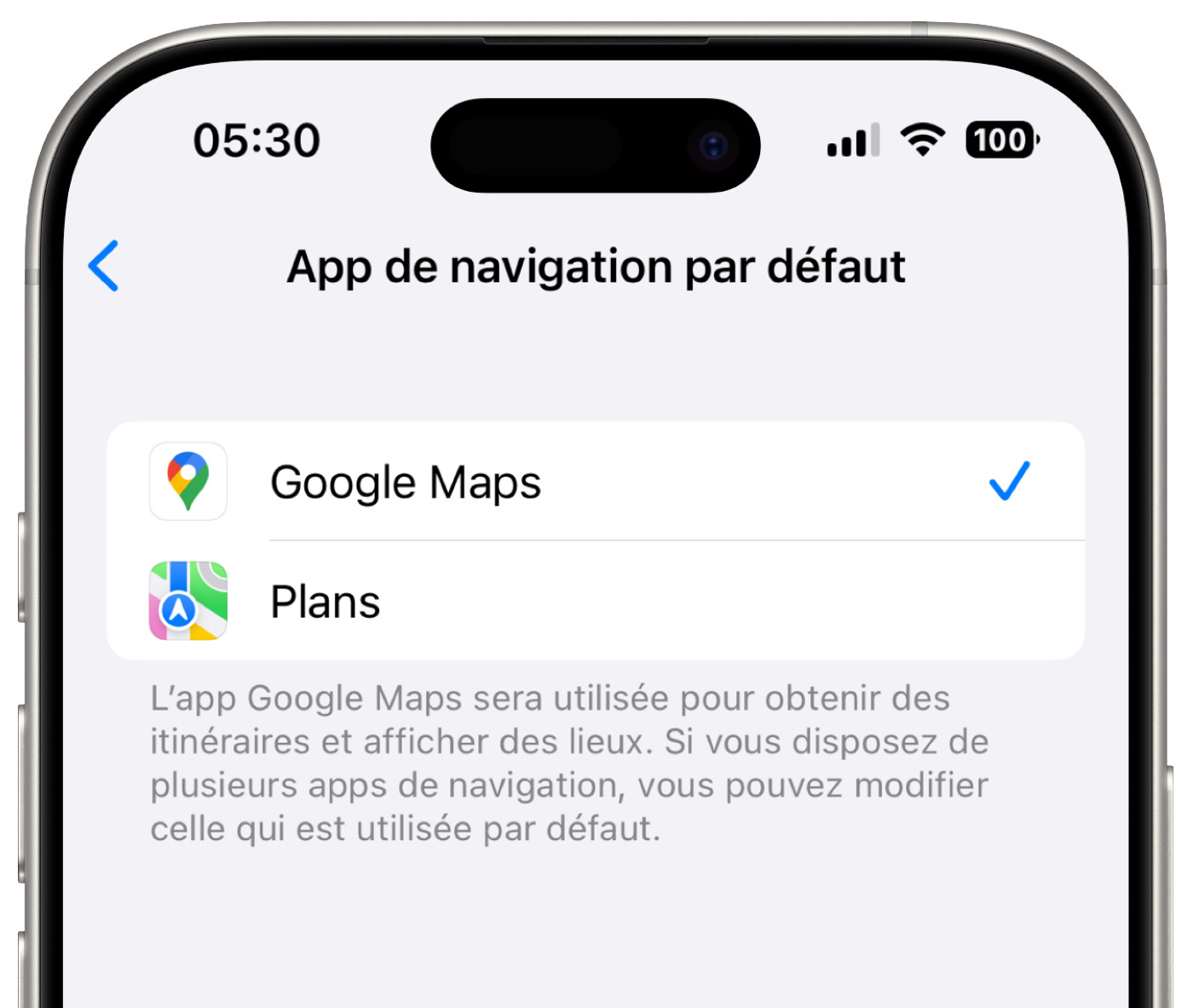

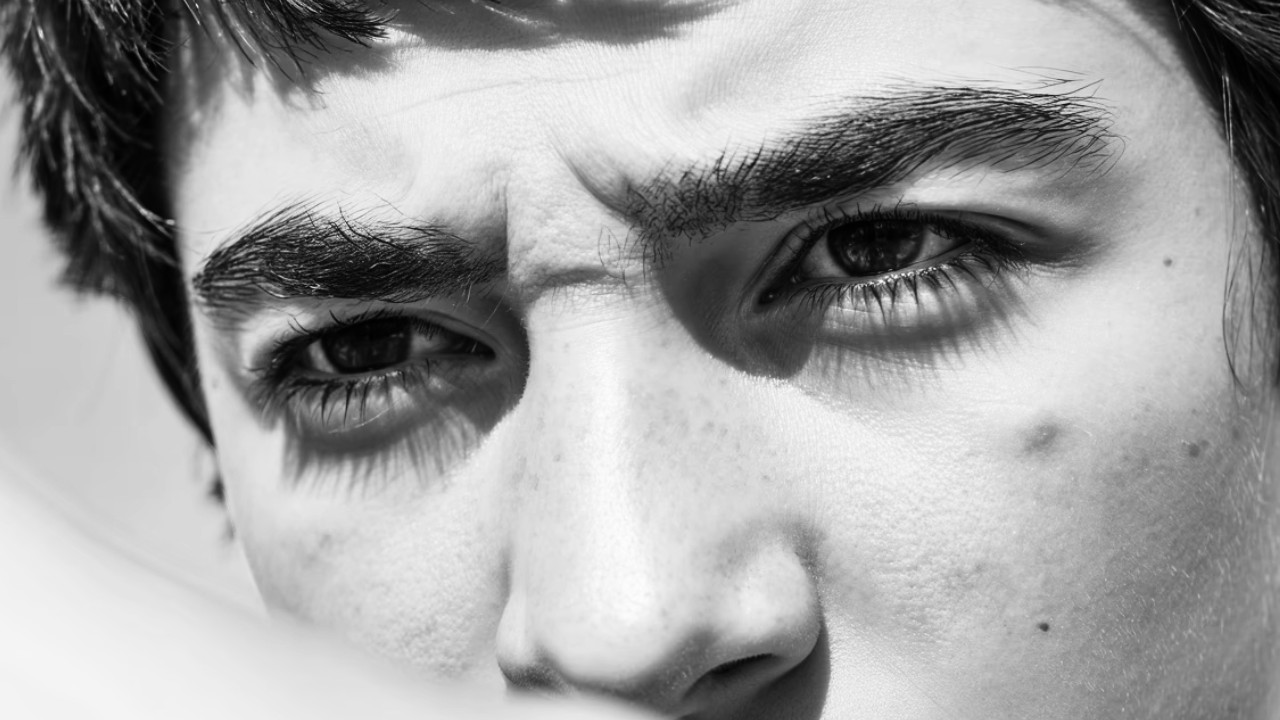

• Des arnaques plus crédibles et plus rentables : Deepfakes, clonage vocal et bots conversationnels, accessibles via les plateformes DfaaS, rendent les attaques plus convaincantes et difficiles à détecter, augmentant ainsi leur taux de réussite. Le rapport cite des exemples d'usurpation d'identité en visioconférence, d'escroqueries sentimentales (« Pig Butchering ») et de contournement des procédures KYC (Know Your Customer).

• L'automatisation à grande échelle : Les bots IA peuvent simuler des centaines de conversations simultanément, 24h/24, rendant les arnaques massives et plus rentables. Les plateformes DfaaS accélèrent ce phénomène en fournissant des outils d'automatisation prêts à l'emploi.

Haotian AI : L'incarnation du Deepfake-as-a-Service

Au sein de cet écosystème criminel, TEHTRIS a identifié Haotian AI, une organisation basée en Asie qui illustre la professionnalisation du « Deepfake-as-a-Service ». Haotian AI propose une offre clé en main incluant des services similaires à ceux décrits comme typiques des plateformes DfaaS :

• Face-swapping en temps réel pour usurper une identité lors d'appels vidéo.

• Synthèse vocale ultra-réaliste pour imiter des voix avec précision.

• Chatbots automatisés pour maintenir des conversations crédibles pendant des semaines.

• Génération d'images pour créer de faux profils sur les réseaux sociaux.

Les recherches OSINT de TEHTRIS suggèrent que Haotian AI ne se contente pas de vendre des outils, mais facilite activement leur utilisation par des cybercriminels, incarnant ainsi l'industrialisation du deepfake au service de l'arnaque. Le rapport détaille l'architecture des bots, les techniques de blanchiment via cryptomonnaies et les méthodes d'engagement prolongé des victimes utilisées par cette organisation.

Recommandations pour les responsables informatiques (CISO et SOC/MDR) :

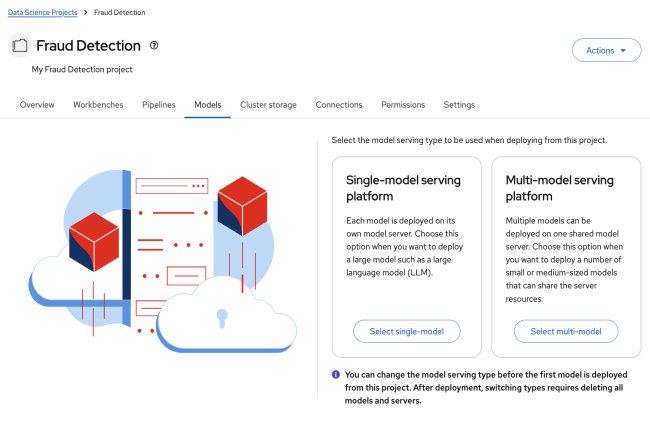

• Adopter une approche XDR hyper-automatisée : Intégrer des solutions proactives capables d'anticiper et de neutraliser les menaces émergentes liées aux plateformes DfaaS, comme la TEHTRIS XDR AI PLATFORM.

• Miser sur la détection comportementale : Identifier les anomalies subtiles dans les communications (latences, incohérences vocales, demandes urgentes) pour détecter les deepfakes et les bots.

• Surveiller les flux financiers et exploiter l'OSINT Blockchain : Traquer les transactions suspectes et les adresses crypto liées aux activités criminelles, notamment celles utilisant les services DfaaS.

• Sensibiliser et former les collaborateurs : Organiser des simulations de deepfakes et de phishing vocal pour préparer les équipes aux nouvelles formes de manipulation permises par les plateformes DfaaS.

Eric Bregand, Chief Product Officer chez TEHTRIS explique :"2025 pourrait bien être l'année où la cybercriminalité bascule définitivement dans une nouvelle ère – celle du crime automatisé, scalable et indétectable, notamment grâce à la prolifération des plateformes Deepfake-as-a-Service. L'accessibilité croissante de ces technologies rend impératif pour les organisations d'adopter une posture de sécurité proactive et de renforcer leurs défenses contre ces menaces émergentes."

(2).webp)

![Bilan 2024 : Les nouveautés Agorapulse pour booster votre stratégie sociale [Infographie]](https://www.agorapulse.com/fr/blog/wp-content/uploads/sites/3/2025/03/FR-New-Favorite-Agorapulse-Features-of-2024-Blogpost-Header-scaled.jpg?#)