Intelligence Artificielle et Confiance Numérique, les enjeux d'aujourd'hui et de demain 3 questions à Jessye Boyer, Head of Legal & DPO chez Signaturit Group

Intelligence Artificielle et Confiance Numérique, les enjeux d'aujourd'hui et de demain 3 questions à Jessye Boyer, Head of Legal & DPO chez Signaturit Group - Points de Vue

Notre quotidien, qu'il soit professionnel ou personnel, est de plus en plus numérique et largement assisté par l'intelligence artificielle. Face à cette réalité, encadrer son utilisation est devenu essentiel. Hasard du calendrier, la mise en application d'un premier ensemble de dispositions du règlement européen IA Act et le Sommet pour l'action de l'IA à Paris coïncident à quelques jours d'intervalle. Dans ce contexte, Jessye Boyer, Head of Legal & DPO chez Signaturit Group, nous apporte son éclairage sur l'intelligence artificielle de confiance à travers trois questions clés.

1. Qu'est-ce qu'on entend par Intelligence Artificielle (IA) de confiance et comment Signaturit Group l'aborde-t-elle ?

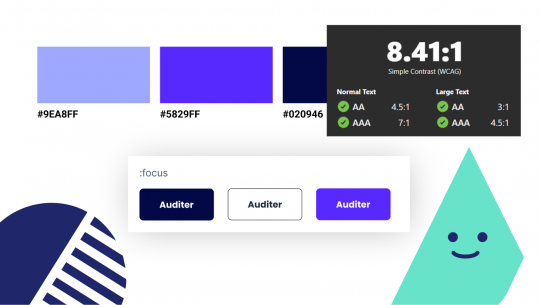

L'IA de confiance est un concept qui repose sur des piliers fondamentaux : la transparence, la fiabilité, la conformité réglementaire et la protection des utilisateurs. Son objectif est d'assurer que les systèmes d'intelligence artificielle respectent des principes éthiques et ne présentent pas de risques pour la vie privée et la sécurité des données.

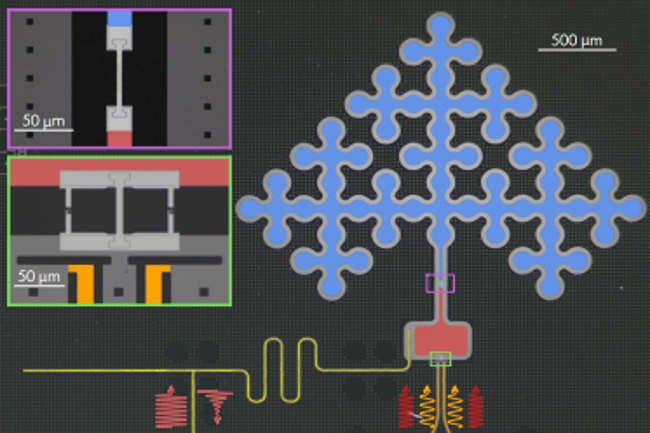

En tant que Prestataire de Services de Confiance, nous adoptons donc une approche rigoureuse. Nos solutions respectent scrupuleusement les règlementations européennes comme l'IA Act et le RGPD, qui imposent des règles strictes sur l'utilisation des données. Nous veillons aussi à garantir la transparence et l'explicabilité des systèmes d'IA, afin que les utilisateurs de nos solutions comprennent leur fonctionnement et leurs impacts. La sécurisation des données est une priorité majeure, c'est pourquoi nous avons recours à des protocoles stricts pour se prémunir de toute fuite ou usage abusif de données à caractère personnel. Enfin, nous contrôlons soigneusement les modèles d'IA que nous utilisons, en nous appuyant notamment sur des solutions préexistantes éprouvées tels que des algorithmes d'OCR (Optical Character Recognition) et de Deep Learning, tout en nous assurant que les données restent au sein de l'Union Européenne.

Chez Signaturit Group, notre mission est de fournir à nos clients des solutions IA intégrées dans des services de confiance, tout en garantissant leur conformité et leur sécurité.

2. Quels sont les enjeux de cybersécurité liés à l'IA ? Et comment les gérez-vous au quotidien ?

Si l'intelligence artificielle ouvre des opportunités immenses, elle soulève aussi des défis majeurs en matière de cybersécurité et de protection des données. L'un des principaux enjeux est donc le contrôle des données qui sont continuellement utilisées pour entraîner les algorithmes d'IA puisque ces modèles nécessitent d'énormes volumes de données, souvent personnelles.

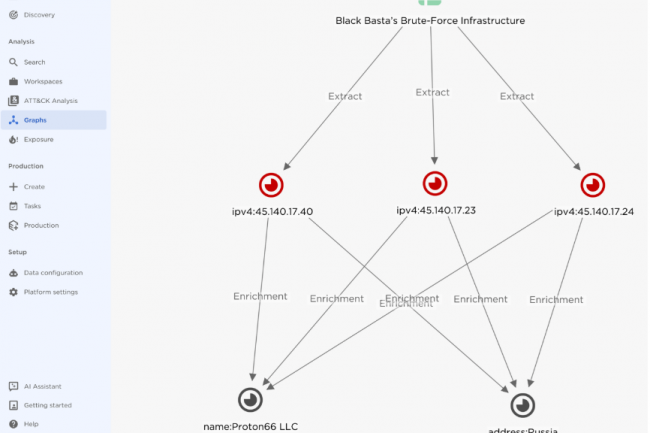

Les principaux risques incluent les fuites de données et les atteintes à la vie privée, car une IA mal sécurisée peut exposer des informations sensibles. Il existe aussi un risque de manipulation et de détournement des modèles, comme avec les deepfakes et autres techniques de désinformation qui posent un véritable problème sociétal. Les attaques adversariales sont une autre menace, où des cybercriminels biaisent les modèles IA pour altérer leurs résultats.

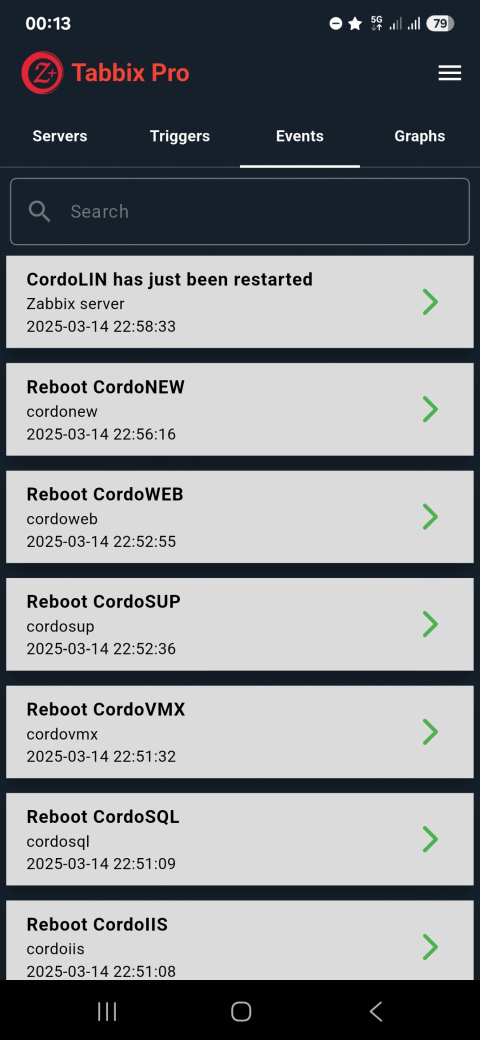

Pour y faire face, nous nous assurons que l'intégralité de nos solutions respectent les normes européennes en matière de protection des données (RGPD, IA Act) par le biais d'une veille règlementaire et technologique afin d'anticiper les menaces émergentes et donc d'adapter continuellement nos systèmes. Enfin, nous adoptons une approche "Security & Privacy by Design", c'est-à-dire que la cybersécurité et la protection des données sont intégrées dès la conception de nos solutions ou de l'intégration de nouvelles solutions.

Notre engagement est clair : garantir à nos clients et partenaires une IA fiable et sécurisée.

3. Quels impacts concrets l'IA et sa régulation ont-ils sur les entreprises ?

Les entreprises doivent aujourd'hui naviguer dans un cadre réglementaire de plus en plus complexe autour de l'IA car il n'y a pour le moment aucune homogénéisation. En Europe, l'IA Act, qui classe les IA en différentes catégories de risques, impose des obligations strictes aux entreprises utilisant des systèmes IA critiques (ex. : systèmes de notation de crédit, prise de décision automatisée, etc.).

Cela entraîne plusieurs défis du côté des entreprises. D'abord, une exigence de conformité accrue, puisqu'elles doivent garantir que leurs solutions IA respectent les réglementations en vigueur, comme l'IA Act, le RGPD et la directive NIS2. Ensuite, un besoin de transparence et de traçabilité, car l'IA doit être explicable et ses décisions compréhensibles pour les utilisateurs, notamment en cas d'utilisation de modèles génératifs ou d'algorithmes de scoring. Enfin, des investissements renforcés en cybersécurité et en veille réglementaire sont nécessaires pour adapter en permanence les systèmes, éviter les sanctions et renforcer la confiance des clients.

Chez Signaturit Group nous mobilisons nos experts et nous accompagnons nos clients en proposant des solutions basées sur une IA de confiance. C'est pourquoi, en tant qu'adhérent de la FNTC, Signaturit Group a décidé de participer à un groupe de travail « IA de confiance » avec d'autres experts du domaine.

.webp)