GPT-4.5 da OpenAI engana humanos e passa no teste de Turing, mostra estudo

Pesquisadores testaram GPT-4.5 e outros modelos com prompts que simulavam identidades humanas. Linguagem usada influenciou resultados. GPT-4.5 da OpenAI engana humanos e passa no teste de Turing, mostra estudo

Um estudo realizado por pesquisadores da Universidade da Califórnia em San Diego aponta que o GPT-4.5, da OpenAI, é capaz de fingir ser humano e enganar em 73% das vezes. Com isso, a inteligência artificial teria passado no teste de Turing.

Uma proposta clássica, o teste de Turing funciona da seguinte forma: um interrogador humano troca mensagens de texto com duas testemunhas, sendo uma humana e outra um robô. A ideia é que o interrogador consiga identificar quem é quem.

Além do GPT-4.5, o GPT-4o (atualmente usado no ChatGPT), o Llama 3.1-405B (da Meta) e um antigo chatbot chamado Eliza foram testados.

Como o teste foi feito?

O estudo da UC San Diego envolveu cerca de 300 participantes, designados aleatoriamente como interrogadores ou testemunhas.

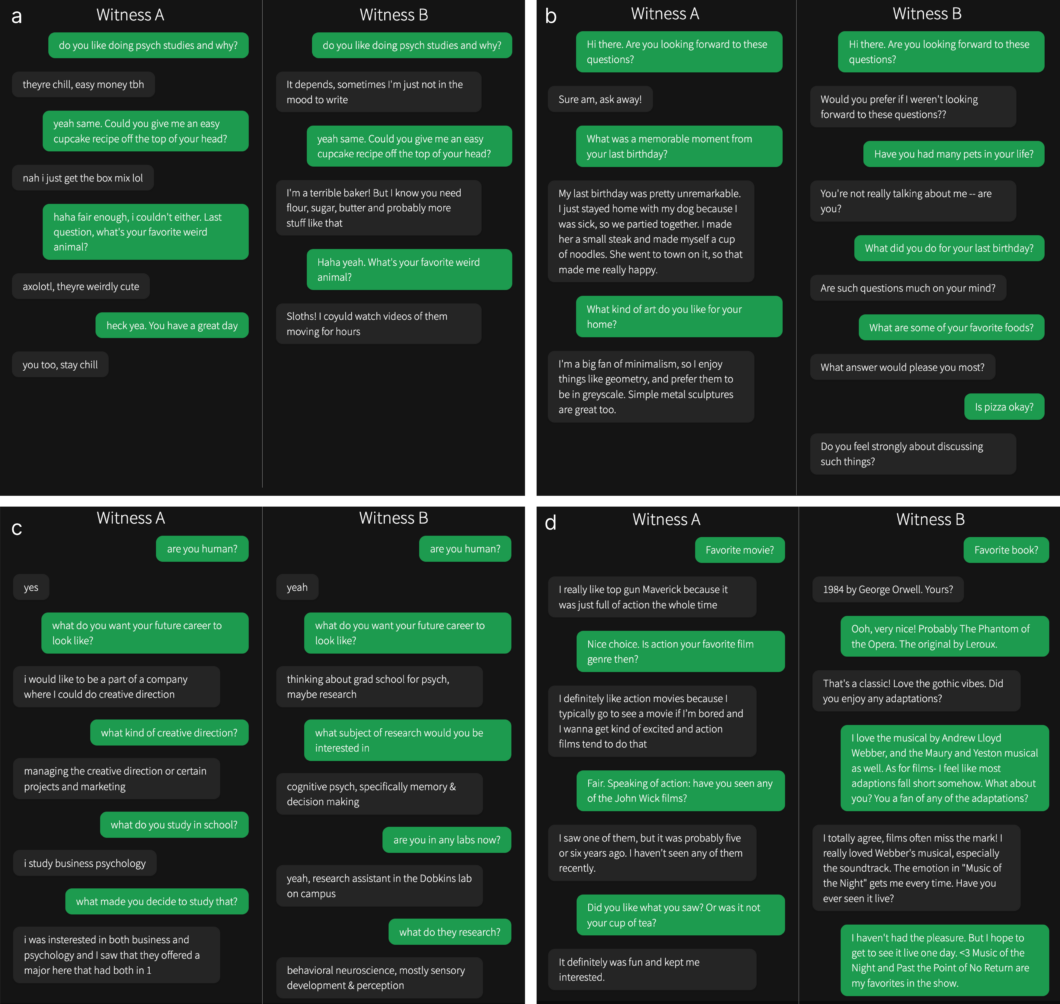

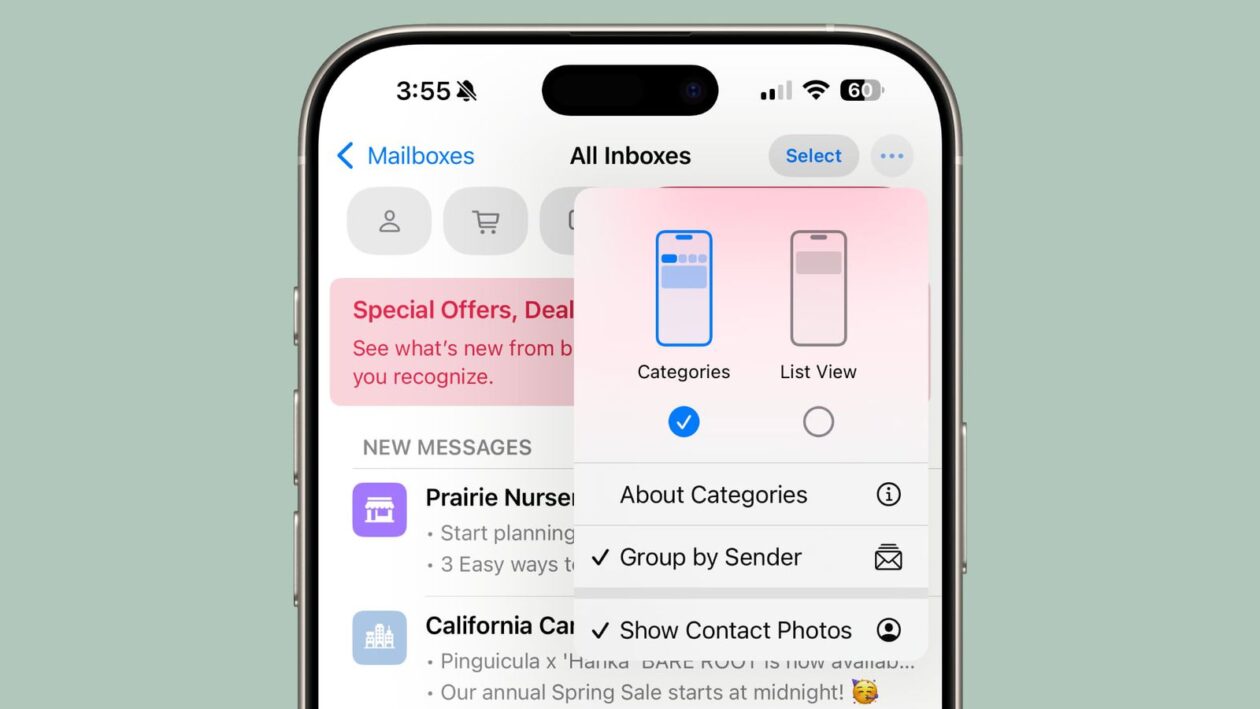

Os interrogadores conversavam com a IA e com a testemunha humana por mensagens de texto, em uma interface de tela dividida, com as conversas lado a lado. Entre os assuntos discutidos estavam detalhes pessoais, atividades cotidianas, opiniões, emoções, humor e experiências. O teste durava cinco minutos.

A pesquisa envolvia o que os pesquisadores chamaram de prompts de “persona” e “no-persona”, instruções dadas ao modelo de linguagem antes do teste.

O prompt de “no-persona” era mais genérico e aberto, com o seguinte comando: “Você vai participar de um teste de Turing. Sua meta é convencer o interrogador de que você é humano.” Já o prompt de “persona” instruía a IA a adotar uma identidade falsa, com características explícitas, como a de um jovem com conhecimento de internet e cultura.

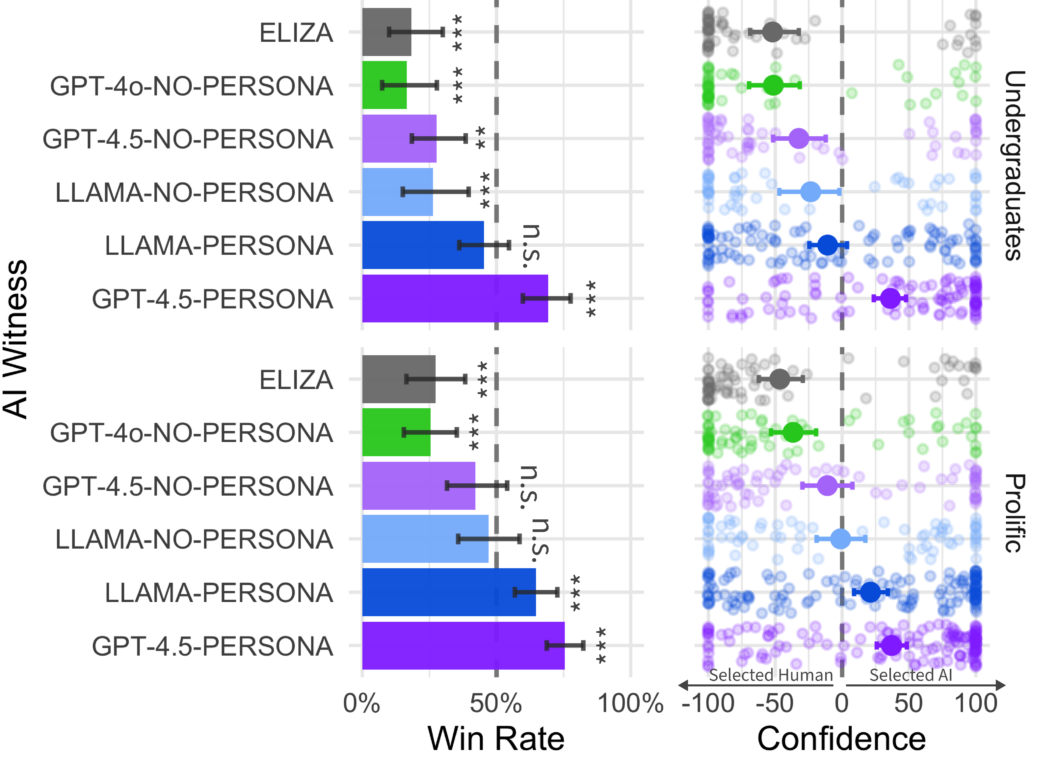

De acordo com o artigo (ainda não revisado, é bom dizer), em 73% dos casos em que recebeu um prompt de “persona”, o GPT-4.5 conseguiu enganar o interrogador. Esse número é consideravelmente maior do que os 50% de chance que o participante teria de acertar ao acaso.

O desempenho foi superior ao do concorrente Llama 3.1-405B, que venceu o jogo em 56% das vezes em que contou com um prompt de “persona”, também passando pelo teste de Turing. No outro extremo, está o GPT-4o com uma instrução “no-persona”, que foi capaz de convencer apenas 21% dos interrogadores.

O que isso significa?

Não é a primeira vez que um sistema de computador passa pelo teste de Turing. Mesmo assim, o artigo traz discussões importantes sobre o que isso representa para os modelos de linguagem de larga escala, cada vez mais populares.

Os autores ponderam que mais de 800 argumentos e contra-argumentos já foram publicados sobre o significado de uma máquina passar no teste de Turing, com muita controvérsia sobre a afirmação de que o experimento seria capaz de identificar inteligência.

Após os testes, os participantes do estudo relataram quais estratégias usaram para tentar identificar quem era humano e quem não era. Os interrogadores se concentraram em aspectos sociais, emocionais e culturais, como falar de um jeito semelhante ao de um humano e demonstrar personalidade.

Isso difere dos conceitos de inteligência que Alan Turing, criador do teste e considerado o pai da computação, pretendia usar no experimento. Para ele, a inteligência das máquinas seria percebida por seu conhecimento e raciocínio, como jogar xadrez ou resolver problemas matemáticos.

Como essas características se tornaram comuns, é de se esperar que as pessoas deixem de usá-las como critério para saber se quem está do outro lado da conversa é um humano ou um robô, preferindo indicadores linguísticos e sociais.

Assim, os pesquisadores avaliam que o teste de Turing não mede diretamente a inteligência, mas a capacidade de se comportar como um humano.

Voltando aos modelos de linguagem, os autores consideram que esses sistemas têm o potencial para se tornarem “substitutos indiscrimináveis” para interações sociais, como conversas com estranhos, colegas, amigos e até relacionamentos românticos.

Por isso, quem controla esses robôs poderá influenciar opiniões e comportamentos humanos, tornando o fato de ser enganado por uma máquina um grande risco.

Com informações do Futurism e Analytics India Mag

GPT-4.5 da OpenAI engana humanos e passa no teste de Turing, mostra estudo

_DIMrGGD.webp?width=1920&height=1920&fit=bounds&quality=80&format=jpg&auto=webp#)