ИИ обманул людей и прошел тест Тьюринга

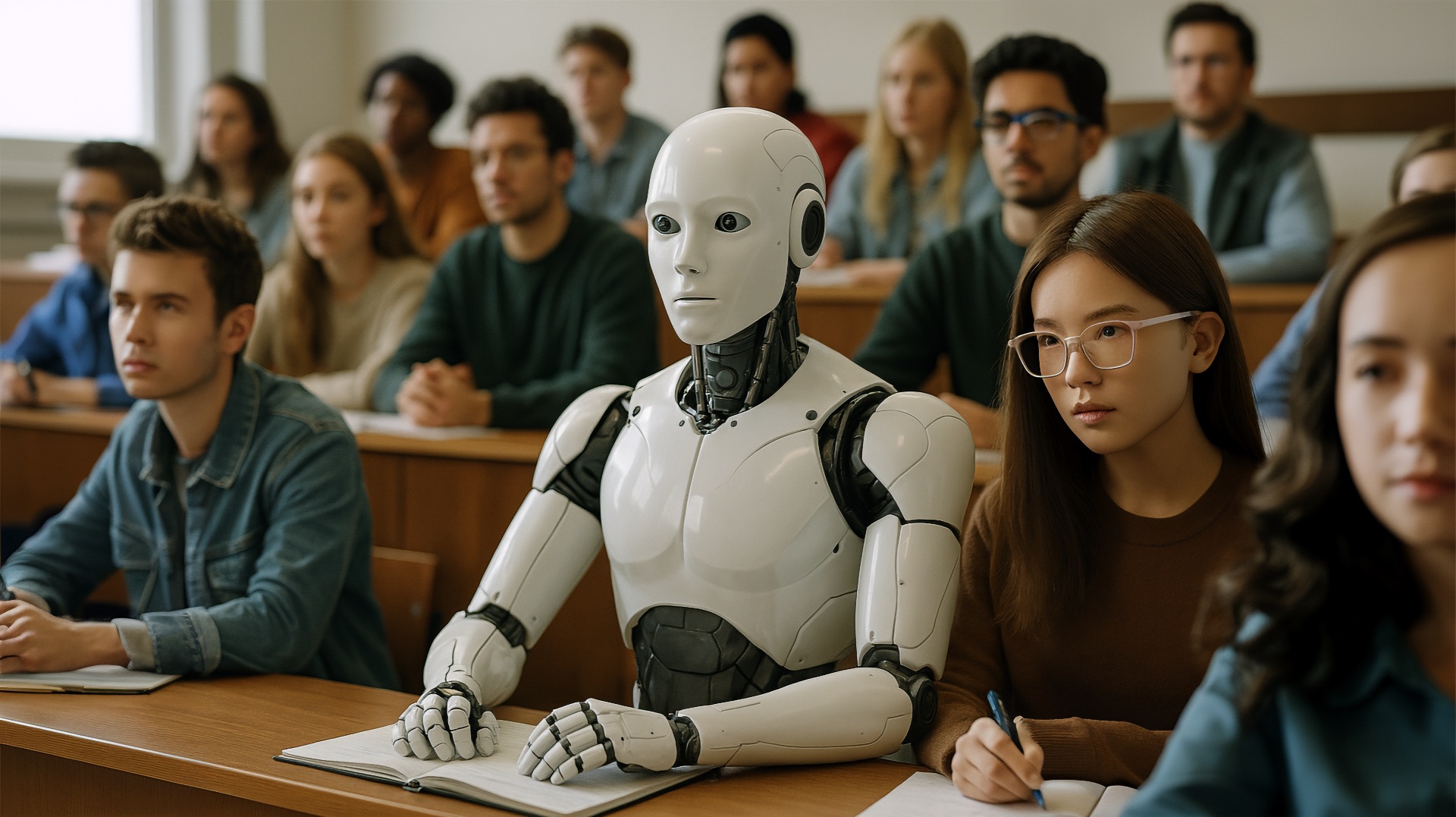

GPT-4.5 в 73% случаев убедил участников, что он живой. Ученые из Калифорнийского университета провели масштабное исследование и выяснили, что искусственный интеллект официально научился обманывать людей. В тесте Тьюринга GPT-4.5 в 73% случаев убедил участников, что он — человек. Эксперимент проходил в Сан-Диего. В нем участвовали четыре ИИ-системы (LLaMa-3.1−405B, GPT-4o, GPT-4.5, ELIZA) и 284 человека, которым предлагалось, после пятиминутного диалога, определить кто из двух собеседников является ботом. Результаты превзошли все ожидания: GPT-4.5 в 73% случаев добился успеха, сумев заверить участников в том, что он живой. Модель LLaMa-3.1 обманула собеседников в 56% случаев, а GPT-4o и ELIZA не смогли распознать 21−23% испытуемых. По мнению специалистов, самым важным фактором, повлиявшим на успех нейросети GPT-4.5, стала персонализация. Когда ИИ выдавал себя за молодого интроверта, знакомого с интернет-культурой и сленгом, люди чаще верили ему. Без такой настройки его успех падал до 36%. Ситуация неоднозначная. Эксперты полагают, что подобные результаты несут за собой определенные социальные риски. ИИ уже может незаметно заменять людей в переписке — от службы поддержки до соцсетей. Всевозможные романтические чат-боты, фейковые друзья и автоматизированные тролли — все это становится реальностью. С другой стороны, открываются новые возможности в автоматизация профессий, требующих общения (менеджеры, копирайтеры и операторы колл-центров).

GPT-4.5 в 73% случаев убедил участников, что он живой.

Ученые из Калифорнийского университета провели масштабное исследование и выяснили, что искусственный интеллект официально научился обманывать людей. В тесте Тьюринга GPT-4.5 в 73% случаев убедил участников, что он — человек.

Эксперимент проходил в Сан-Диего. В нем участвовали четыре ИИ-системы (LLaMa-3.1−405B, GPT-4o, GPT-4.5, ELIZA) и 284 человека, которым предлагалось, после пятиминутного диалога, определить кто из двух собеседников является ботом.

Результаты превзошли все ожидания: GPT-4.5 в 73% случаев добился успеха, сумев заверить участников в том, что он живой. Модель LLaMa-3.1 обманула собеседников в 56% случаев, а GPT-4o и ELIZA не смогли распознать 21−23% испытуемых.

По мнению специалистов, самым важным фактором, повлиявшим на успех нейросети GPT-4.5, стала персонализация. Когда ИИ выдавал себя за молодого интроверта, знакомого с интернет-культурой и сленгом, люди чаще верили ему. Без такой настройки его успех падал до 36%.

Ситуация неоднозначная. Эксперты полагают, что подобные результаты несут за собой определенные социальные риски. ИИ уже может незаметно заменять людей в переписке — от службы поддержки до соцсетей. Всевозможные романтические чат-боты, фейковые друзья и автоматизированные тролли — все это становится реальностью. С другой стороны, открываются новые возможности в автоматизация профессий, требующих общения (менеджеры, копирайтеры и операторы колл-центров).

![С миру по нитке (Зарубежье) [01.04.2025]](http://tesera.ru/images/items/2466277,15/125x125xpa/photo.png)