Nebul a déployé la solution open source k0rdent de Mirantis

k0rdent Open Source permet à un fournisseur européen de services cloud d'exécuter des charges de travail IA à la demande Une gestion simplifiée et une intégration fluide avec d'autres technologies - Marchés

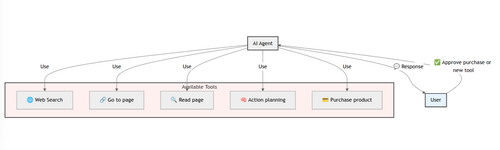

Mirantis annonce que le fournisseur de services cloud néerlandais Nebul a déployé la solution open source k0rdent pour proposer un service à la demande, permettant à ses clients d'exécuter des charges de travail d'inférence IA, un processus qui applique de nouvelles données à des modèles pré-entraînés.

Engagé en faveur de la confidentialité et de la souveraineté des données, Nebul continue d'étendre sa présence en Europe. Pionnier du calcul haute performance, de l'intelligence artificielle (IA) et du machine learning, il s'appuie sur les technologies de traitement NVIDIA pour offrir des performances optimales. Avec k0rdent, il exploite la gestion multi-cluster native de Kubernetes, intégrée à NVIDIA GPU Operator et à la technologie Gcore Everywhere Inference. (Plus de détails dans ce cas client).

Nebul est ainsi en mesure de gérer des charges de travail IA distribuées sur l'ensemble de son infrastructure, offrant une faible latence et des performances élevées. Les ressources de traitement s'adaptent dynamiquement à la demande, tandis que l'automatisation pilotée par des politiques optimisent l'utilisation des GPU pour une efficacité maximale.

Lancé le mois dernier, k0rdent aide les ingénieurs de plateforme à mieux gérer l'extension des infrastructures et la complexité des opérations à travers les différents fournisseurs de services cloud, les infrastructures sur site et les dispositifs edge. Il centralise l'application des politiques, automatise les opérations et repose sur des modèles prêts pour la production, optimisés pour les charges de travail modernes. Entièrement modulable, k0rdent s'appuie sur l'API Cluster open source, permettant ainsi de créer et de déployer des clusters Kubernetes où que ce soit.

« Alors que la demande pour les services d'IA ne cesse de croître, notre défi était de faire évoluer notre infrastructure existante », explique Arnold Juffer, PDG et fondateur de Nebul, partenaire d'élite NVIDIA, Cloud Partner et fournisseur de solutions. « L'utilisation de k0rdent nous permet d'unifier efficacement notre infrastructure hétérogène – OpenStack, Kubernetes sur bare metal – tout en abandonnant progressivement la pile technologique VMware et en basculant entièrement vers l'open source. Cela nous permet de simplifier les opérations et d'accélérer notre transition vers l'Inference-as-a-Service pour les clients entreprises. Désormais, ils peuvent simplement exécuter leur modèle d'IA entraîné sur leurs propres données, avec la garantie du respect de la confidentialité et de la souveraineté, conformément aux réglementations. C'est aussi simple que ça. »

« Comme le démontre Nebul, l'inférence IA à grande échelle nécessite une infrastructure capable de s'adapter dynamiquement aux besoins des clients finaux, afin que les applications d'IA répondent aux exigences métier en termes de coût et de performance », déclare Seva Vayner, directeur produit Cloud Edge et Edge AI chez Gcore. « Notre solution Everywhere Inference offre un portail ultra simple pour déployer et gérer l'inférence IA, tandis que notre technologie Smart Routing garantit que les tâches d'inférence sont dirigées vers les GPU les plus proches pour une latence minimale. »

.webp)

![Bilan 2024 : Les nouveautés Agorapulse pour booster votre stratégie sociale [Infographie]](https://www.agorapulse.com/fr/blog/wp-content/uploads/sites/3/2025/03/FR-New-Favorite-Agorapulse-Features-of-2024-Blogpost-Header-scaled.jpg?#)

![Et si cette entreprise française qui sécurise les sites sensibles sécurisait aussi votre foyer ? [Sponso]](https://c0.lestechnophiles.com/www.numerama.com/wp-content/uploads/2025/04/installation-videosurveillance.jpg?resize=1600,900&key=b2482d73&watermark)