La información que buscas en el móvil tiene un problema: desde 2022 es una fotocopia, y nadie está guardando el original

Cada vez que acudes a tu móvil para buscar información de lo que sea se está dando un dilema invisible y muy difícil de eliminar. En realidad, todo comenzó en el año 2022, y desde entonces, eso que llamamos Internet empezó a sacar una copia de una copia de otra copia… así hasta hoy. El problema es que, hasta ahora, nadie está guardando el “original” humano desde la llegada de ChatGPT. La metáfora de la 2GM. Lo contaba esta semana en un reportaje Insider. Muchos expertos comparan lo que está ocurriendo en la red con algo que pasó tras la Segunda Guerra Mundial. Entonces, los científicos se toparon con un problema inesperado: el acero fabricado tras las detonaciones nucleares estaba contaminado por la radiactividad que se había dispersado en la atmósfera. Para ciertos instrumentos extremadamente sensibles, como los contadores Geiger, ese acero era inútil. La solución fue rescatar acero producido antes de 1945, especialmente el que reposaba intacto en los cascos de barcos hundidos en las profundidades del océano, a salvo de la radiación. Ese material, conocido como "acero de baja radiación", se convirtió en un recurso escaso pero vital. En 3D Juegos Tras el éxito de Lilo y Stitch, toca el live-action más innecesario de Disney, pero espero que la compañía haya aprendido algo La metáfora hoy. En pleno 2025, una analogía casi idéntica está surgiendo en el entorno digital: frente a la proliferación masiva de contenidos generados por inteligencia artificial, los textos genuinamente humanos escritos antes del auge de modelos como ChatGPT están cobrando un nuevo valor. Siguiendo con aquella metáfora, esos textos son vistos como una forma de "acero limpio" digital, una materia prima sin contaminar que conserva la esencia del pensamiento humano. El colapso del modelo. La mayoría de los modelos de IA se entrenan utilizando grandes cantidades de texto extraído de internet, lo que en su día significaba datos generados por personas. A saber: artículos, foros, blogs, libros, opiniones, tutoriales. Esa base era rica, imprevisible y, sí, profundamente humana. Sin embargo, desde el lanzamiento de ChatGPT en 2022, una parte cada vez mayor de los datos disponibles la crea la IA. Qué duda cabe, esto plantea un problema grave: si las nuevas versiones de modelos aprenden de textos previos que ya han sido generados artificialmente, el ciclo se convierte en un circuito cerrado. Lo que se conoce como "colapso de modelo" ocurre cuando las IA empiezan a replicar sus propias producciones sin contacto con material humano, perdiendo creatividad, rareza, ambigüedad y profundidad. Digamos que es como fotocopiar una fotocopia repetidamente hasta que la imagen original se difumina y solo queda una silueta borrosa de lo que alguna vez fue un pensamiento auténtico. Internet sintético. Explicaban en el medio que la creciente colonización del espacio digital por contenido generado por modelos lingüísticos está alterando profundamente la experiencia de navegación y búsqueda. Ahora hay artículos optimizados para buscadores, respuestas automáticas en foros, hilos de redes sociales redactados por bots, resúmenes de noticias antes de entrar en ellas… todo ello da forma a una red que cada vez refleja menos la realidad humana y más el eco de las propias máquinas. De hecho, ya hay usuarios que, como el inversor Paul Graham, evitan a propósito el contenido publicado en los últimos años para no caer en trampas de texto artificial. En su caso, contaba que buscar cómo usar correctamente un horno de pizza le llevó a preferir entradas más antiguas, sospechando que las nuevas eran meros "cebos SEO" creados por IA sin experiencia práctica. Este cambio de paradigma se está volviendo más común, al tiempo que la autenticidad se convierte en un bien escaso dentro del vasto océano digital. Un nuevo concepto. En respuesta a esta transformación, investigadores y tecnólogos han comenzado a hablar de una nueva idea: la necesidad de conservar versiones digitales de lo que han denominado como "acero de baja radiación". Se trata de identificar y preservar textos creados antes de 2022, cuando el contenido aún estaba mayoritariamente escrito por humanos. Aquí aparecen proyectos como LowBackgroundSteel.ai que se dedican a catalogar estos recursos, desde bases de datos hasta artículos y archivos. Entre sus ejemplos está el Arctic Code Vault de GitHub, una gigantesca copia de código fuente de software libre enterrada en una mina en Noruega en 2020, o el proyecto Wordfreq, que rastreaba la frecuencia de palabras usadas en internet antes de que los patrones de lenguaje fueran distorsionados por las IAs. Incluso en algo tan específico como el uso de ciertas palabras, algunas que las IA tienden a repetir obsesivamente, perciben una contaminación estadística del lenguaje natural. En Xataka Corea del Norte lleva meses envi

Cada vez que acudes a tu móvil para buscar información de lo que sea se está dando un dilema invisible y muy difícil de eliminar. En realidad, todo comenzó en el año 2022, y desde entonces, eso que llamamos Internet empezó a sacar una copia de una copia de otra copia… así hasta hoy. El problema es que, hasta ahora, nadie está guardando el “original” humano desde la llegada de ChatGPT.

La metáfora de la 2GM. Lo contaba esta semana en un reportaje Insider. Muchos expertos comparan lo que está ocurriendo en la red con algo que pasó tras la Segunda Guerra Mundial. Entonces, los científicos se toparon con un problema inesperado: el acero fabricado tras las detonaciones nucleares estaba contaminado por la radiactividad que se había dispersado en la atmósfera.

Para ciertos instrumentos extremadamente sensibles, como los contadores Geiger, ese acero era inútil. La solución fue rescatar acero producido antes de 1945, especialmente el que reposaba intacto en los cascos de barcos hundidos en las profundidades del océano, a salvo de la radiación. Ese material, conocido como "acero de baja radiación", se convirtió en un recurso escaso pero vital.

La metáfora hoy. En pleno 2025, una analogía casi idéntica está surgiendo en el entorno digital: frente a la proliferación masiva de contenidos generados por inteligencia artificial, los textos genuinamente humanos escritos antes del auge de modelos como ChatGPT están cobrando un nuevo valor. Siguiendo con aquella metáfora, esos textos son vistos como una forma de "acero limpio" digital, una materia prima sin contaminar que conserva la esencia del pensamiento humano.

El colapso del modelo. La mayoría de los modelos de IA se entrenan utilizando grandes cantidades de texto extraído de internet, lo que en su día significaba datos generados por personas. A saber: artículos, foros, blogs, libros, opiniones, tutoriales. Esa base era rica, imprevisible y, sí, profundamente humana. Sin embargo, desde el lanzamiento de ChatGPT en 2022, una parte cada vez mayor de los datos disponibles la crea la IA.

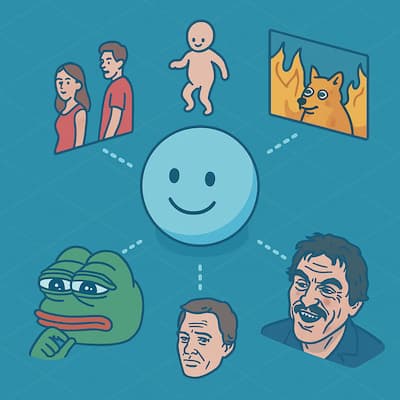

Qué duda cabe, esto plantea un problema grave: si las nuevas versiones de modelos aprenden de textos previos que ya han sido generados artificialmente, el ciclo se convierte en un circuito cerrado. Lo que se conoce como "colapso de modelo" ocurre cuando las IA empiezan a replicar sus propias producciones sin contacto con material humano, perdiendo creatividad, rareza, ambigüedad y profundidad. Digamos que es como fotocopiar una fotocopia repetidamente hasta que la imagen original se difumina y solo queda una silueta borrosa de lo que alguna vez fue un pensamiento auténtico.

Internet sintético. Explicaban en el medio que la creciente colonización del espacio digital por contenido generado por modelos lingüísticos está alterando profundamente la experiencia de navegación y búsqueda. Ahora hay artículos optimizados para buscadores, respuestas automáticas en foros, hilos de redes sociales redactados por bots, resúmenes de noticias antes de entrar en ellas… todo ello da forma a una red que cada vez refleja menos la realidad humana y más el eco de las propias máquinas.

De hecho, ya hay usuarios que, como el inversor Paul Graham, evitan a propósito el contenido publicado en los últimos años para no caer en trampas de texto artificial. En su caso, contaba que buscar cómo usar correctamente un horno de pizza le llevó a preferir entradas más antiguas, sospechando que las nuevas eran meros "cebos SEO" creados por IA sin experiencia práctica. Este cambio de paradigma se está volviendo más común, al tiempo que la autenticidad se convierte en un bien escaso dentro del vasto océano digital.

Un nuevo concepto. En respuesta a esta transformación, investigadores y tecnólogos han comenzado a hablar de una nueva idea: la necesidad de conservar versiones digitales de lo que han denominado como "acero de baja radiación". Se trata de identificar y preservar textos creados antes de 2022, cuando el contenido aún estaba mayoritariamente escrito por humanos.

Aquí aparecen proyectos como LowBackgroundSteel.ai que se dedican a catalogar estos recursos, desde bases de datos hasta artículos y archivos. Entre sus ejemplos está el Arctic Code Vault de GitHub, una gigantesca copia de código fuente de software libre enterrada en una mina en Noruega en 2020, o el proyecto Wordfreq, que rastreaba la frecuencia de palabras usadas en internet antes de que los patrones de lenguaje fueran distorsionados por las IAs. Incluso en algo tan específico como el uso de ciertas palabras, algunas que las IA tienden a repetir obsesivamente, perciben una contaminación estadística del lenguaje natural.

Amenaza a la memoria colectiva. Más allá de la calidad de los modelos y su rendimiento técnico, lo que los expertos concuerdan que está en juego es algo mucho más fundamental: nuestra capacidad colectiva de entender cómo piensan, escriben y se expresan los seres humanos. Will Allen, vicepresidente de Cloudflare, advierte que, si permitimos que los modelos se entrenen únicamente con contenido sintético, perderemos la conexión con una realidad compartida y verificable.

Contaba Insider que en campos como la medicina, el derecho o la fiscalidad, la diferencia entre un texto basado en estudios reales y uno construido sobre otros textos generados automáticamente puede tener consecuencias críticas, por decirlo suavemente. Así, a medida que el contenido generado por algoritmos gana presencia, se hace más difícil discernir lo genuino de lo derivado.

Bajo ese prisma, las perspectivas, según los tecnólogos, no son nada buenas: nuestra comprensión del mundo y de nosotros mismos podría quedar reducida a una versión empobrecida de nuestra inteligencia colectiva.

Imagen | CC: 4.0

En Xataka Móvil | Qué móvil utiliza Sam Altman, CEO de OpenAI, y qué apps usa más que ChatGPT

En Xataka Móvil | ChatGPT quiere ser la llave de tus cuentas. Un acceso hasta ahora reservado a gigantes como Apple y Google

-

La noticia

La información que buscas en el móvil tiene un problema: desde 2022 es una fotocopia, y nadie está guardando el original

fue publicada originalmente en

Xataka Móvil

por

Miguel Jorge

.