ChatGPT inventa história de pai ter matado os filhos

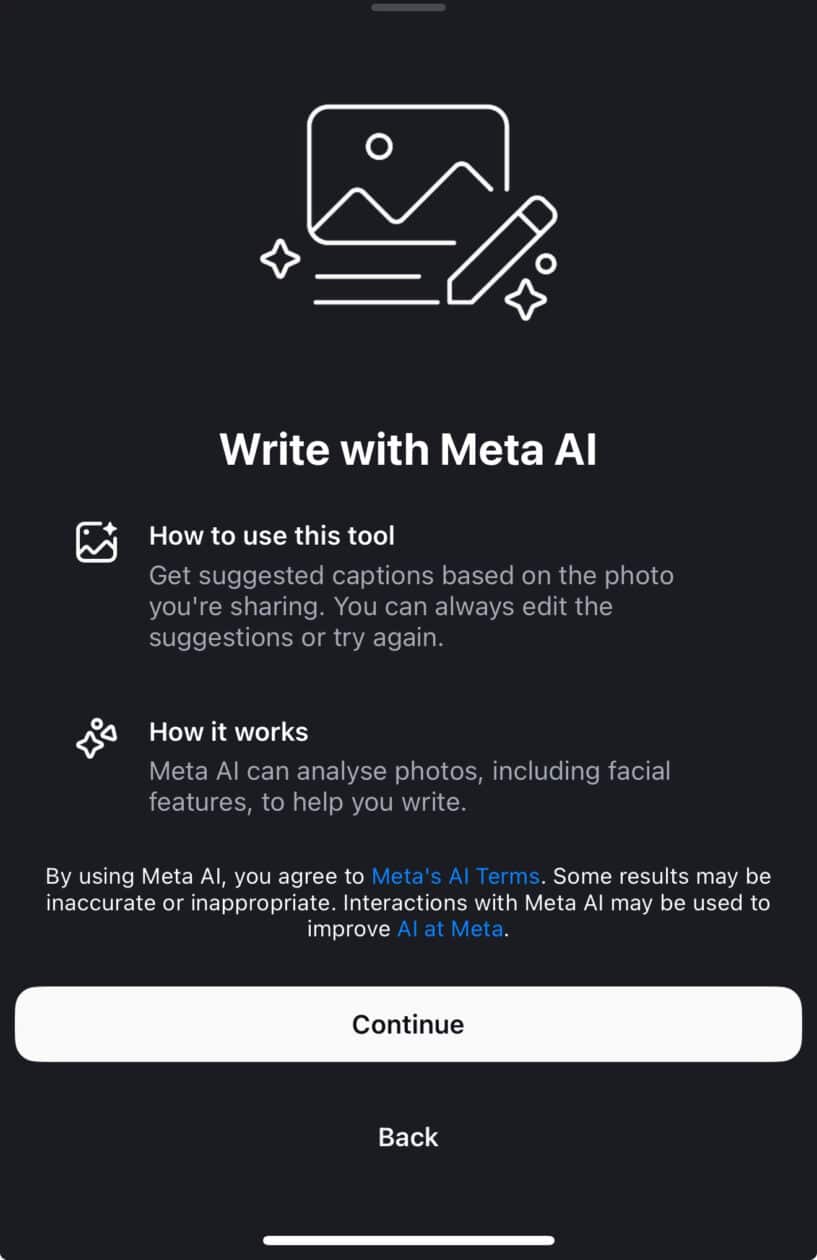

Um homem norueguês está a exigir que a OpenAI apague relatos falsos geradas pelo ChatGPT, que afirmavam ter assassinado os próprios filhos. Tal como muitas outras pessoas, Arve Hjalmar Holmen verificou o ChatGPT para saber que informações o modelo AI fornecia sobre si próprio, e ficou chocado ao encontrar uma história completamente inventada, indicando que tinha sido condenado a 21 anos de prisão por assassinar dois dos seus filhos e tentar matar um terceiro. Ainda mais preocupante, a (falsa) narrativa incluía dados reais da sua vida, como o número de filhos e a sua cidade natal, o que podia contribuir para a "credibilidade" da mesma. Apesar de a informação já não ser exibida pelo chatbot, Holmen afirma que o caso afectou sua reputação e, com o apoio do grupo de direitos digitais Noyb, apresentou uma queixa ao abrigo do Regulamento Geral de Proteção de Dados (RGPD/GDPR) exigindo a remoção completa de todos os dados falsos. A Noyb argumenta que este caso é uma demonstração flagrante da violação das regras do RGPD sobre a exactidão dos dados, que incluem o direito de corrigir ou apagar informações incorrectas. Embora a OpenAI tenha actualizado o ChatGPT para pesquisar informações em tempo real na internet em vez de depender apenas dos seus dados de treino, Holmen considera que bloquear as falsas acusações não é suficiente. Para ele, enquanto os dados falsos não forem completamente removidos, existe o risco de voltarem a surgir, temendo consequências duradouras destes falsos relatos - como criar a suspeita implícita de que ele seja "culpado", independentemente de tudo o mais que for dito a clarificar a situação. Confesso que ainda não me tinha dado ao trabalho de perguntar ao ChatGPT o que sabe sobre mim, mas felizmente (ainda?) faço parte do grupo que não matou ninguém.

Tal como muitas outras pessoas, Arve Hjalmar Holmen verificou o ChatGPT para saber que informações o modelo AI fornecia sobre si próprio, e ficou chocado ao encontrar uma história completamente inventada, indicando que tinha sido condenado a 21 anos de prisão por assassinar dois dos seus filhos e tentar matar um terceiro. Ainda mais preocupante, a (falsa) narrativa incluía dados reais da sua vida, como o número de filhos e a sua cidade natal, o que podia contribuir para a "credibilidade" da mesma. Apesar de a informação já não ser exibida pelo chatbot, Holmen afirma que o caso afectou sua reputação e, com o apoio do grupo de direitos digitais Noyb, apresentou uma queixa ao abrigo do Regulamento Geral de Proteção de Dados (RGPD/GDPR) exigindo a remoção completa de todos os dados falsos.

A Noyb argumenta que este caso é uma demonstração flagrante da violação das regras do RGPD sobre a exactidão dos dados, que incluem o direito de corrigir ou apagar informações incorrectas.

Embora a OpenAI tenha actualizado o ChatGPT para pesquisar informações em tempo real na internet em vez de depender apenas dos seus dados de treino, Holmen considera que bloquear as falsas acusações não é suficiente. Para ele, enquanto os dados falsos não forem completamente removidos, existe o risco de voltarem a surgir, temendo consequências duradouras destes falsos relatos - como criar a suspeita implícita de que ele seja "culpado", independentemente de tudo o mais que for dito a clarificar a situação.

Confesso que ainda não me tinha dado ao trabalho de perguntar ao ChatGPT o que sabe sobre mim, mas felizmente (ainda?) faço parte do grupo que não matou ninguém.