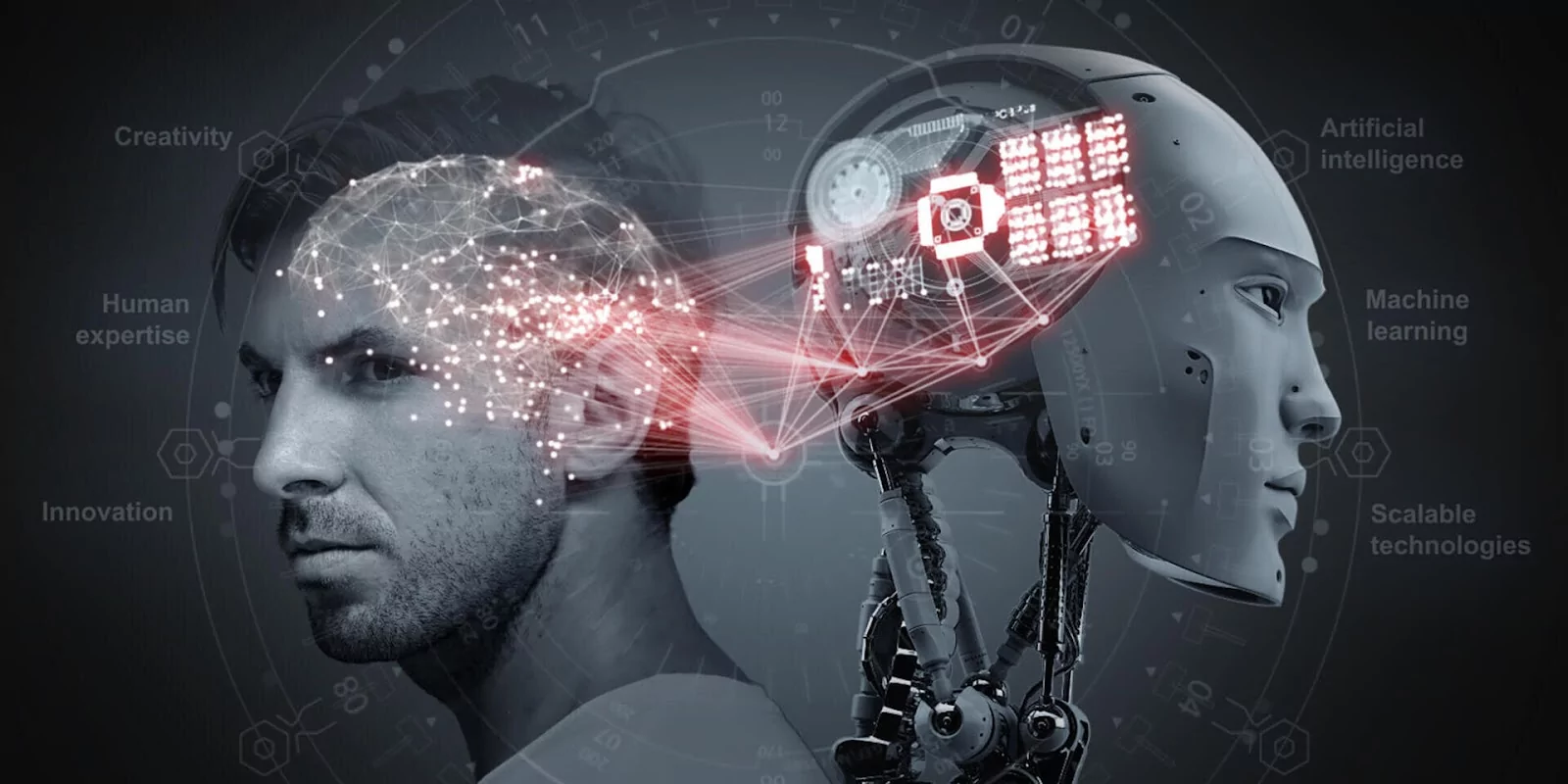

Балансировка нагрузки LLM через Nginx

В сети много примеров подключения LLM модели к Telegram-боту, но при большом числе пользователей нет руководств по распределению нагрузки между процессами — все туториалы предлагают монолит с одной репликой. Эта статья объясняет, как балансировать нагрузку бота для тысяч пользователей, в том числе, после подключения model context protocol для интеграций

В сети много примеров подключения LLM модели к Telegram-боту, но при большом числе пользователей нет руководств по распределению нагрузки между процессами — все туториалы предлагают монолит с одной репликой. Эта статья объясняет, как балансировать нагрузку бота для тысяч пользователей, в том числе, после подключения model context protocol для интеграций

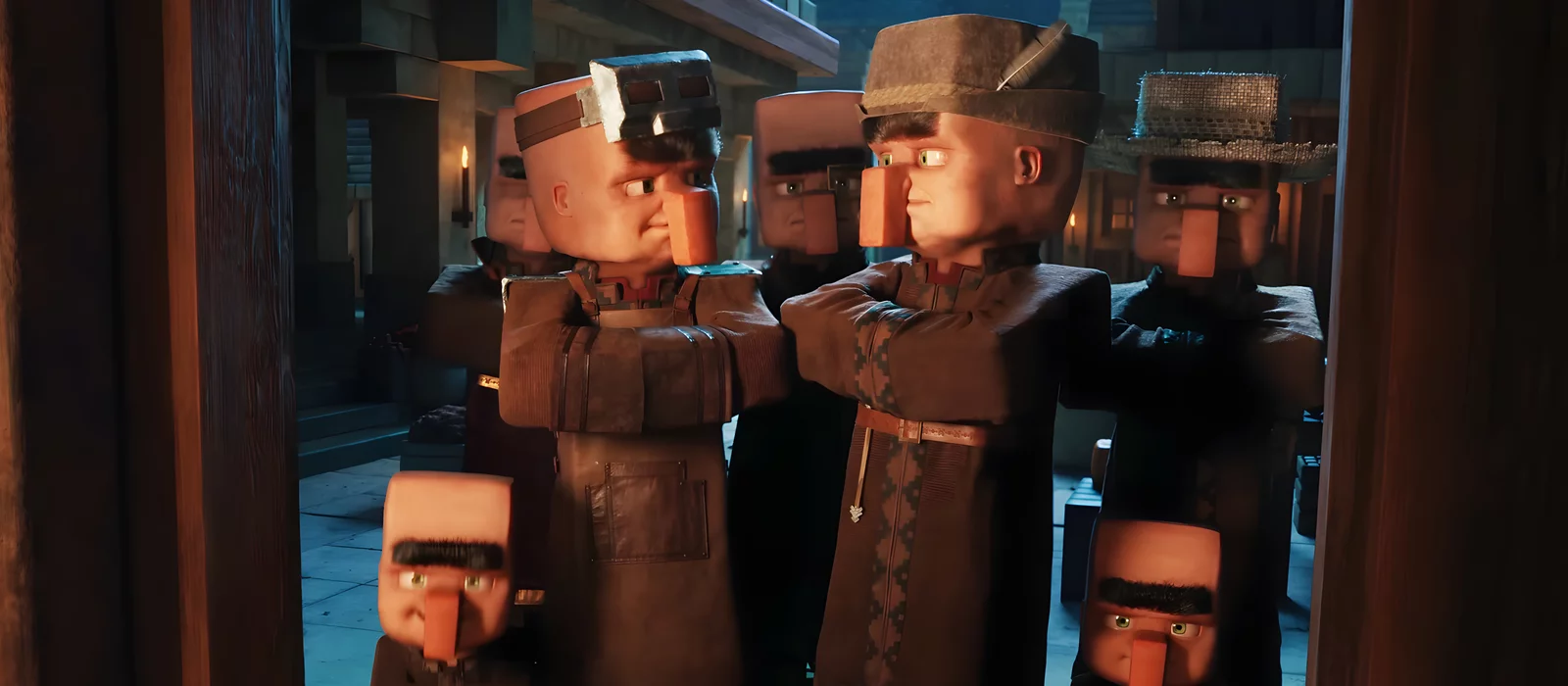

![Революция и одиночество в Аду. Обзор кооперативного «рогалика» 33 Immortals [Ранний доступ]](https://ixbt.online/gametech/covers/2025/03/25/nova-filepond-Av0xGB.png)

![С миру по нитке (Зарубежье) [01.04.2025]](http://tesera.ru/images/items/2466277,15/125x125xpa/photo.png)