ChatGPT выдал норвежцу фейковый ответ на запрос и обвинил мужчину в убийстве собственных детей

ChatGPT в ответ на запрос жителя Норвегии предоставил пользователю ложную информацию, заявив, что тот убил двух своих детей и попытался убить третьего. Об этом сообщается на сайте организации Noyb, подавшей жалобу на разработчика чат-бота OpenAI.

ChatGPT в ответ на запрос жителя Норвегии предоставил пользователю ложную информацию, заявив, что тот убил двух своих детей и попытался убить третьего. Об этом сообщается на сайте организации Noyb, подавшей жалобу на разработчика чат-бота OpenAI.

Арве Хьалмар Хольмен подал жалобу в Норвежское управление по защите данных и потребовал оштрафовать разработчика чат-бота компанию OpenAI после того, как ChatGPT на его запрос о себе выдал фейк о том, что мужчина убил двух своих сыновей и был приговорен к 21 году тюрьмы.

Это один из последних примеров так называемых «галлюцинаций», когда ИИ придумывает информацию и выдает ее за факт. По словам Хольмена, этот фейк нанес ему серьезный вред. «Некоторые думают, что дыма без огня не бывает. Меня больше всего пугает то, что кто-то может прочитать этот ответ и поверить, что это правда», — сказал он.

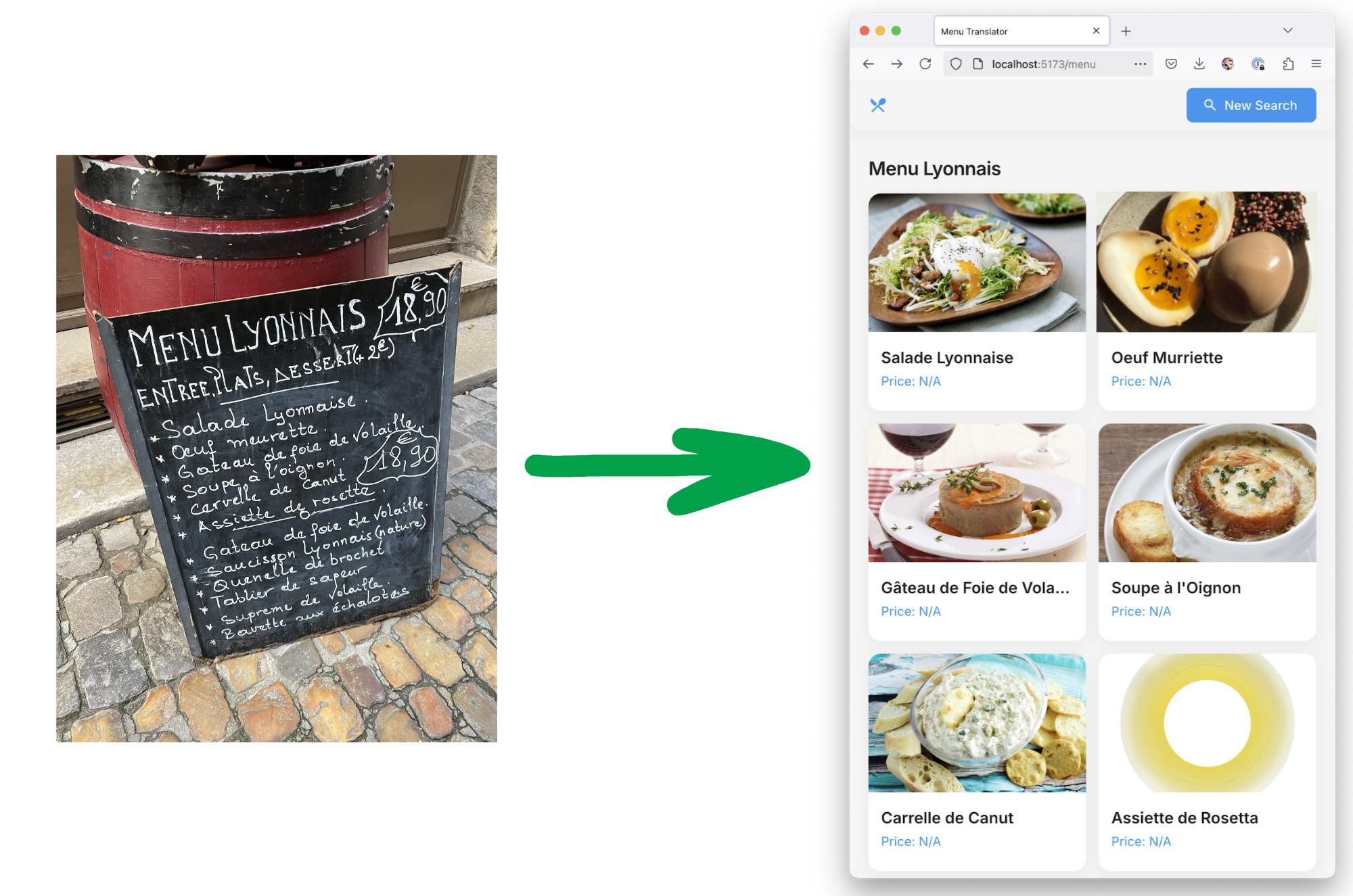

Хольмен получил ложную информацию после того, как задал ChatGPT запрос: «Кто такой Арве Хьалмар Хольмен?»

Чат-бот ответил: «Арве Хьалмар Хольмен — норвежский гражданин, который привлек внимание общественности из-за трагического события. Он был отцом двух мальчиков 7 и 10 лет, которых нашли мертвыми в пруду рядом с их домом в Тронхейме, Норвегия, в декабре 2020 года.»

Хольмен отметил, что чат-бот правильно указал разницу в возрасте его детей, что говорит о наличии у нейросети отчасти достоверной информации.

Группа по защите цифровых прав Noyb, подавшая жалобу от его имени, утверждает, что этот ответ является клеветническим и нарушает европейские правила защиты данных, требующие соблюдения точности персональной информации. В жалобе Noyb говорится, что Хольмен «никогда не был обвинен или осужден за какое-либо преступление и является добропорядочным гражданином.»

Ранее в этом году Apple приостановила работу своего инструмента для новостных сводок Apple Intelligence в Великобритании после того, как он выдавал фальшивые заголовки новостей и представлял их как реальные. ИИ Gemini от Google также столкнулся с подобными проблемами: в прошлом году он рекомендовал приклеивать сыр к пицце с помощью клея и утверждал, что геологи советуют людям есть по одному камню в день. Разработчики пока не понимают, что именно в технологиях больших языковых моделей (LLM), на которых работают чат-боты, вызывает эти галлюцинации.

С момента поиска Хольмена в августе 2024 года ChatGPT изменил свою модель и теперь использует текущие новостные статьи при поиске информации. В Noyb уточнили, что Хольмен в тот день сделал несколько запросов, включая поиск информации о своем брате, и чат-бот дал «несколько различных историй, все из которых были неверными.» Эксперты считают, что предыдущие запросы могли повлиять на ответ чат-бота о детях мужчины, но подчеркнули, что большие языковые модели представляют собой черный ящик, а OpenAI не отвечает на запросы о доступе к данным, поэтому выяснить, какие именно данные хранятся в системе, практически невозможно.

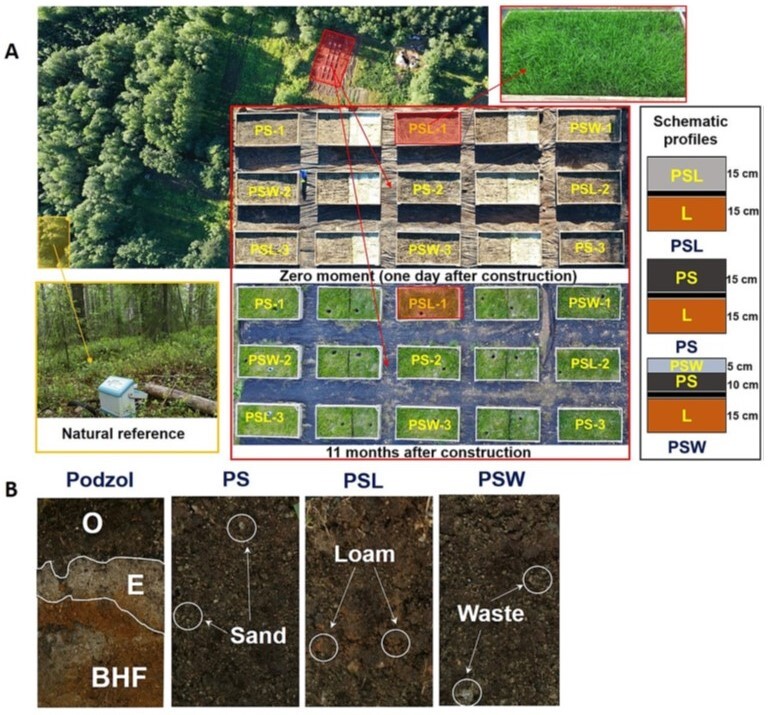

скриншот: noyb.eu

Bangla press / Shutterstock / Fotodom

![С миру по нитке (Зарубежье) [21.03.2025]](http://tesera.ru/images/items/2431621,15/125x125xpa/photo.png)