Intel explica los cambios radicales en los P-Core Lion Cove y E-Core Skymont para sus CPU Core Ultra 200S (Arrow Lake) y 200V (Lunar Lake)

Como sabemos, Intel ha dado un paso adelante en sus dos arquitecturas principales para PC y portátiles, tratándose estas de Arrow Lake y Lunar Lake. Mientras que en escritorio no han estado a la altura, y en gaming no han podido superar de manera simple y nativa a los anteriores Core 14, en portátiles el La entrada Intel explica los cambios radicales en los P-Core Lion Cove y E-Core Skymont para sus CPU Core Ultra 200S (Arrow Lake) y 200V (Lunar Lake) aparece primero en El Chapuzas Informático.

Como sabemos, Intel ha dado un paso adelante en sus dos arquitecturas principales para PC y portátiles, tratándose estas de Arrow Lake y Lunar Lake. Mientras que en escritorio no han estado a la altura, y en gaming no han podido superar de manera simple y nativa a los anteriores Core 14, en portátiles el paso adelante es significativo. Ambas arquitecturas comparten núcleos P-Core y E-Core, y aunque Lunar Lake es una versión más optimizada, hay cambios muy importantes en ellos que afectan a los Core Ultra 200S y 200V por parte de Intel. Por ello, dos ingenieros nos explican qué tuvo que hacer, en concreto, Ori Lempel, Ingeniero Senior principal del diseño de los núcleos de Intel, y Robert Hallock, ya conocido por todos aquí.

La entrevista tuvo lugar en KitGuru de la mano de su editor técnico Leo Waldock, y trataron una cantidad de temas bastante interesante, donde nos centraremos en los que hemos seleccionado como más relevantes, pero os animamos a que veáis la entrevista completa, la cual no llega a la hora y es muy interesante.

Intel habla de los cambios en los Core Ultra 200S y 200V desde el punto de vista de los núcleos, SMT, tiempos y diseño generales

La entrevista comenzó muy directa tras las presentaciones previas, y la primera pregunta fue clara: ¿con cuánta anticipación trabajan los diseñadores de Intel en la microarquitectura de núcleos? La respuesta gustará a muchos, ya que actualmente están trabajando en el nieto de Panther Lake, así que van dos generaciones por delante, o lo que es igual, Coyote Cove está más que listo y están trabajando con Griffin Cove y el sucesor de Arctic Wolf para los E-Core.

Hay un cambio importante en Intel con la llegada y uso de los nodos de TSMC que han recalcado, y es el hecho de que antes los azules creaban sus PDK, sus optimizaciones, para sus propios nodos, y todo fue bien hasta que comenzaron los retrasos en la fundición con los famosos nm+++. Por ello, Hallock dice lo siguiente a este respecto:

Ahora impulsamos nuestros productos en dos o tres nodos de forma paralela, para que puedan ser implementados en varios nodos. La decisión de cuál usar en cada producto depende del momento de mercado y del rendimiento esperado.

Es decir, Intel ya no está atado de pies y manos, le da flexibilidad para llegar en fechas, y como las librerías se han actualizado a los estándares de la industria, si un nodo interno se complica, pueden adaptar dicho PDK al nodo de TSMC y lanzar el producto a tiempo, aunque sea a costa de bajo volumen.

Panther Lake parte de Lunar Lake y se apoya en Arrow Lake para ofrecer lo mejor de ambos

Es algo que ya vimos como rumor, y aunque parece poco disruptivo en el mercado, más sabiendo lo que traerá AMD y Qualcomm, parece que hay una mejora importante, o al menos eso desprenden los ingenieros de Intel:

Desde el punto de vista del diseño o de la arquitectura, no hay realmente tantos cambios. Porque, de nuevo, estamos diseñando las piezas para que sean independientes del nodo litográfico. Tenemos algunos físicos y químicos cuya tarea es hacer que todo funcione como debe, es decir, que cumpla sus objetivos de rendimiento y de producción. Y si me permites, un apunte rápido: Panther Lake es básicamente un derivado de Lunar Lake. Ha evolucionado desde Lunar Lake.

Sabemos lo que quiere el mercado, estoy pensando en tus lectores, lo que quieren ver y lo que han estado pidiendo… Está diseñado para combinar el multihilo de Arrow Lake con la eficiencia energética de Lunar Lake. Es una simplificación burda, pero ese es el objetivo del producto.

Cada Tile tiene un equipo de desarrollo independiente

Uno de los aspectos menos relevantes, que quiero citar, es cómo está organizado Intel realmente, porque en contra de lo que se pueda pensar, una CPU actualmente tiene varios grupos independientes, no saben qué están haciendo exactamente, y tampoco importa. Cada grupo trabaja en un área distinta, en este caso, en los núcleos, pero el apartado del SoC lo gestiona otro grupo distinto.

Todos siguen unas directrices específicas de trabajo para lograr cada objetivo, son múltiples, el de los Cores, el de memoria, el de los I/O, el de energía, para poder diseñar una arquitectura general, es totalmente modular, como los Tiles.

Y recalco esto porque una vez que todas las ingenierías se unen para formar el puzle puede que ya sea tarde y haya importantes cuellos de botella porque unos equipos han avanzado más que otros, hay compromisos en el rendimiento, o buses.

Eso es precisamente lo que hemos visto con Arrow Lake y cómo Lunar Lake, aun llegando antes al mercado y siendo una versión mejorada, palió los problemas del primero logrando un mejor rendimiento por vatio.

La división interna de Intel a base de bloques funcionales (FUB) que ahora son particiones

Esto es también interesante de comentar, puesto que los ingenieros afirman que antiguamente hacían su trabajo con los llamados FUB, o bloques funcionales, pero ahora no lo hacen así:

Antes teníamos FUB: bloques funcionales. Un controlador de caché, un predictor de saltos, una unidad vectorial… Cada uno se diseñaba por separado y luego se integraban en el núcleo. Digamos que tenías 300 de esos, cada uno con decenas de miles de celdas. Ahora hemos ido al otro extremo: nuestro núcleo completo se divide en solo seis particiones, cada una con más de un millón de celdas.

Es otra escala completamente distinta. Nadie en la industria tenía herramientas de diseño con esa capacidad hace 10 años, y mucho menos hace 20. Y que además funcionaran a las frecuencias, o en la curva voltaje/frecuencia, que nosotros manejamos. Así que hicimos ese cambio radical, y eso conlleva un método de trabajo totalmente diferente: herramientas diferentes, metodologías diferentes.

Es mucho más eficiente en cuanto a área, porque cuanto menos granular es tu diseño, menos espacio en blanco acumulas. El espacio en blanco tiende a acumularse en los bordes de cada bloque, ya que todo quiere colocarse en el centro, en la posición óptima. Si divides en muchas piezas pequeñas, hay más bordes, más acumulación de espacio perdido.

Si tienes menos piezas, hay menos lugares donde se acumule ese espacio blanco, y puedes compactar más el diseño. Así que nuestra utilización del silicio es mucho más alta que antes. Eso nos permite meter más contenido por generación de núcleo. El sobrecoste de integración también es menor, porque integrar seis cosas es mucho más fácil que integrar 300.

Nuestra velocidad de iteración es mucho más rápida, nuestros ciclos de convergencia también, lo que nos permite hacer tres cosas:

Ser independientes del proceso, como mencioné antes, porque usamos el mismo flujo de diseño.

Salir al mercado más rápido, porque lleva menos tiempo convertir ese diseño RTL en un núcleo real.

Crear derivados más rápidamente, como ya expliqué, para cubrir tanto el extremo de alto rendimiento como el de ultra eficiencia.

Intel ya usa IA en el diseño de sus arquitecturas generales y microarquitecturas

Otro apartado interesante a tratar, ya que como vimos en el evento Vision 2025, Lip-Bu Tan, como nuevo CEO de Intel, quiere usar más IA en los diseños, de manera que todo sea más rápido y optimizado. Lógicamente, la pregunta era obvia, ¿Intel está usando ya IA en sus diseños para optimizarlos?:

Diré esto: la usamos bastante. No tanto como aparentemente quiere nuestro nuevo CEO, pero la usamos. Puedo mencionar dos cosas que no son demasiado sensibles:

En la validación lógica del diseño -> Usamos IA para reducir la cantidad de pruebas necesarias para cubrir la mayoría de los casos límite o puntos de validación interesantes. Puedes ejecutar 10,000 o 20,000 pruebas por regresión, lo cual lleva tiempo y consume muchos recursos. Si puedes usar IA para compactar esa regresión —cubrir el diseño con menos pruebas, menos tiempo de ejecución y menos máquinas—, obtienes una respuesta más rápida. Y eso lo hacemos.

En la síntesis -> Usamos IA para optimizar la síntesis. Puedes orientar el proceso hacia más rendimiento o más eficiencia energética, y hay herramientas de IA que te permiten optimizar el "place and route" en función de ese sesgo: más rendimiento o menos consumo, por ejemplo.

El adiós al SMT y cómo de complicado fue tras décadas en Intel

Como sabemos Arrow Lake dijo adiós al SMT en escritorio, y Lunar Lake lo hizo en portátiles, pero, ¿les fue fácil diseñar los núcleos P-Core y E-Core desde cero sin esta tecnología o fue solo "quitar cosas de la microarquitectura"? Ori responde lo siguiente:

Esa es una forma muy simplificada de decirlo: sí, quitas cosas. Pero el reto no era eliminar SMT, sino rediseñar el núcleo para que esté optimizado para un solo hilo. Solo eliminar lógica o quitar transistores no sería motivo suficiente para hacerlo. Hemos diseñado un núcleo completamente nuevo, mucho más eficiente y más pequeño, precisamente porque eliminamos SMT.

Y ahí es donde realmente está el beneficio: ahora somos más eficientes en área y en consumo, gracias a no tener SMT en este núcleo.

Intel ahorró un 15% en área y consumo retirando SMT

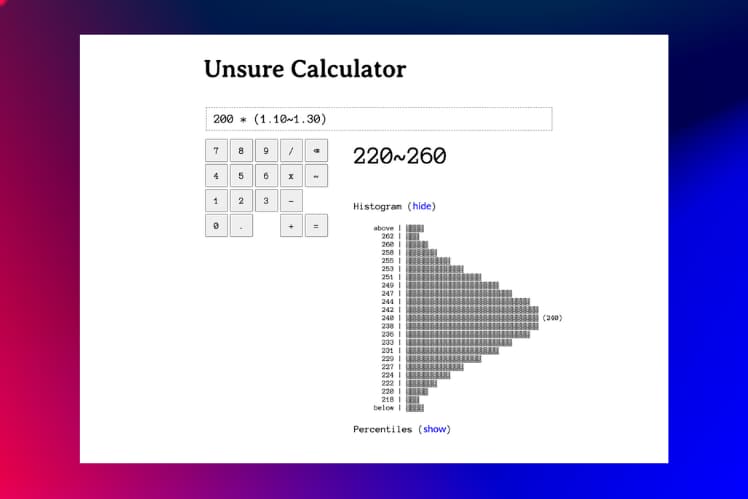

Tras esto, colocaron una serie de diapositivas para medir el llamado P&P, es decir, el Performance per Power, y la explicación evidencia la complejidad de crear algo así desde cero:

Estoy midiendo IPC (instrucciones por ciclo), que es un indicador del rendimiento, y Cinebench, que representa el consumo y el área. Cuando tienes un núcleo con capacidad SMT pero con SMT desactivado, ese es nuestro punto de referencia: todo vale 1. Ahora, si activas SMT en ese núcleo, obtienes un 30 % más de rendimiento, pero también un 20 % más de consumo. Obviamente el área es la misma porque el núcleo no cambia.

Lo que hemos hecho es quitar SMT y rediseñar el núcleo específicamente para un solo hilo. Así que tenemos el mismo IPC (porque ejecutamos el mismo hilo sobre la misma microarquitectura), pero hemos ahorrado aproximadamente un 15% de área y un 15% de consumo. Entonces, ¿cómo se compara esto?

Bueno, si mides rendimiento por potencia (P&P) y comparas este núcleo optimizado para un solo hilo con un núcleo SMT con SMT apagado, salimos ganando: mismo rendimiento, pero menos consumo y menos área. Y si mides rendimiento por potencia por área (es decir, cuán eficiente es tu cómputo en una determinada área de silicio), estamos mucho mejor, aproximadamente un 40% más eficiente. Pero eso no es la gran noticia.

Lo importante es cómo nos comparamos frente al núcleo con SMT activado. Resulta que aún salimos ganando en rendimiento por potencia: un 8,5% más. Estos no son valores exactos, depende de la carga de trabajo y cuánto se beneficie del SMT, pero es una media o una regla general. También salimos ganando en rendimiento por potencia por área (PPA). Donde perdemos un poco es en densidad de hilos: con el mismo espacio físico, un núcleo con SMT puede ofrecer más rendimiento si todo lo demás es igual.

Los cambios en los Intel Core Ultra 200S y 200V sientan la base del futuro de los procesadores, también con caché vertical

Por último y para finalizar, ya que el artículo está siendo muy extenso, Ori comentó que eliminar SMT implica algunas ventajas y desventajas extra. Comenzando por lo bueno, el no incluirla implica que no habrá problemas de seguridad por ataques de tipo canal lateral, que son todos los últimos que hemos visto en estos tres años anteriores.

Además, al no disponer de SMT, afirma que Intel puede avanzar más rápido en el diseño de arquitecturas, ya que no tienen "nada que romper" relacionado con SMT. Veremos qué nos depara Panther Lake con los cambios en la microarquitectura en tan solo unos meses, pero en principio, es solo una evolución de Lunar Lake que llevará todo un paso más allá, pero no será nada extraordinario. Y hasta aquí los cambios en los Intel Core Ultra 200S y 200V, que como vemos, van más allá de lo simple que muestran las diapositivas y suponen un paso adelante de los azules de cara al futuro más próximo.

La entrada Intel explica los cambios radicales en los P-Core Lion Cove y E-Core Skymont para sus CPU Core Ultra 200S (Arrow Lake) y 200V (Lunar Lake) aparece primero en El Chapuzas Informático.