Grok, Signal e sorveglianza: il nuovo volto del controllo nei dipartimenti federali USA

Secondo quanto rivelato da Reuters, l’amministrazione Trump starebbe utilizzando l'AI Grok per spiare sentiment anti-Trump e anti-Musk.

Secondo quanto rivelato da un’indagine della Reuters, l’amministrazione Trump starebbe utilizzando l’intelligenza artificiale sviluppata da Elon Musk, in particolare il chatbot Grok, in modo controverso all’interno delle agenzie federali.

A renderlo ancor più preoccupante sarebbe il ruolo centrale della Department of Government Efficiency (DOGE), creata con l’intento dichiarato di ottimizzare l’efficienza amministrativa, ma accusata di intervenire in modo opaco e coercitivo. Due dipendenti anonimi dell’Environmental Protection Agency (EPA) hanno raccontato di una crescente pressione interna, alimentata da una ricerca sistematica, realizzata tramite software di messaggistica e strumenti collaborativi, di contenuti “anti-Trump” o “anti-Musk”.

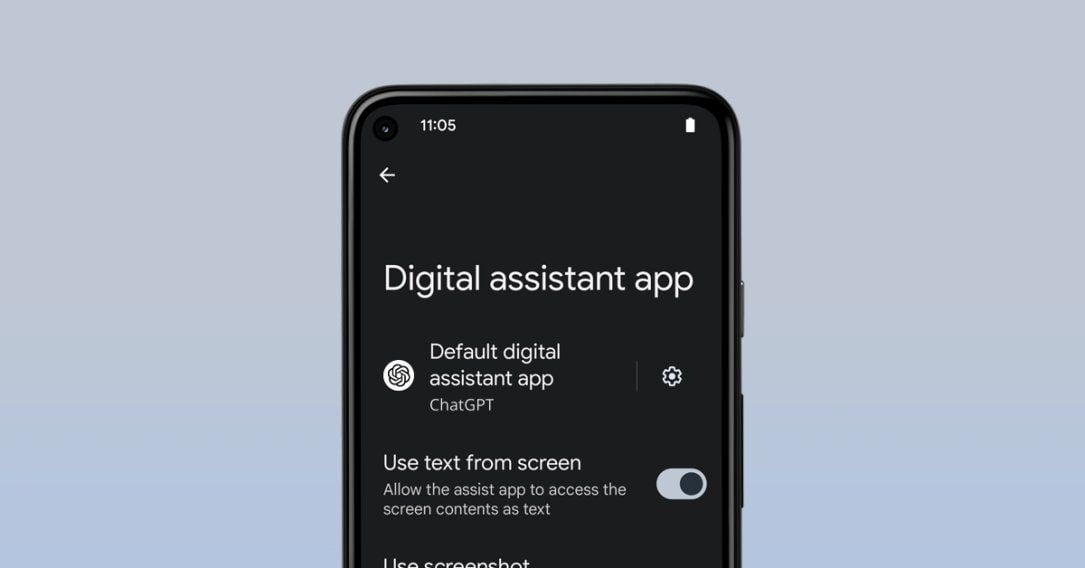

Lo strumento cardine di questa operazione sarebbe appunto Grok, l’intelligenza artificiale creata dal magnate di SpaceX e xAI, che consentirebbe una sorveglianza capillare sulle comunicazioni interne delle agenzie.

Un algoritmo al servizio della lealtà: il coinvolgimento dell’IA nella pubblica amministrazione di Trump

Sebbene la sorveglianza non sia mai stata ufficialmente confermata, fonti interne all’EPA hanno riferito che la dirigenza ha avvertito i lavoratori di “fare attenzione a ciò che dicono, scrivono e fanno”. Strumenti come Microsoft Teams e altre app di comunicazione interna sarebbero sotto esame, secondo quanto riportato.

Il risultato: un clima di autocensura tra i funzionari pubblici, preoccupati per una possibile rappresaglia disciplinare legata alle loro opinioni personali o allineamento con l’agenda presidenziale. L’EPA risulta essere tra le agenzie più colpite, con addirittura 600 dipendenti messi in congedo a partire da gennaio.

L’amministrazione Trump ha inoltre espresso l’intenzione di tagliare fino al 65% del budget dell’agenzia, un’azione che potrebbe comportare conseguenze drammatiche in termini di funzionamento e personale.

Caccia ai “non allineati”: il lato oscuro dell’IA

Le accuse che riecheggiano da più parti, sia tra Democratici che Repubblicani, suggeriscono che la strategia di riduzione organica sia una purga ideologica, mascherata da razionalizzazione amministrativa. Secondo queste voci, scopo non dichiarato di DOGE sarebbe quello di espellere dipendenti neutrali o critici del governo, per rimpiazzarli con fedelissimi disposti a ignorare eventuali irregolarità. Un portavoce dell’EPA ha tuttavia negato categoricamente le accuse, bollando il reportage come “completamente falso” e precisando che l’agenzia “non monitora o registra chiamate telefoniche, riunioni o voci di calendario”.

DOGE e la zona grigia della legalità

Il velo di discrezione che avvolge le attività di DOGE ha dato adito a forti critiche, soprattutto per il suo status all’interno dell’Ufficio Esecutivo del Presidente, che la renderebbe esente dalle normali leggi di registrazione e conservazione dei documenti federali. Secondo Reuters, questa ambiguità normativa viene utilizzata per aggirare normative sulla sicurezza dei dati e per commettere presunte violazioni etiche.

In quanto impiegato governativo speciale, Musk è obbligato a non sfruttare la propria posizione per trarne vantaggi personali o per le proprie imprese. Ma l’inserimento del suo chatbot AI nei sistemi governativi solleva forti dubbi: questo accesso favorirebbe la raccolta di dati sensibili, potenzialmente utili per finalità imprenditoriali.

Non è la prima volta che circolano voci su un possibile utilizzo dell’intelligenza artificiale per sostituire dipendenti pubblici. Già prima della rielezione di Trump, un insider aveva riferito che Musk avesse suggerito di usare Grok per automatizzare il lavoro governativo, grazie alla vasta mole di dati statali disponibili per l’addestramento dell’IA.

Signal, Google Docs e il labile confine della trasparenza

Un altro punto oggetto di forte contestazione riguarda l’uso dell’applicazione Signal, famosa per il meccanismo di auto-cancellazione dei messaggi. Secondo una causa legale, utilizzare app del genere per comunicazioni ufficiali ostacolerebbe le leggi sulla libertà d’informazione, creando barriere all’accesso dei dati pubblici.

DOGE sarebbe ricorsa anche a metodi poco ortodossi per evitare qualsiasi forma di supervisione documentale. Fonti del governo riferiscono che Google Docs sia utilizzato per la stesura simultanea e condivisa di documenti ufficiali, in modo da evitare la tracciabilità di più bozze inviate per email — un modo rapido ed efficiente per operare, ma fuori dai protocolli di conservazione dei documenti.

Privacy violata? Il caso della raccolta dati dal Dipartimento dell’Istruzione

Un’altra preoccupante denuncia arriva da un procedimento federale, secondo il quale l’amministrazione USA avrebbe abusato dei dati provenienti dal Dipartimento dell’Istruzione. I querelanti sostengono che DOGE abbia acquisito informazioni personali di decine di milioni di americani senza il loro consenso. I dati raccolti includerebbero redditi, numeri di previdenza sociale, date di nascita, indirizzi di residenza, stato civile e cittadinanza, utilizzati, secondo le accuse, “con lo scopo di distruggere” il Dipartimento.

A marzo, un giudice federale ha ordinato a DOGE di consegnare i documenti richiesti dall’organizzazione Citizens for Responsibility and Ethics in Washington, che aveva intrapreso un’azione legale proprio per ottenere maggiore trasparenza attraverso il Freedom of Information Act. Ma, ad oggi, nessun documento è stato ancora fornito.

L’intelligenza artificiale: arma di efficienza o strumento di controllo?

Un ultimo elemento di riflessione riguarda l’effettivo impiego dell’intelligenza artificiale all’interno dell’EPA. Mentre l’agenzia nega categoricamente l’uso dell’IA come criterio per decisioni sul personale, ammette tuttavia che sta esaminando l’uso di queste tecnologie per “ottimizzare funzioni amministrative”.

La distinzione è sottile, ma cruciale: da una parte c’è l’efficienza promessa dall’innovazione digitale, dall’altra il rischio di un controllo centralizzato e non trasparente delle istituzioni pubbliche. In un’epoca in cui l’intelligenza artificiale promette di rivoluzionare ogni aspetto della società, dai trasporti alla sanità, il suo impatto sulla democrazia rimane una zona d’ombra ancora troppo poco indagata.

Il caso DOGE, tra accuse, negazioni e richieste di chiarezza, diventa quindi il banco di prova di un futuro in cui il confine tra innovazione ed etica può diventare pericolosamente sottile.

/https://www.ilsoftware.it/app/uploads/2024/06/YouTube-Music.jpg)

/https://www.ilsoftware.it/app/uploads/2023/06/OpenAI-Logo-GPT-ChatGPT-IA-min.jpg)

/https://www.html.it/app/uploads/2024/12/Nextjs.jpg)