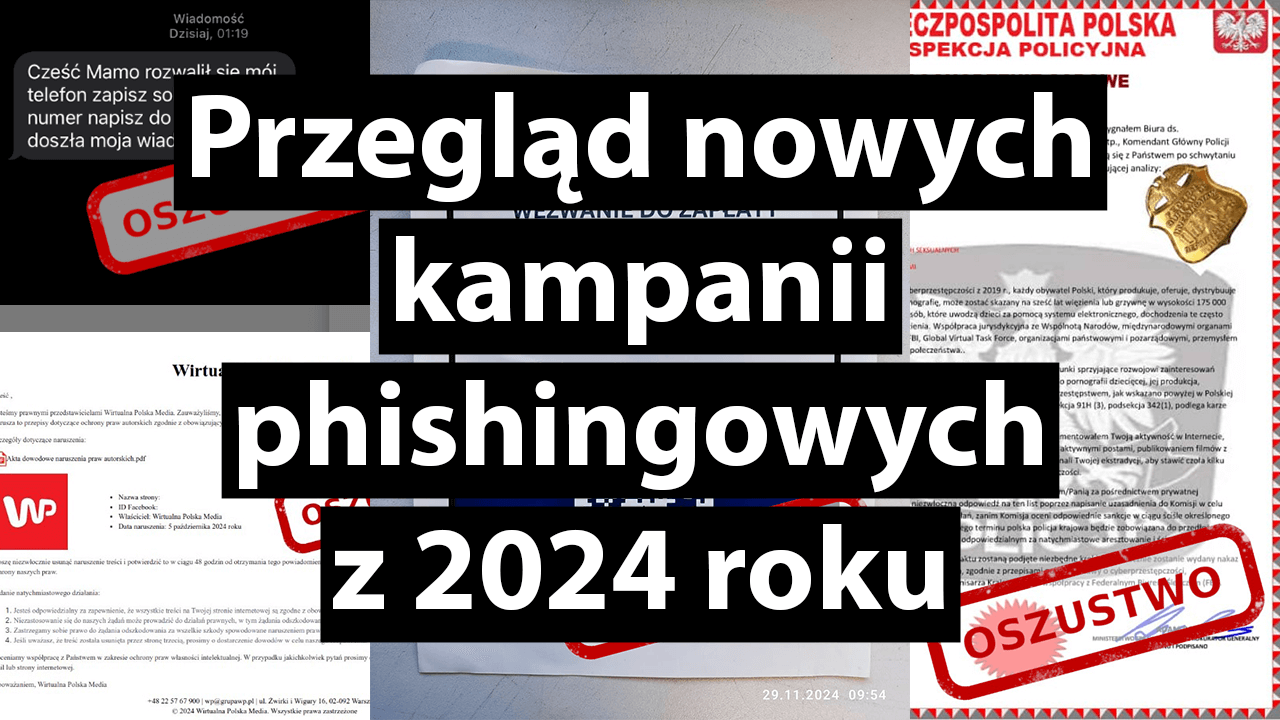

ChatGPT doskonale podrabia paragony. A to może w przyszłości pomóc oszustom

Wraz z premierą modelu GPT-4o OpenAI udostępniło nową wersję generatora obrazów. Użytkownicy zdążyli już zauważyć, że bardzo dobrze radzi sobie on z odwzorowywaniem tekstów i znaleźli dla niego nowe zastosowanie: podrabianie paragonów. Efektami swoich eksperymentów podzielili się na platformie X. Jeden z twórców publikuje zdjęcie podrobionego paragonu ChatGPT, który jeszcze niedawno wypadał najgorzej w testach […] Artykuł ChatGPT doskonale podrabia paragony. A to może w przyszłości pomóc oszustom pochodzi z serwisu ANDROID.COM.PL - społeczność entuzjastów technologii.

Wraz z premierą modelu GPT-4o OpenAI udostępniło nową wersję generatora obrazów. Użytkownicy zdążyli już zauważyć, że bardzo dobrze radzi sobie on z odwzorowywaniem tekstów i znaleźli dla niego nowe zastosowanie: podrabianie paragonów. Efektami swoich eksperymentów podzielili się na platformie X.

Jeden z twórców publikuje zdjęcie podrobionego paragonu

ChatGPT, który jeszcze niedawno wypadał najgorzej w testach darmowych generatorów obrazków, zyskał spore ulepszenie przy ostatniej aktualizacji. A to skłoniło użytkowników do przeprowadzenia szczegółowych testów.

Przeczytaj także: Najlepszy mały smartfon w 2025 roku

Narzędzie wziął pod lupę m.in. Deedy Das – inwestor i twórca internetowy. W poście na platformie X opublikował zdjęcie paragonu, które zostało wygenerowane przez ChatGPT. I chociaż sam dokument został spreparowany, to pochodził z restauracji, która faktycznie istnieje (i wciąż działa w San Francisco).

Pod jego postem szybko pojawiły się kolejne zdjęcia fałszywych paragonów – twórcy dodawali do nich plamy i zagniecenia, aby upodobnić je do oryginałów. Nie obyło się jednak bez charakterystycznych dla sztucznej inteligencji błędów.

TechCrunch twierdzi, że niedociągnięcia można łatwo poprawić w dowolnym edytorze graficznym, jednak wciąż nie eliminuje to głównego problemu: z fałszywego paragonu nie skorzystamy, jeśli sprzedawca nie znajdzie go w systemie. Posługiwanie się falsyfikatem może nas więc narazić na niepotrzebne problemy.

OpenAI nie widzi zagrożenia

Kwestia posługiwania się podrobionym paragonem to jedno – użytkownicy zaczęli zastanawiać się, czy gigant zdaje sobie sprawę z możliwych nadużyć. Bo patrząc na fakt, że OpenAI chce omijać prawo autorskie, podejście do tej kwestii może być różne.

Głos w sprawie zabrała rzeczniczka firmy, Taya Christianson, która zapewniała, że wszystkie generowane obrazy zawierają metadane świadczące o ich sztucznym pochodzeniu. Dodała też, że OpenAI podejmuje działania wobec użytkowników naruszających regulamin.

Na pytanie, czy pozwalanie na generowanie fałszywych paragonów jest zgodne z polityką OpenAI, Christianson odpowiedziała, że firma „stawia na kreatywną wolność” i widzi w tym narzędziu potencjał edukacyjny – na przykład w nauce finansów lub tworzeniu reklam produktów. A to oznacza, że do nałożenia ograniczeń raczej nie dojdzie.

Źródło: TechCrunch, X. Zdjęcie otwierające: Photo Agency / Shutterstock

Część odnośników to linki afiliacyjne lub linki do ofert naszych partnerów. Po kliknięciu możesz zapoznać się z ceną i dostępnością wybranego przez nas produktu – nie ponosisz żadnych kosztów, a jednocześnie wspierasz niezależność zespołu redakcyjnego.

Artykuł ChatGPT doskonale podrabia paragony. A to może w przyszłości pomóc oszustom pochodzi z serwisu ANDROID.COM.PL - społeczność entuzjastów technologii.

![Weekendowa Lektura: odcinek 617 [2025-03-29]. Bierzcie i czytajcie](https://zaufanatrzeciastrona.pl/wp-content/uploads/2024/02/library.jpg)

![Dorastanie na Marsie [niepublikowany nigdzie indziej fragment książki]](https://naukatolubie.pl/app/uploads/2025/03/Niespokojnepokolenie_blog.png)

![Ali Alkhatib o biurokracji i utopii algorytmów [wywiad]](https://panoptykon.org/sites/default/files/2025-03/pismo-kwestionariusz-nguyen-dang-.jpg)