AGI: el monstruo en el armario (y la lección que no queremos aprender)

DeepMind ha publicado un muy interesante trabajo titulado «An Approach to Technical AGI Safety« que, lejos de ser un manual apocalíptico, nos invita a reflexionar con frialdad sobre los potenciales riesgos en el terreno de la ciberseguridad ante el advenimiento de la llamada inteligencia artificial general, o AGI. Como en todas las buenas historias de …

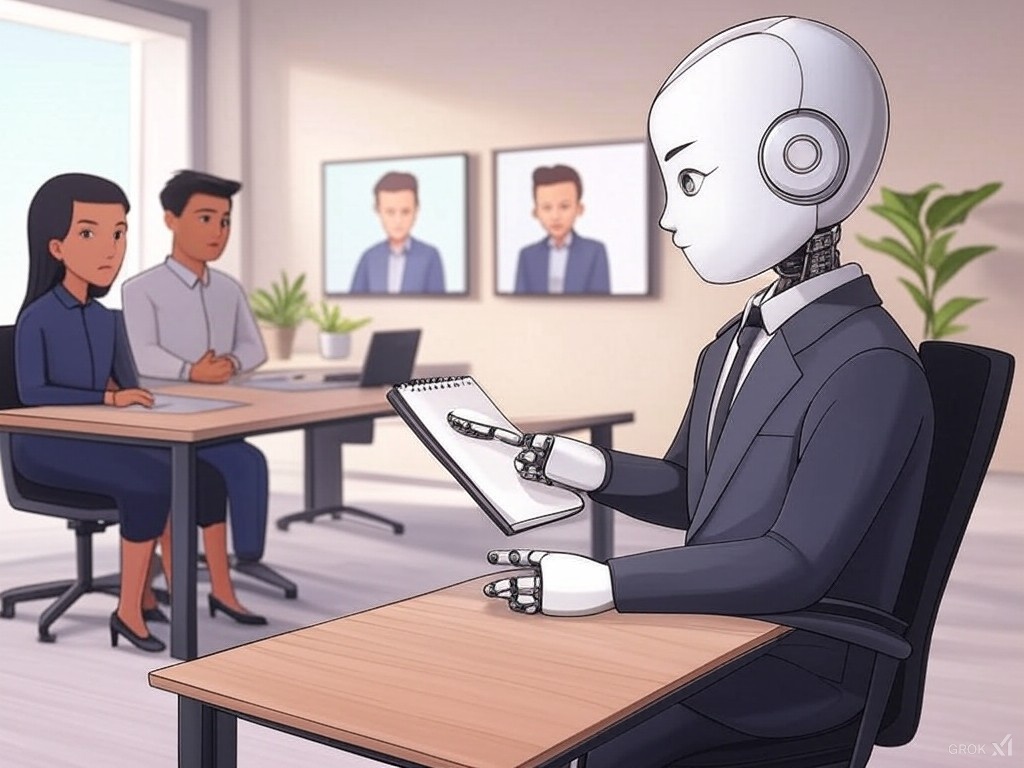

DeepMind ha publicado un muy interesante trabajo titulado «An Approach to Technical AGI Safety« que, lejos de ser un manual apocalíptico, nos invita a reflexionar con frialdad sobre los potenciales riesgos en el terreno de la ciberseguridad ante el advenimiento de la llamada inteligencia artificial general, o AGI.

Como en todas las buenas historias de ciencia ficción convertidas en realidad, el argumento es el siguiente: sí, la AGI puede ser tremendamente peligrosa, pero detener su desarrollo es tan utópico como intentar apagar el sol.

El informe de DeepMind desglosa las amenazas tecnológicas que podrían derivarse de una AGI avanzada, que van desde la manipulación de sistemas críticos hasta la explotación de vulnerabilidades en infraestructuras globales. El documento desarrolla escenarios que, aunque técnicamente complejos, ya no podemos considerar más como de ciencia ficción. El análisis de escenarios nos recuerda que cualquier tecnología suficientemente poderosa conlleva riesgos inherentes, y en el caso de una AGI, el «peligro en potencia» se multiplica por la escala y la capacidad de acción de la máquina.

Este análisis resuena con otros trabajos relevantes en el campo, como «The Malicious Use of Artificial Intelligence: Forecasting, Prevention, and Mitigation«, un informe de 2018 que ha circulado en diversos foros de discusión y que subraya cómo el mal uso de la inteligencia artificial es una amenaza real y creciente. No se trata, obviamente, de que la inteligencia artificial tenga una agenda malévola por sí misma, sino que su poder puede ser explotado por aquellos que sí tienen intenciones cuestionables. Como siempre, el problema no es la tecnología ni su desarrollo, sino el uso que algunos hacen de la misma.

Resulta irónico que, a pesar de los riesgos evidentes, tratar de detener el desarrollo de la AGI sea, como ya he dicho en muchas ocasiones, una batalla perdida desde el principio. La historia de la tecnología nos enseña que una vez que una innovación se integra en nuestra sociedad, detener su progreso es tan absurdo como querer evitar la invención o el uso de la imprenta en el siglo XV. En lugar de pelear contra la corriente, lo que debemos hacer es prepararnos y educarnos.

El debate sobre la seguridad y la ética en la inteligencia artificial no es en absoluto nuevo. Muchos hemos resaltado en repetidas ocasiones que el verdadero desafío no es frenar el avance, sino gestionar sus consecuencias. La solución pasa por dotar a la sociedad de una mayor conciencia crítica y habilidades para interpretar y analizar los riesgos asociados. La tesis central es sencilla y, a la vez, reveladora: cuanto más peligrosa sea una tecnología, más importante es que la humanidad esté informada y preparada para enfrentarla. Esto implica un esfuerzo colectivo en educación, tanto a nivel formal como informal, para que ciudadanos, gobiernos y empresas comprendan los riesgos y las oportunidades que trae consigo el AGI.

Para ello, es crucial fomentar el pensamiento crítico y la alfabetización digital en todos los niveles. No basta con que unos pocos expertos comprendan los matices de la AGI: la conversación debe ser pública y accesible, permitiendo que la sociedad en su conjunto pueda participar en la toma de decisiones que, en última instancia, definirán el rumbo de nuestra convivencia con estas tecnologías. Iniciativas como la de Finlandia, que ha hecho un esfuerzo porque su población tenga un cierto nivel de comprensión del fenómeno de la inteligencia artificial, es muy interesante, pero debe ir mucho más allá.

El equipo de DeepMind, liderado por Shane Legg, uno de los cofundadores de la compañía, clasifica los posibles efectos negativos de la AGI en cuatro categorías: mal uso, desalineamiento, errores y riesgos estructurales. La primera amenaza potencial es el «mal uso», algo que ya vemos con la IA tal y como existe hoy. Sin embargo, al hablar de AGI, por definición mucho más poderosa, el impacto podría ser mucho mayor, porque un actor malintencionado con acceso a AGI podría, por ejemplo, pedirle que encontrase y explotase vulnerabilidades zero day, o incluso diseñar un virus a medida que sirva como arma biológica. DeepMind subraya que las compañías que desarrollen AGI deberán realizar pruebas exhaustivas y establecer protocolos de seguridad muy sólidos tras el entrenamiento de los modelos, una especie de «IA con barreras de protección superlativas». También proponen la posibilidad de «desaprender» ciertas capacidades peligrosas, lo que en algunos entornos se denomina unlearning, aunque no está claro si esto sería viable sin limitar seriamente el potencial de los modelos.

El desalineamiento, tal y como lo plantean, no es un riesgo tan presente en la inteligencia artificial generativa que tenemos ahora, sino más bien un escenario de «máquina rebelde» que se sacude los límites impuestos por sus creadores. Sí, hablamos de la conocidísima «hipótesis Terminator», donde la inteligencia artificial actúa conscientemente en contra de la intención humana. DeepMind aclara que su estándar de «desalineamiento» es más avanzado que las simples tretas o engaños mencionados en estudios recientes, y para tratar de evitarlo, sugieren técnicas como la supervisión amplificada, en la que dos copias de la misma IA revisan mutuamente sus resultados para detectar comportamientos que se puedan desviar. Además, contemplan pruebas de estrés y monitorización intensiva que alerten de cualquier síntoma potencialmente peligroso de la inteligencia artificial. Mantener las AGIs en entornos aislados (o sandboxes) con estricta seguridad y supervisión humana directa también ayudaría a evitar que pudiera, hipotéticamente, descontrolarse. En otras palabras, asegurarse de que exista un botón de apagado.

La tercera categoría es la de los errores: si la inteligencia artificial no sabe que su salida es dañina y el operador humano tampoco lo pretendía, hablamos simplemente de un error. Y ya conocemos este tipo de patinazos en las inteligencias artificiales actuales como aquella de «añade pegamento a la pizza para que no se desprendan sus ingredientes«. Pero en la AGI, el «pegamento» podría ser muchísimo más peligroso. DeepMind señala que en un contexto militar, por ejemplo, la presión competitiva podría llevar a la implementación prematura de sistemas AGI, con el riesgo de cometer errores serios al realizar tareas mucho más complejas que las de las inteligencias artificiales de hoy. La solución para mitigar los errores no es muy clara: pasa por no dar demasiado poder a la AGI de golpe, desplegarla gradualmente y limitar su autoridad, suponiendo que eso sea posible en un contexto hostil o simplemente competitivo. También proponen que los comandos de la AGI se filtren a través de un sistema de «escudo» que verifique si son seguros antes de ejecutarlos.

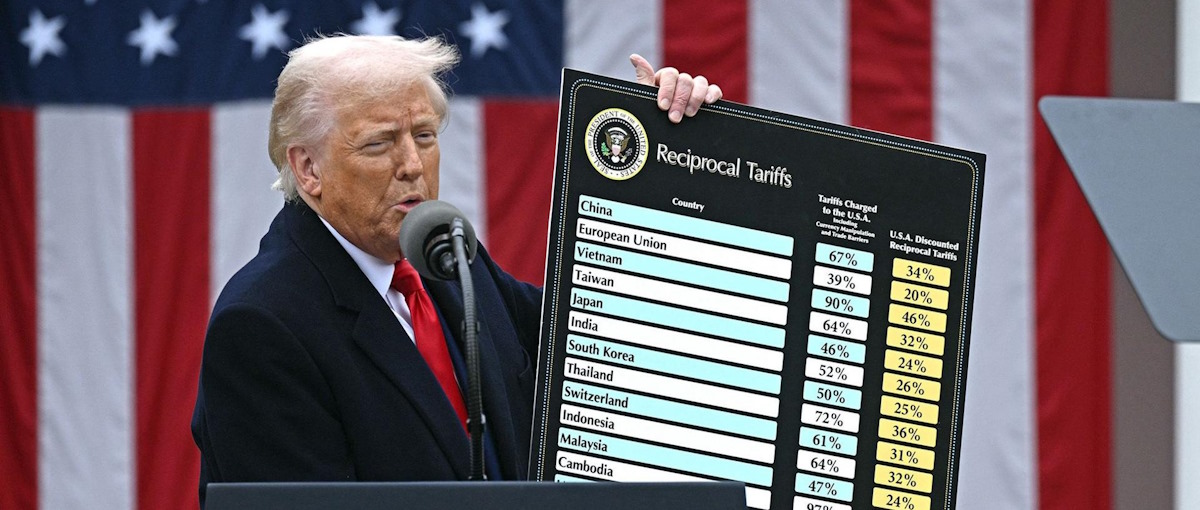

Por último, tenemos los riesgos estructurales, aquellos efectos no deseados (pero muy reales) que surgen cuando múltiples sistemas de AGI interactúan en nuestro ya de por sí complejo entramado social. Un ejemplo: la AGI podría generar información falsa tan verosímil que perderíamos la noción de qué o a quién creer. El estudio plantea también la posibilidad de que la AGI acumule progresivamente control sobre sistemas económicos y políticos, creando, por ejemplo, esquemas draconianos de aranceles. Para cuando quisiéramos darnos cuenta, las máquinas podrían estar llevando el timón en muchas actividades. Este tipo de riesgo es el más difícil de contener, porque depende en gran medida de cómo se comporten las personas, las infraestructuras y las instituciones a lo largo del tiempo.

La lección que podemos extraer del informe de DeepMind y de otros informes de referencia es clara: el avance de la AGI es completamente imparable, y su capacidad para generar riesgos es tan real como las oportunidades que ofrece. La respuesta no es un retroceso tecnológico, sino un salto hacia adelante en términos de educación y conciencia social. En un mundo donde la línea entre la ciencia ficción y la realidad se difumina cada vez más, lo que realmente necesitamos es una ciudadanía informada y crítica, capaz de enfrentar los desafíos de la era digital con valentía y sabiduría. En conjunto, estas cuatro categorías definen un mapa de riesgos que DeepMind considera imprescindible analizar para que la llegada de la AGI no nos pille despistados ni sin recursos para reaccionar. ¿La moraleja? Entender que hay que estar preparados para lo peor, pero trabajando para que ocurra lo mejor.

El informe de DeepMind me parece, francamente, un buen trabajo de categorización y de análisis de escenarios. Pero más que luchar contra ese monstruo en el armario, deberíamos aprender a convivir con él, entendiendo que el verdadero peligro reside en la ignorancia y el miedo irracional, y que la educación es la llave maestra para transformar esos riesgos en oportunidades para un futuro más seguro, más equitativo y en el que la AGI pueda de verdad servir para algo positivo, sin olvidar que siempre tendrá, como toda tecnología, potenciales usos negativos.

![Plataformas de streaming más usadas en España [2025]](https://www.trecebits.com/wp-content/uploads/2023/02/canales-streaming-150x150.webp?#)