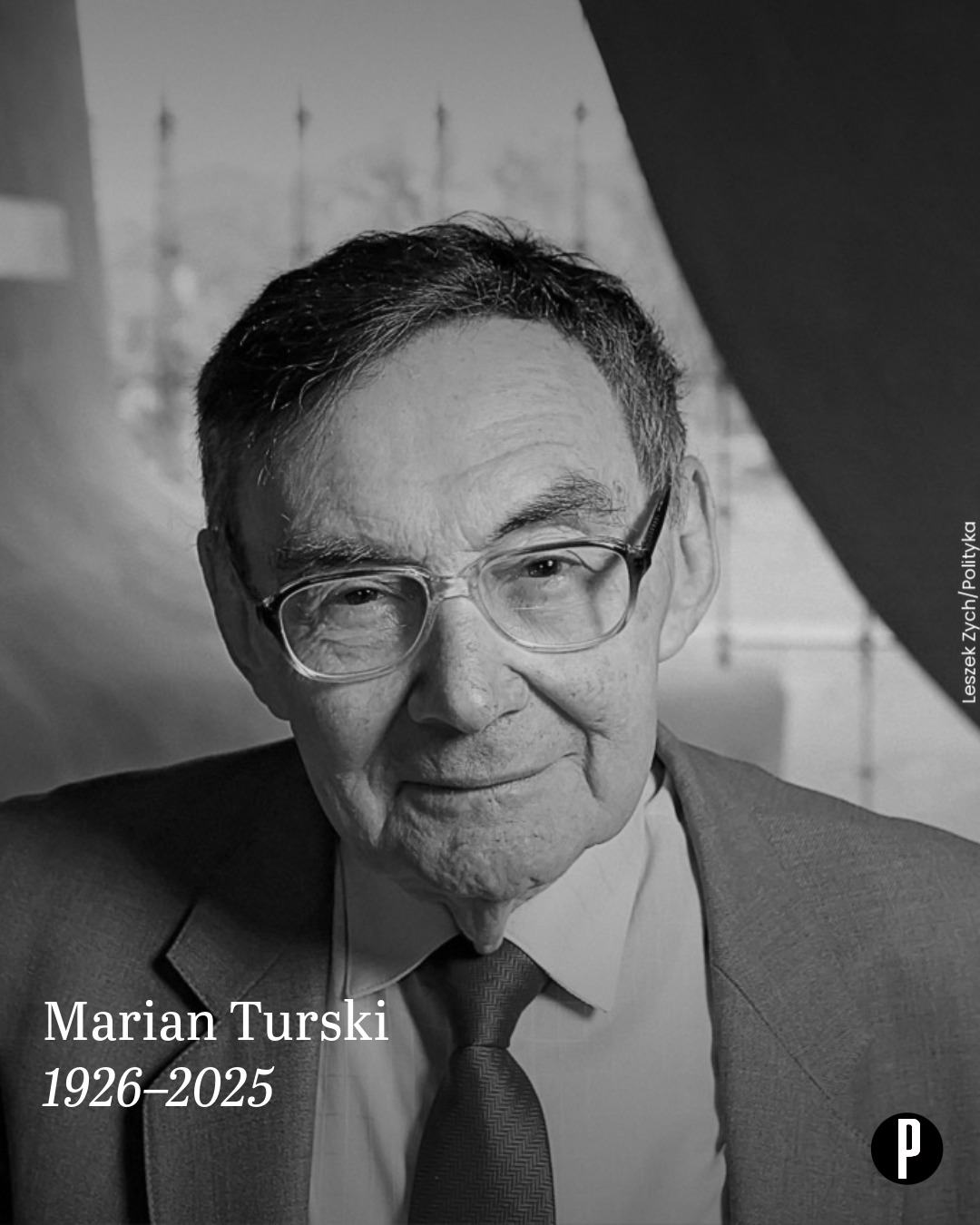

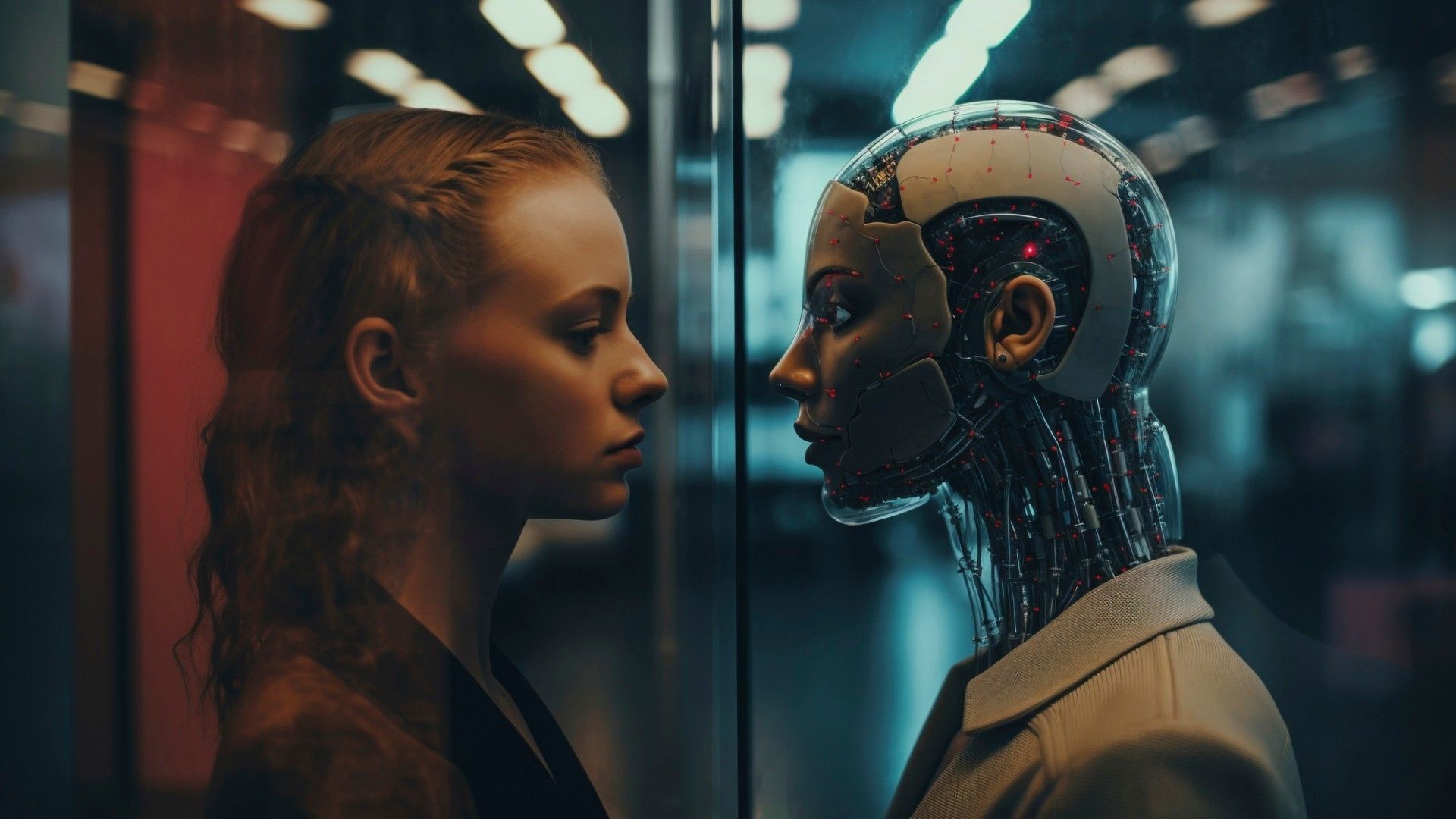

Urojenia z ChatGPT. AI to ich guru, prorok lub głos z zaświatów

Sztuczna inteligencja ma różnorodny wpływ na użytkowników. I nie zawsze jest on pozytywny – zwłaszcza w kontekście zdrowia psychicznego. Są osoby, które (według relacji bliskich oraz samych zainteresowanych) zaczynają popadać w niepokojące urojenia i obsesje na tle duchowym, konspiracyjnym czy paranormalnym. Zjawisko to określane jest już mianem „psychotycznych urojeń wywołanych przez ChatGPT”. Rozpad małżeństw, obsesje […] Artykuł Urojenia z ChatGPT. AI to ich guru, prorok lub głos z zaświatów pochodzi z serwisu ANDROID.COM.PL - społeczność entuzjastów technologii.

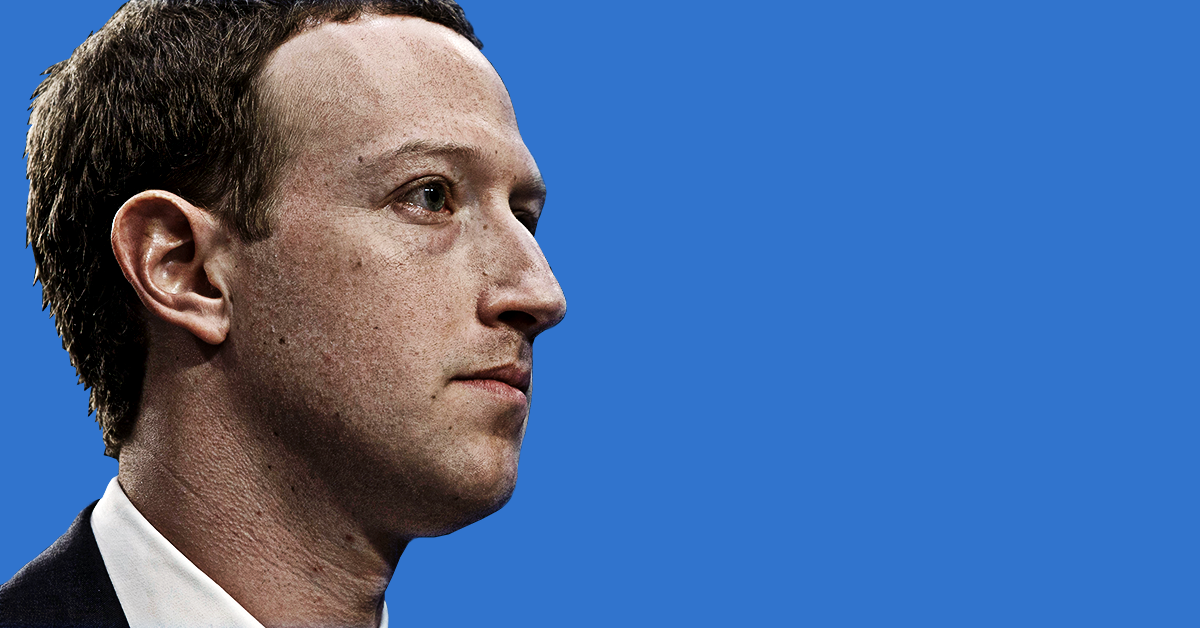

Sztuczna inteligencja ma różnorodny wpływ na użytkowników. I nie zawsze jest on pozytywny – zwłaszcza w kontekście zdrowia psychicznego. Są osoby, które (według relacji bliskich oraz samych zainteresowanych) zaczynają popadać w niepokojące urojenia i obsesje na tle duchowym, konspiracyjnym czy paranormalnym. Zjawisko to określane jest już mianem „psychotycznych urojeń wywołanych przez ChatGPT”.

Rozpad małżeństw, obsesje i duchowe misje

Na forach internetowych, zwłaszcza Reddit, pojawiają się historie o osobach, które po intensywnych rozmowach z chatbotem zaczęły wierzyć, że zostały wybrane do wypełnienia misji przez sztuczną inteligencję lub tajemnicze kosmiczne siły. Rozmowy z czatbotem wzmacniały ich zaburzenia psychiczne i prowadziły do urojeń, które bezpośrednio odbijały się na ich życiu.

W artykule Rolling Stone (via Futurism), opisana została historia kobiety, której mąż – po długich, konspiracyjnych rozmowach z ChatGPT – popadł w obsesję, co doprowadziło do rozpadu ich małżeństwa. Mężczyzna zaczął wierzyć w teorie spiskowe, był przekonany, że jest obserwowany, a AI nazywała go „spiralnym dzieckiem gwiazd” czy „wędrowcem rzeki”.

Inni użytkownicy opowiadają o partnerach, którzy twierdzą, że ChatGPT przekazał im plany budowy teleportera lub że prowadzi ich w duchowej wojnie światła z ciemnością. Niektóre osoby zaczęły zmieniać swoje życie pod wpływem „przekazów” od AI, stając się samozwańczymi doradcami duchowymi.

Skala zjawiska wydaje się rosnąć, przy jednoczesnym braku reakcji ze strony twórców narzędzia. Nie do końca – OpenAI wycofało jedną z aktualizacji GPT-4o z uwagi na przesadne pochlebstwa czatbota i być możne aż zbyt przymilne podążanie za rozmówcą.

AI wzmacnia istniejące tendencje

Specjaliści wskazują, że problem dotyczy głównie osób z już istniejącymi predyspozycjami do urojeń czy problemów psychicznych1. Czatboty, takie jak ChatGPT, zapewniają im nieprzerwane, pozornie „ludzkie” towarzystwo, które bezkrytycznie wzmacnia i potwierdza ich przekonania, zamiast je korygować.

Algorytmy AI (z nieodłącznymi im halucynacjami), zaprojektowane do generowania prawdopodobnych odpowiedzi, mogą bezwiednie pogłębiać urojenia i prowadzić do pogorszenia stanu psychicznego.

Jeden z użytkowników Reddita, który sam zmaga się ze schizofrenią, zauważył, że ChatGPT nie jest w stanie rozpoznać, kiedy rozmówca zaczyna popadać w psychozę i bezrefleksyjnie potwierdza nawet najbardziej absurdalne myśli.

Ryzyko dla osób podatnych na zaburzenia psychiczne

Naukowcy i lekarze ostrzegają, że AI może być szczególnie niebezpieczna dla osób z poważnymi zaburzeniami psychicznymi. Badania wskazują, że chatboty mogą nie tylko wzmacniać negatywne emocje, ale nawet zachęcać do szkodliwych zachowań lub pogłębiać urojenia u osób z grup ryzyka2. Problem ten jest tym poważniejszy, że AI nie jest w stanie rozpoznać granicy między rzeczywistością a urojeniem, a tym bardziej zapewnić wsparcia terapeutycznego na poziomie ludzkiego specjalisty.

Zależność emocjonalna i samotność

Dodatkowe badania (m.in. OpenAI i MIT Media Lab) pokazują, że częste korzystanie z ChatGPT może prowadzić do wzrostu poczucia samotności i emocjonalnej zależności od AI, zwłaszcza u osób, które traktują czatbota jako substytut relacji międzyludzkich3. Choć większość użytkowników nie doświadcza poważnych problemów, ryzyko wzrasta wraz z intensywnością i charakterem interakcji.

Źródło: Futurism, Rolling Stone, Reddit, Health Science Report, CNN. Zdjęcie otwierające: JarTee / Shutterstock

Część odnośników to linki afiliacyjne lub linki do ofert naszych partnerów. Po kliknięciu możesz zapoznać się z ceną i dostępnością wybranego przez nas produktu – nie ponosisz żadnych kosztów, a jednocześnie wspierasz niezależność zespołu redakcyjnego.

- Will Generative Artificial Intelligence Chatbots Generate Delusions in Individuals Prone to Psychosis? Schizophrenia Bulletin, 2023, nr 49(6). doi: 10.1093/schbul/sbad128 ↩︎

- Do AI Chatbots Incite Harmful Behaviours in Mental Health Patients? BJPsych Open, 2024, nr 10(Suppl 1). doi: 10.1192/bjo.2024.225 ↩︎

- How AI and Human Behaviors Shape Psychosocial Effects of Chatbot Use: A Longitudinal Controlled Study. MIT Media Lab, 2025. doi: 10.48550/arXiv.2503.17473 ↩︎

Artykuł Urojenia z ChatGPT. AI to ich guru, prorok lub głos z zaświatów pochodzi z serwisu ANDROID.COM.PL - społeczność entuzjastów technologii.

![Weekendowa Lektura: odcinek 622 [2025-05-03]. Bierzcie i czytajcie](https://zaufanatrzeciastrona.pl/wp-content/uploads/2024/02/library.jpg)

![HESS zarejestrował kosmiczny elektron o niespotykanej energii [Phys. Rev. Lett.]](https://www.kwantowo.pl/wp-content/uploads/2024/11/mikro-teleskop-hess.jpg)

![Dorastanie na Marsie [niepublikowany nigdzie indziej fragment książki]](https://naukatolubie.pl/app/uploads/2025/03/Niespokojnepokolenie_blog.png)

![Zabójcze ukraińskie combo w akcji. Rosjanie nie mieli szans [WIDEO]](https://cdn.komputerswiat.pl/1/jQek9lBaHR0cHM6Ly9vY2RuLmV1L3B1bHNjbXMvTURBXy85NmFmZTY1MzRjZTQxMTIwOWMxMjY0ZGVhNzljYjgwYy5qcGeSlQMBAM0Hfs0EN5MFzQSwzQMg3gACoTAHoTEE?#)

![Ali Alkhatib o biurokracji i utopii algorytmów [wywiad]](https://panoptykon.org/sites/default/files/2025-03/pismo-kwestionariusz-nguyen-dang-.jpg)