Runway Gen-4: Wie eine neue Generation KI-Modelle Bewegtbildproduktion verändert

Mit nur einem Referenzbild erstellt Runway Gen-4 realistische, stilistisch einheitliche Videoszenen – ganz ohne Kamera oder Film-Team. Was das für Marketing, Content Creation und visuelles Storytelling bedeutet.

5 Key Takeaways zu Runway Gen-4

- Konsistente Videoszenen: Figuren, Orte und Stile bleiben über mehrere Einstellungen hinweg stabil.

- Schnelle Produktion: Ein Referenzbild und ein Prompt reichen für realistische Videoclips.

- Mehr Kontrolle als Gen-3: Gen-4 bietet bessere Bewegungsqualität und Steuerbarkeit.

- Effizient skalierbar: Ideal für Social Media und Kampagnen mit hohem Content-Bedarf.

- Tool für Kreative: Gen-4 unterstützt visuelles Storytelling – ganz ohne Film-Team.

Runway Gen-4: von der Prompt-Idee zum fertigen Video

Ein kurzer Film, komplett mit KI erstellt – und das in nur wenigen Tagen. Szenenwechsel, stimmige Lichtverhältnisse, Figuren, die von Perspektive zu Perspektive wiedererkennbar bleiben: Mit Gen-4 stellt das Unternehmen Runway ein neues Modell zur Videoerstellung vor, das nicht nur für die Film- und Kreativbranche relevant ist, sondern auch für Marketing und visuelles Storytelling neue Möglichkeiten eröffnet.

Today we're introducing Gen-4, our new series of state-of-the-art AI models for media generation and world consistency. Gen-4 is a significant step forward for fidelity, dynamic motion and controllability in generative media.

Gen-4 Image-to-Video is rolling out today to all paid… pic.twitter.com/VKnY5pWC8X— Runway (@runwayml) March 31, 2025

Denn was bisher nur mit Kamera-Teams, Postproduktion und hohem Aufwand umsetzbar war, kann nun mit einem einzigen Referenzbild, einem klar formulierten Prompt und der richtigen KI-Plattform geschehen. Runway Gen-4 erzeugt realistisch wirkende Videos, in denen Charaktere, Orte und Objekte über mehrere Szenen hinweg konsistent bleiben – ganz ohne manuelles Nachjustieren.

Schon mit der vorherigen Version, Gen-3 Alpha, hatte Runway gezeigt, dass KI-generiertes Video keine Spielerei mehr ist. Doch Gen-4 geht noch einen Schritt weiter – insbesondere in Sachen Detailtreue, Steuerbarkeit und Storytelling-Fähigkeit. Einen Überblick zu den ersten Meilensteinen der Entwicklung findest du im Artikel.

KI-Videos wie im Kino:

Runway Gen-3 Alpha geht an den Start

Konsistenz statt Zufalls-Output: Wofür Gen-4 entwickelt wurde

Viele kennen KI-generierte Bilder oder Videos aus Social Media – beeindruckend, aber oft wenig verlässlich in der Umsetzung. Runway verfolgt mit Gen-4 einen anderen Ansatz. Die neue Modellgeneration soll visuelle Medien nicht nur generieren, sondern aktiv strukturieren:

- Figuren behalten ihre optische Identität – selbst wenn sie aus verschiedenen Winkeln oder in neuem Licht gezeigt werden.

- Orte und Szenen bleiben in sich stimmig.

- Stil und Bildsprache können von Nutzer:innen festgelegt und über mehrere Einstellungen hinweg beibehalten werden.

Ein Einblick in das kreative Potenzial von Runway Gen-4 liefert ein aktueller Threads Post von luokai.

Auf Threads ansehen

Darin werden Kurzfilme und Musikvideos vorgestellt, die vollständig mit der neuen KI-Generation erstellt wurden – darunter „The Lonely Little Flame“. Die gezeigten Beispiele verdeutlichen, wie stark Runway Gen-4 auf konsistentes Storytelling ausgelegt ist und welche erzählerischen Möglichkeiten sich durch KI-generierte Szenen eröffnen. Weitere Beispiele von Runway, die luokai zeigt, sind „The Retrieval“ und „NYC is a zoo“.

Auf Threads ansehen

Bereits mit dem Tool Runway Frames hatte das Unternehmen einen Zwischenschritt zur „visuellen Kohärenz“ gemacht – mit dem Fokus auf präzise Einzelbildgestaltung in definierten Bildwelten. Gen-4 baut nun darauf auf und erweitert diesen Ansatz erstmals auf ganze Videoszenen. Welche kreativen Möglichkeiten Frames für Designer:innen und Markenkommunikation eröffnet, zeigt unser Überblick.

Weltenbildung mit KI-Bildern:

Runway Frames ist da

Einfacher Workflow, professionelle Ergebnisse

Das Besondere an Gen-4 ist die Kombination aus technischer Leistungsfähigkeit und einfacher Bedienung. Nutzer:innen laden ein oder mehrere Bilder hoch, beschreiben das gewünschte Ergebnis – und die KI erstellt darauf basierend neue Szenen oder Perspektiven.

Laut Runway ist dabei kein zusätzliches Training nötig. Auch komplexere Bewegungsabläufe oder physikalisch plausible Interaktionen zwischen Objekten und Figuren lassen sich simulieren. Die Resultate wirken dynamisch, realistisch und können problemlos mit anderen Medieninhalten kombiniert werden – etwa für Kampagnen, Produktinszenierungen oder kurze Werbeformate.

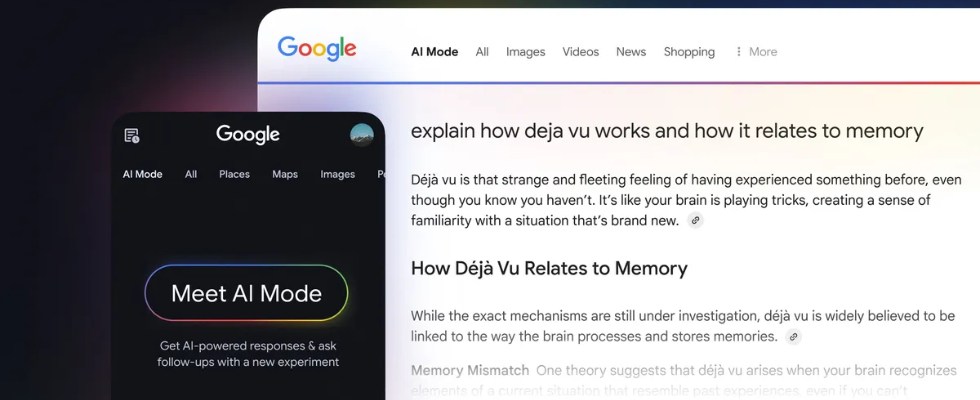

Die Funktion Image-to-Video steht seit dem 31. März allen zahlenden Nutzer:innen zur Verfügung. Damit reiht sich Runway in eine wachsende Liste von KI-Anbieter:innen ein, die visuelle Inhalte immer zugänglicher machen. Welche kreativen Potenziale auch andere Tools derzeit freisetzen, zeigt unser Überblick zur kostenlosen Bildgenerierung mit GPT-4o.

ChatGPT:

GPT-4o Image Generation jetzt auch kostenlos nutzbar

Runway Gen-4 macht visuelles Storytelling skalierbar – für alle, die kreativ arbeiten

Mit Gen-4 unterstreicht Runway, dass KI längst mehr ist als ein experimentelles Spielzeug für Tech-Enthusiast:innen. Die Plattform positioniert sich als ernstzunehmendes Werkzeug für alle, die mit Bildern und Geschichten arbeiten – ob in Marketing, Medienproduktion oder im kreativen Umfeld

Indem sie Konsistenz, Qualität und Kontrolle in den Mittelpunkt stellt, ermöglicht die KI neue Formate, effizientere Abläufe und ein hohes Maß an gestalterischer Freiheit. Wer bisher dachte, Bewegtbild sei nur mit großem Budget machbar, bekommt eine Einladung zum Umdenken – und zum Ausprobieren.

,regionOfInterest=(1617,817)&hash=231f0c6bafc492519cfc9f7298de3290ff777be6060fb5d56ee66d5597964623#)

![SEO-Monatsrückblick März 2025: Google AIO in DE, AI Mode, LLMs + mehr [Search Camp 369]](https://blog.bloofusion.de/wp-content/uploads/2025/03/Search-Camp-Canva-369.png)

![Warum die Google Search Console eines der wichtigsten Relaunch-Werkzeuge ist [Search Camp 368]](https://blog.bloofusion.de/wp-content/uploads/2025/02/Search-Camp-Canva-368.png)

![Perplexity, ChatGPT Search & Co.: Kann Google jetzt einpacken? [Search Camp 367]](https://blog.bloofusion.de/wp-content/uploads/2025/02/Search-Camp-Canva-367.png)

![Deals: Streaming - Diese beiden Plattformen bekommt ihr gerade für nur 5€ [Anzeige]](https://images.cgames.de/images/gamestar/4/o2-tv_6346512.jpg?#)

:quality(80)/p7i.vogel.de/wcms/8e/62/8e622dfaa28df750fcf665638019b9ca/0123375724v1.jpeg?#)

:quality(80)/p7i.vogel.de/wcms/b0/53/b05361163f6ec630e0da0caf715bb0ce/0123909085v1.jpeg?#)

:quality(80)/p7i.vogel.de/wcms/30/12/3012a805492e7a1f9d0f75fb24f6279b/0123009657v1.jpeg?#)

:quality(80)/p7i.vogel.de/wcms/18/36/1836cffbeb6c6af48b2d544f90b36fa6/0123806279v2.jpeg?#)