KI der Elefant im Datenladen: Wie der Datenrausch den Datenschutz erdrückt

1. Einleitung Die Entwicklung der Künstlichen Intelligenz (KI) schreitet unaufhaltsam voran und dringt in immer mehr Bereiche des gesellschaftlichen Lebens vor. Unternehmen, Behörden und Technologieanbieter setzen KI-Systeme ein, um Entscheidungen zu automatisieren, Prozesse zu optimieren und Daten in bisher ungekanntem Ausmaß auszuwerten. Doch während die Euphorie über die vermeintlichen Möglichkeiten groß ist, bleibt eine zentrale […]

1. Einleitung

Die Entwicklung der Künstlichen Intelligenz (KI) schreitet unaufhaltsam voran und dringt in immer mehr Bereiche des gesellschaftlichen Lebens vor. Unternehmen, Behörden und Technologieanbieter setzen KI-Systeme ein, um Entscheidungen zu automatisieren, Prozesse zu optimieren und Daten in bisher ungekanntem Ausmaß auszuwerten. Doch während die Euphorie über die vermeintlichen Möglichkeiten groß ist, bleibt eine zentrale Frage oft unbeantwortet: Wer kontrolliert die KI – und was passiert mit den Daten, die sie sammelt?

KI-Systeme basieren auf gigantischen Datenmengen, die von Nutzern, Unternehmen und öffentlichen Institutionen gesammelt werden – oft ohne deren ausdrückliche Zustimmung. Eine Studie der Initiative Urheberrecht kommt zu dem Schluss, dass das Training generativer KI-Modelle nicht unter die bestehende Erlaubnis für Text- und Data-Mining fällt. Vielmehr handelt es sich dabei um eine urheberrechtlich relevante Vervielfältigung geschützter Werke. Dies wirft nicht nur Fragen zur legalen Nutzung dieser Daten auf, sondern auch zu den weitreichenden Folgen für Kreative und Rechteinhaber.

Diese (illegal) gesammelten Daten sind das eigentliche Kapital der Technologie, doch ihr unkontrollierter Einsatz birgt erhebliche Risiken für die Privatsphäre und den Datenschutz. Systeme zur Gesichtserkennung, personalisierte Überwachungsalgorithmen und automatisierte Entscheidungsprozesse greifen tief in die individuellen Freiheiten ein – oft ohne dass die Betroffenen es überhaupt bemerken. Statt eines neutralen Werkzeugs könnte KI zu einer nie dagewesenen Überwachungsmaschine werden, die persönliche Daten zur Ware macht und demokratische Strukturen untergräbt.

Im Folgenden werfen wir einen Blick auf konkrete Anwendungsbereiche, in denen KI bereits eingesetzt oder geplant wird – und welche Risiken dies für Datenschutz und persönliche Freiheit mit sich bringt.

2. KI im Einsatz: Praktische Beispiele

2.1 KI macht eine sichere WhatsApp-Nutzung unmöglich

Eine der häufigsten Fragen in Diskussionen über WhatsApp lautet:

Warum sollte ich wechseln? Meine Chats sind doch Ende-zu-Ende-verschlüsselt.

Diese Argumentation war noch nie überzeugend, da bereits die anfallenden Metadaten ein erhebliches Überwachungsrisiko darstellen. Doch mit der Einführung von KI-gestützten Funktionen ist sie nun endgültig hinfällig.

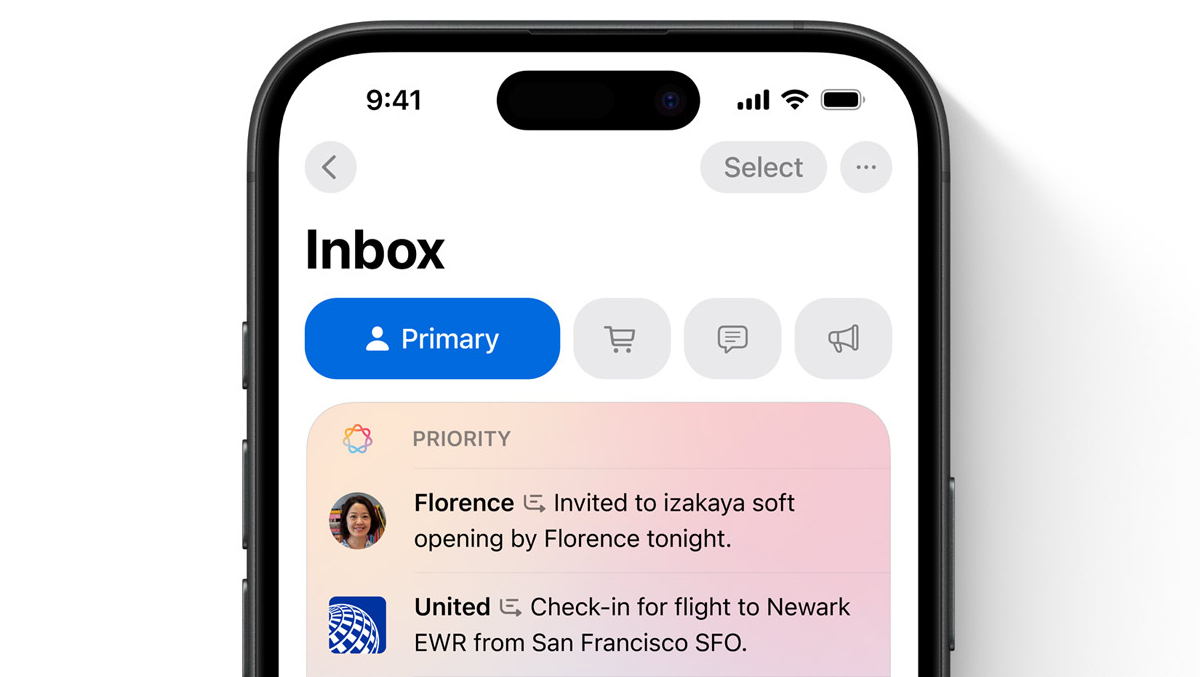

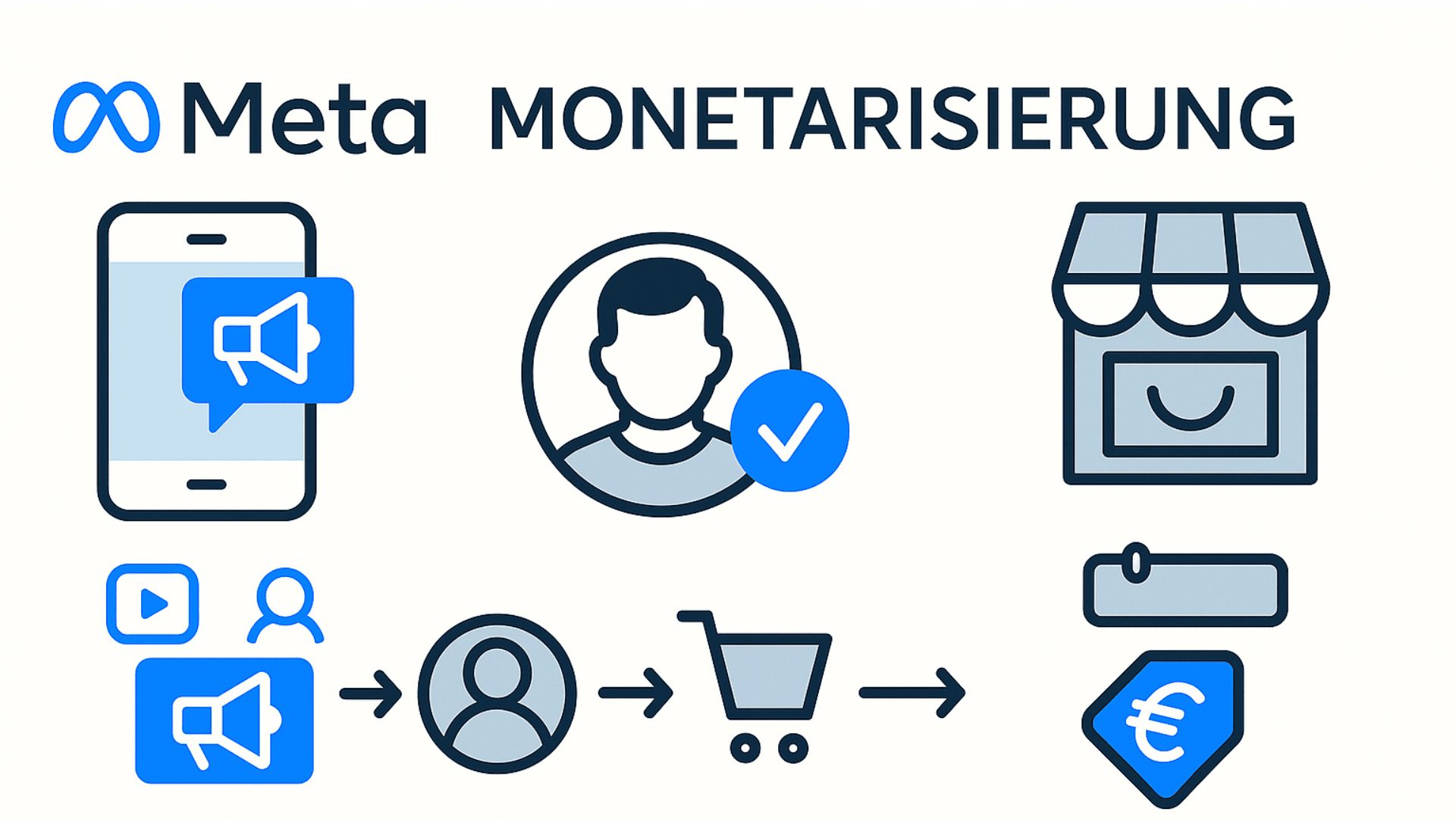

Meta hat begonnen, KI-Assistenten in WhatsApp, Instagram und den Facebook Messenger zu integrieren – ohne den Nutzern eine Möglichkeit zur Deaktivierung zu geben. Besonders problematisch ist dabei, dass jede Interaktion mit der KI nicht nur die eigenen Nachrichten offenlegt, sondern Meta auch erlaubt, diese Daten zu speichern und für das Training der KI zu nutzen. Die Beta-Version treibt dies noch weiter: Sobald der Assistent geöffnet wird, beginnt er automatisch mitzuhören, verarbeitet die Sprachdaten in der Cloud und überträgt sie auf die Meta-Server. Damit unterliegt die Datenverarbeitung nicht mehr der Kontrolle der Nutzer, sondern den Zugriffsmöglichkeiten von Meta – und letztlich auch der US-Regierung.

Das zentrale Problem dabei: Die oft angeführte Ende-zu-Ende-Verschlüsselung, mit der WhatsApp vermeintlichen Datenschutz suggeriert, greift in diesen Fällen nicht mehr. Meta erhält direkten Zugriff auf die Inhalte. Selbst wer die KI-Funktionen nicht aktiv nutzt, kann nicht sicher sein, dass seine Kommunikation – insbesondere in Gruppenchats – nicht dennoch von der KI erfasst und analysiert wird.

Dieses Beispiel verdeutlicht, wie die Einführung von KI-Technologien nicht nur die Funktionalitäten eines Dienstes erweitert, sondern auch die Kontrolle über private Daten in die Hände von Unternehmen legt, die zunehmend intransparente Überwachungssysteme etablieren. Unter diesen Bedingungen ist eine wirklich sichere Nutzung von WhatsApp nicht mehr möglich.

2.2 eBay: KI-Training mit personenbezogenen Daten

Die kürzlich aktualisierte Datenschutzerklärung von eBay gibt dem Unternehmen weitreichende Rechte, um personenbezogene Nutzerdaten für das Training von KI-Modellen zu verwenden. Ziel dieser Maßnahme ist es, den Service zu verbessern und neue, KI-gestützte Funktionen wie die automatische Angebotserstellung und die Generierung von Produktrezensionen zu implementieren. Doch hinter dieser scheinbar harmlosen Verbesserung verbirgt sich eine bedenkliche Entwicklung, die weit über die bloße Nutzung von Daten zur Optimierung von Dienstleistungen hinausgeht.

Die neue Datenschutzerklärung räumt eBay das Recht ein, eine Vielzahl von persönlichen Informationen zu sammeln und zu verwenden – von Namen, Adressen und Telefonnummern bis hin zu Steueridentifikationsnummern, Bankdaten und sogar Informationen zu Geburtsdatum, Familienstand und Interessen. Für Verkäufer kommen zusätzlich hochsensible Daten wie Steuerdaten und Bankinformationen ins Spiel. Diese persönlichen Daten sollen nun nicht nur für den Service von eBay genutzt werden, sondern auch dazu, KI-Modelle zu trainieren, die mit den gesammelten Informationen weiter verbessert werden.

Besonders problematisch wird es, wenn eBay in seiner Datenschutzerklärung angibt, dass auch Drittanbieter-KI-Systeme auf diese Daten zugreifen dürfen. Das bedeutet, dass Nutzerdaten nicht nur an eBay, sondern auch an externe Unternehmen weitergegeben werden können – ohne dass die betroffenen Nutzer eine wirkliche Kontrolle darüber haben. Die Verantwortung für den Schutz dieser Daten wird somit auf mehrere Akteure verteilt, was das Risiko von Missbrauch und Datenlecks massiv erhöht.

Laut eBay erfolgt die Verarbeitung dieser Daten auf Grundlage »berechtigter Interessen«. Doch ob diese Argumentation mit der Datenschutz-Grundverordnung (DSGVO) vereinbar ist, erscheint höchst fraglich. Schließlich handelt es sich um eine umfassende Nutzung personenbezogener Daten für einen völlig neuen Zweck – ohne vorherige ausdrückliche Zustimmung der Betroffenen. Diese Praxis wirft erhebliche Fragen hinsichtlich der Einhaltung datenschutzrechtlicher Bestimmungen auf und könnte zu einem Präzedenzfall für die unzureichende Transparenz bei der Nutzung von Nutzerdaten werden.

Trotz der Behauptungen von eBay, ethische Standards wie Transparenz und Fairness zu wahren, bleibt unklar, wie genau diese Prinzipien in der Praxis umgesetzt werden sollen. Die Realität ist, dass eBay eine enorme Menge an persönlichen Daten sammelt, die potenziell nicht nur für das KI-Training verwendet werden, sondern auch für kommerzielle Zwecke weiterverwertet oder sogar verkauft werden könnten. Nutzer können nur schwer abschätzen, wie ihre Daten genau verwendet und weitergegeben werden.

Durch die umfassende Sammlung und Nutzung von Daten zur Verbesserung von KI-Algorithmen werden die Grenzen zwischen einer personalisierten Serviceverbesserung und einer massiven Überwachung der Nutzer zunehmend verwischt. Was zunächst als ein innovativer Service erscheint, könnte sich schnell zu einem weitreichenden Eingriff in die Privatsphäre der Nutzer entwickeln. Wer eBay weiterhin nutzt, sollte sich bewusst machen, dass er nicht nur Produkte auf einem Online-Marktplatz kauft, sondern auch seine persönlichen Daten umfassend gesammelt und genutzt werden – oft für Zwecke, die intransparent sind und in vielen Fällen die Privatsphäre gefährden.

Wer seine Privatsphäre wahren möchte, muss schnell handeln: Bis spätestens 21. April haben eBay-Nutzer die Möglichkeit, der Verwendung ihrer Daten für das KI-Training zu widersprechen:

- Opt-out bis 21. April: In den Kontoeinstellungen muss aktiv widersprochen werden.

- Daten löschen: Wer kein Risiko eingehen will, kann sein Konto samt gespeicherter Daten entfernen.

Doch auch bei einer Löschung bleibt die Frage, wie sicher die bereits gesammelten Daten vor Missbrauch oder unerwünschter Nutzung sind. Einmal verwendete Daten lassen sich nicht zurückholen. Dieser Fall zeigt einmal mehr, dass Unternehmen zunehmend versuchen, Daten für KI-Modelle zu nutzen – oft ohne transparente Kommunikation oder eine echte Wahlmöglichkeit.

2.3 Doctolib: KI-Training mit Patientendaten

Doctolib hat seine Datenschutzhinweise aktualisiert und plant, verschiedene Datenarten für das Training von KI-Modellen zu nutzen – allerdings unter unterschiedlichen rechtlichen Vorwänden. Allgemeine Nutzerdaten wie Suchverhalten, Terminhistorien und medizinische Notizen sollen auf Grundlage eines »berechtigten Interesses« verarbeitet werden. Diese Rechtfertigung ermöglicht es, Daten ohne ausdrückliche Zustimmung der Nutzer zu verwenden – ein Ansatz, der insbesondere im sensiblen Gesundheitsbereich höchst fragwürdig ist.

Noch bedenklicher wird es bei den wirklich sensiblen Daten: Gesundheitsinformationen wie Dokumente, medizinische Notizen oder von Praxen übermittelte Daten sollen erst nach einer ausdrücklichen Einwilligung der Nutzer in den KI-Trainingsprozess einfließen. Diese Unterscheidung mag auf dem Papier sinnvoll erscheinen, doch in der Praxis stellt sich die Frage, ob Nutzer überhaupt ausreichend über die Tragweite ihrer Einwilligung informiert werden. Die Gefahr besteht, dass selbst »anonymisierte« Gesundheitsdaten durch moderne Analysemethoden rekonstruierbare Profile ergeben – ein Risiko, das in einem Bereich, in dem Datenschutz oberste Priorität haben müsste, nicht akzeptabel ist.

Zudem kommt es in der Praxis immer wieder zu Problemen: Doctolib war in der Vergangenheit bereits mehrfach in die Kritik geraten, weil sensible Gesundheitsdaten unzureichend geschützt und teilweise für Marketingzwecke missbraucht wurden. Der neue Vorstoß, diese Daten – wenn auch nur mit Einwilligung – für KI-Modelle zu nutzen, erscheint daher als weiterer Schritt in eine Richtung, in der der Schutz der Patientendaten zunehmend in den Hintergrund rückt.

Während Doctolib betont, dass die Datenverarbeitung auf europäischen Servern erfolgt und die Einwilligung freiwillig erteilt werden kann, bleibt die Frage bestehen, ob dieser Ansatz tatsächlich den hohen Schutzansprüchen gerecht wird. Insbesondere in einer Zeit, in der digitale Gesundheitsdienste immer mehr zur Norm werden, müssen die Risiken und Konsequenzen einer solch massiven Datennutzung kritisch hinterfragt werden. Patienten sollten sich bewusst sein, dass einmal freigegebene Daten in einem undurchsichtigen System für Zwecke genutzt werden können, die sie später kaum noch kontrollieren können.

Was Patienten zu Doctolib und ihren Rechten wissen müssen

Erfahrt in diesem Beitrag, wie Doctolib mit sensiblen Gesundheitsdaten umgeht und welche Rechte ihr als Patienten habt, um eure Daten zu schützen bzw. zu löschen.3. Worin besteht nun die Gefahr?

Die zunehmende Verknüpfung von Künstlicher Intelligenz und massenhafter Datensammlung birgt erhebliche Risiken für Datenschutz, Privatsphäre und die Kontrolle über persönliche Informationen. Während Unternehmen und Anbieter KI als Fortschritt verkaufen, sind die Auswirkungen für die Nutzer oft intransparent und potenziell gravierend. Die Gefahren lassen sich in unterschiedliche Problembereiche unterteilen.

3.1 Verlust der Kontrolle über persönliche Daten

KI-gestützte Systeme benötigen riesige Datenmengen, um zu lernen und sich zu verbessern. Dabei werden Daten oft nicht nur für die eigentliche Funktionalität eines Dienstes verarbeitet, sondern auch für das Training neuer Modelle genutzt. Nutzer geben ihre Informationen also nicht nur für eine konkrete Anwendung preis, sondern liefern unfreiwillig die Grundlage für zukünftige, oft unvorhersehbare Zwecke. Besonders problematisch ist, dass in vielen Fällen nicht klar ist, wie lange die Daten gespeichert bleiben und wer letztlich Zugriff darauf hat.

Beispiel: WhatsApp und Meta-KI

Meta integriert KI-Assistenten in WhatsApp, Instagram und den Facebook Messenger – und zwar ohne Möglichkeit zur Deaktivierung. Sobald die KI genutzt wird, beginnt sie, Daten zu sammeln und zu analysieren. Die Ende-zu-Ende-Verschlüsselung von WhatsApp wird dadurch untergraben, da Inhalte durch die KI verarbeitet und gespeichert werden können. Nutzer verlieren somit die Kontrolle darüber, wer auf ihre Gespräche zugreifen kann und welche Daten langfristig in die Trainingsmodelle von Meta einfließen.

Zudem zeigen jüngste Enthüllungen, dass Meta offenbar nicht nur legale Datenquellen nutzt, sondern auch urheberrechtlich geschützte Werke ohne Erlaubnis in seine KI-Modelle einspeist. In einem laufenden Rechtsstreit wurde bekannt, dass Meta-Chef Mark Zuckerberg persönlich die Nutzung von Raubkopien für das KI-Training genehmigt haben soll. Interne Dokumente belegen, dass Metas Entwickler illegale Bibliotheken wie LibGen nutzten, um ihre KI-Modelle mit geschütztem Material zu füttern. Dies verdeutlicht nicht nur die weitreichende Missachtung von Datenschutz und Urheberrecht durch große Technologieunternehmen, sondern zeigt auch, dass es völlig naiv wäre, diesem Unternehmen zu vertrauen – egal, was Meta behauptet oder in den Datenschutzinformationen verspricht.

3.2 Zweckentfremdung und Kommerzialisierung von Daten

Unternehmen präsentieren KI als »intelligente Assistenz«, in Wahrheit sind die Nutzer aber vor allem Datenlieferanten. Durch vage formulierte Datenschutzhinweise und sogenannte »berechtigte Interessen« wird der Zugriff auf persönliche Daten oft ohne direkte Zustimmung der Betroffenen legitimiert. Dies führt dazu, dass Informationen nicht nur für personalisierte Funktionen genutzt, sondern auch weiterverkauft oder mit Drittanbietern geteilt werden.

Beispiel: eBay und KI-Training

Die neuen Datenschutzrichtlinien von eBay zeigen exemplarisch, wie weitreichend Unternehmen sich Zugriff auf Nutzerdaten sichern. Neben Namen, Adressen und Bankdaten werden auch sensible Informationen wie Steueridentifikationsnummern und persönliche Interessen gesammelt – und für das Training von KI-Modellen verwendet. Noch kritischer: Auch Drittanbieter dürfen auf diese Daten zugreifen. Nutzer verlieren somit jegliche Kontrolle darüber, wo ihre Daten letztlich landen und wofür sie genutzt werden.

3.3 Anonymisierung als Scheinlösung

Viele Unternehmen behaupten, Daten würden nur in anonymisierter Form für das Training von KI genutzt. In der Realität zeigt sich jedoch, dass moderne Reidentifikationsverfahren es ermöglichen, selbst anonymisierte Daten wieder einzelnen Personen zuzuordnen. Dies ist besonders problematisch, wenn es um hochsensible Informationen wie Gesundheitsdaten geht.

Beispiel: Doctolib und Patientendaten

Doctolib verarbeitet allgemeine Nutzerdaten wie Suchverhalten und Terminhistorien ohne ausdrückliche Zustimmung – und rechtfertigt dies mit »berechtigtem Interesse«. Noch sensiblere Gesundheitsinformationen dürfen nur mit Einwilligung verwendet werden. Doch selbst wenn Patienten zustimmen, bleibt unklar, wie sicher diese Daten tatsächlich sind. Anonymisierte Gesundheitsdaten können mit weiteren Informationen aus anderen Quellen verknüpft und dadurch wieder einzelnen Personen zugeordnet werden.

4. Fazit: Schleichender Kontrollverlust & Abhängigkeit

Die zunehmende Abhängigkeit von KI-gestützten Systemen führt dazu, dass Nutzer oft keine echte Wahl mehr haben. Wer WhatsApp oder eBay weiterhin nutzt, gibt seine Daten unfreiwillig preis, da die Alternativen entweder weniger verbreitet oder ebenfalls nicht ohne Datensammlung auskommen. Dadurch entsteht ein digitaler Überwachungszwang: Wer moderne Technologie nutzen möchte, muss akzeptieren, dass seine Privatsphäre zunehmend untergraben wird. Für Nutzer bedeutet das vor allem eines: den schleichenden Verlust über die eigene digitale Identität. Unternehmen sichern sich umfassende Rechte an persönlichen Informationen, während Datenschutzbestimmungen oft nur als formale Hürde behandelt werden. Die Beispiele von Meta, eBay und Doctolib zeigen, dass diese Entwicklung bereits in vollem Gange ist. Doch es gibt noch viele weitere Beispiele.

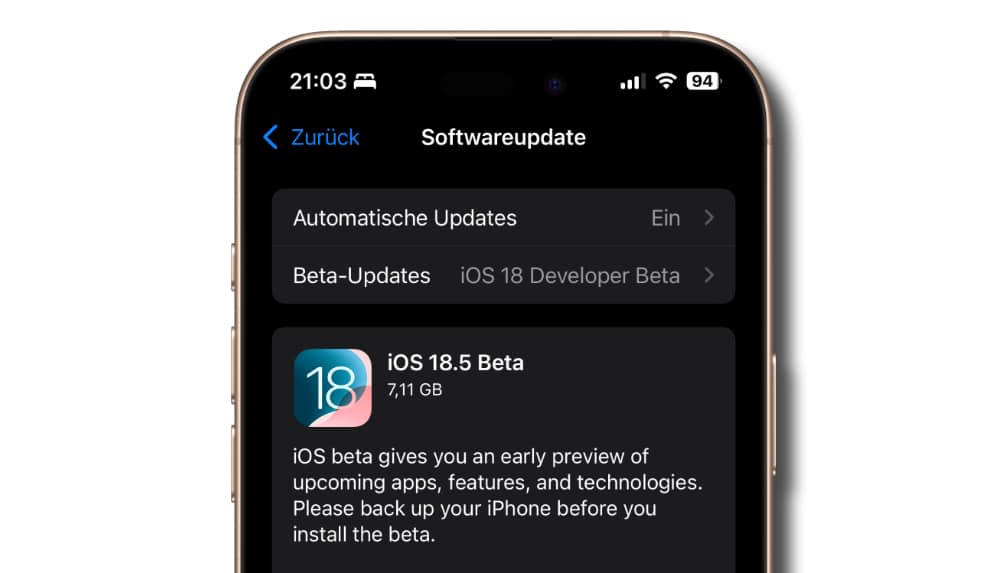

Die Auswirkungen von KI sind noch ungewiss. Ich habe für mich jedenfalls entschieden, dass ich dort, wo ich mitbekomme, dass KI eingesetzt wird und ich bei den betroffenen Instituten oder Firmen von Missbrauch ausgehen muss, nicht mehr bereit bin, diese zu nutzen bzw. mein Konto zu löschen. Wer sich schützen möchte, muss aktiv widersprechen, Daten löschen oder, wenn möglich, alternative Dienste nutzen. Ohne strengere gesetzliche Vorgaben und ein stärkeres Bewusstsein für die Risiken wird KI zunehmend zu einem Werkzeug, das nicht nur Innovationen ermöglicht, sondern auch die Kontrolle über persönliche Daten in die Hände weniger großer Konzerne legt. Die Gefahr liegt nicht nur in der Datennutzung selbst, sondern in der Tatsache, dass Nutzer oft nicht einmal wissen, was mit ihren Informationen geschieht – bis es zu spät ist.

In zehn Jahren wird man vielleicht sagen:

Hätte uns damals jemand gewarnt!

Doch die Warnungen sind bereits da, nur werden sie überhört, weil alle diesem »digitalen Rausch« verfallen sind. Es ist ein bisschen wie bei den Umweltschäden: Man wusste schon lange, dass die ungebremste Zerstörung der Natur Folgen haben würde, aber die Warnungen wurden ignoriert, solange der kurzfristige Profit lockte. Heute zahlen wir den Preis für diese Ignoranz. Genauso wird es mit den Daten und der Privatsphäre sein. Die Folgen des sorglosen Umgangs mit persönlichen Informationen sind absehbar, aber solange es niemanden wirklich zu stören scheint, wird weitergemacht – bis der Schaden längst angerichtet ist und nicht mehr reversibel ist.

,regionOfInterest=(825,555)&hash=b87fe88d276342c94254a849615e7167164a9388b5d5b1e01b7b58d74377c0d9#)

![SEO-Monatsrückblick März 2025: Google AIO in DE, AI Mode, LLMs + mehr [Search Camp 369]](https://blog.bloofusion.de/wp-content/uploads/2025/03/Search-Camp-Canva-369.png)

![Warum die Google Search Console eines der wichtigsten Relaunch-Werkzeuge ist [Search Camp 368]](https://blog.bloofusion.de/wp-content/uploads/2025/02/Search-Camp-Canva-368.png)

![Perplexity, ChatGPT Search & Co.: Kann Google jetzt einpacken? [Search Camp 367]](https://blog.bloofusion.de/wp-content/uploads/2025/02/Search-Camp-Canva-367.png)

![Deals: Sammlerstück - limitierte Keycap jetzt auf Amazon sichern [Anzeige]](https://images.cgames.de/images/gamestar/4/destiny-2-keycap-teaser-_6346254.jpg?#)

:quality(80)/p7i.vogel.de/wcms/b0/53/b05361163f6ec630e0da0caf715bb0ce/0123909085v1.jpeg?#)

:quality(80)/p7i.vogel.de/wcms/30/12/3012a805492e7a1f9d0f75fb24f6279b/0123009657v1.jpeg?#)

:quality(80)/p7i.vogel.de/wcms/18/36/1836cffbeb6c6af48b2d544f90b36fa6/0123806279v2.jpeg?#)

:quality(80)/p7i.vogel.de/wcms/63/1f/631fc9b40f41fef85d8c1360a2a52495/0123873525v2.jpeg?#)