Runway wprowadza Gen-4: coraz trudniej poznać, że wideo jest wygenerowane przez AI

Runway pochwaliło się swoim najnowszym generatywnym modelem AI do tworzenia wideo: Runway Gen-4. Przełom polega na tym, że nowość generuje spójne wizualnie sceny bez zniekształceń postaci czy scenerii. Runway, firma specjalizująca się w sztucznej inteligencji do generowania wideo, ogłosiła premierę swojego najnowszego modelu – Gen-4. Nowa technologia, będąca następcą modelu Gen-3 Alpha, wprowadza przełomowe ulepszenia... Jeśli artykuł Runway wprowadza Gen-4: coraz trudniej poznać, że wideo jest wygenerowane przez AI nie wygląda prawidłowo w Twoim czytniku RSS, to zobacz go na iMagazine.

Runway pochwaliło się swoim najnowszym generatywnym modelem AI do tworzenia wideo: Runway Gen-4. Przełom polega na tym, że nowość generuje spójne wizualnie sceny bez zniekształceń postaci czy scenerii.

Runway, firma specjalizująca się w sztucznej inteligencji do generowania wideo, ogłosiła premierę swojego najnowszego modelu – Gen-4. Nowa technologia, będąca następcą modelu Gen-3 Alpha, wprowadza przełomowe ulepszenia w zakresie spójności postaci, lokalizacji i obiektów w generowanych filmach, a także oferuje bardziej realistyczną fizykę ruchu. Model jest już udostępniany użytkownikom płatnym oraz klientom korporacyjnym, zdaniem twórców może zrewolucjonizować proces tworzenia narracyjnych treści wideo.

Gen-4 rozwiązuje jeden z największych problemów generatywnego wideo – brak spójności wizualnej między ujęciami. W przeciwieństwie do wcześniejszych modeli, takich jak Gen-2 czy Gen-3, które miały trudności z utrzymaniem jednolitości postaci i tła w różnych ujęciach, Gen-4 pozwala na tworzenie sekwencji z zachowaniem ciągłości wizualnej. Dzięki temu filmowcy mogą generować wideo z dynamicznym ruchem kamery i realistycznymi efektami, ale bez nienaturalnych czy też niepożądanych zniekształceń prezentowanych obiektów, co otwiera nowe możliwości dla dłuższych form narracyjnych, takich jak filmy fabularne. Runway podkreśla, że model ten jest odpowiedzią na potrzeby profesjonalistów z branży kreatywnej, w tym projektantów i reżyserów.

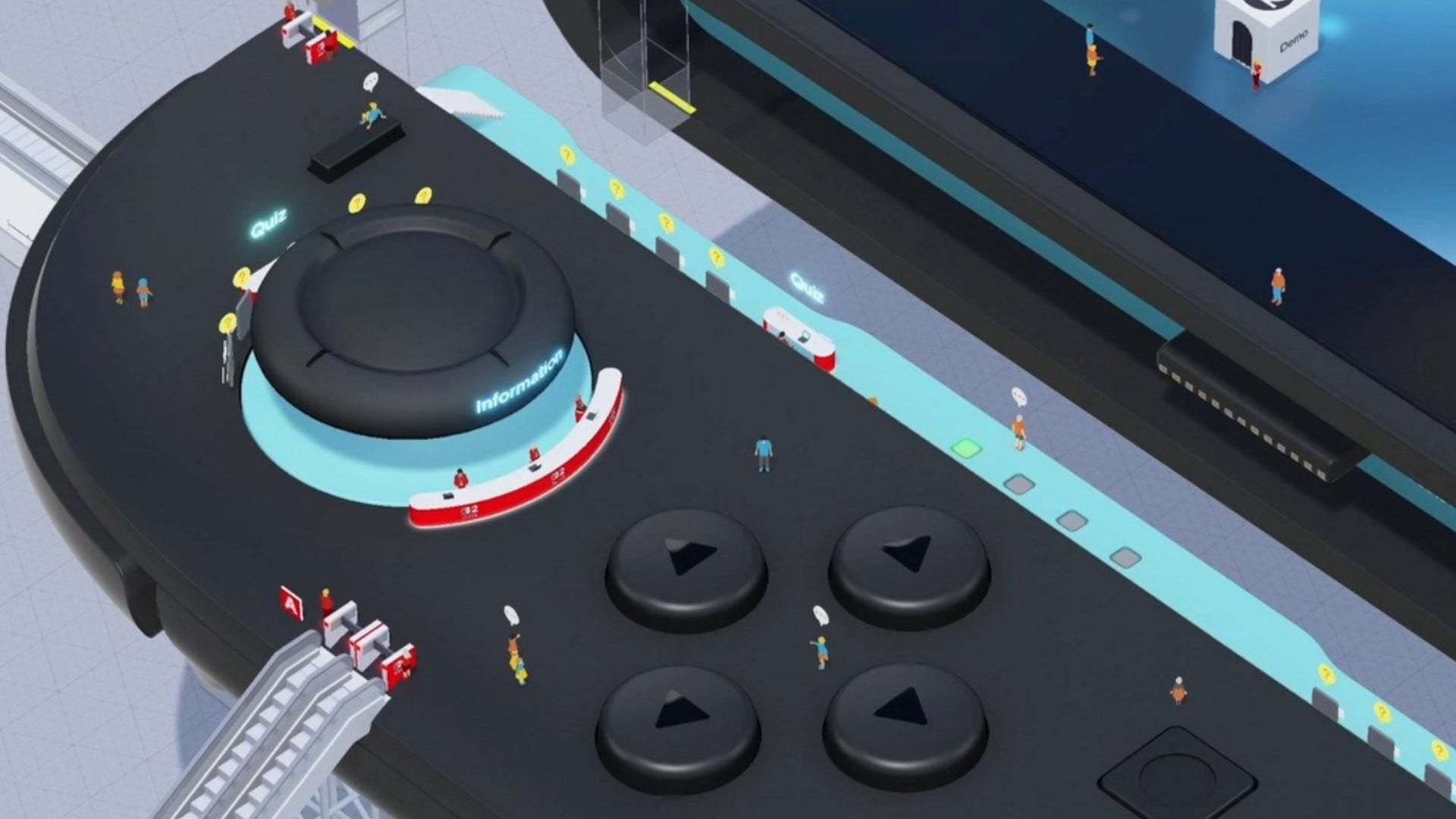

Model Gen-4 opiera się na technologii image-to-video, umożliwiając tworzenie wideo na podstawie obrazów referencyjnych i instrukcji tekstowych. Użytkownicy mogą precyzyjnie kontrolować style, postaci i lokalizacje, co zapewnia większą kontrolę nad narracją. Runway zademonstrowało możliwości modelu, publikując teledysk wygenerowany w całości za pomocą Gen-4, co spotkało się z entuzjastycznym odbiorem. Rzeczony materiał poniżej:

Runway podkreśla, że nie walczy z klasyczną kinematografią, lecz ją wspiera. Zresztą firma współpracuje z Hollywood – m.in. ze studiem Lionsgate, tworząc dedykowane modele AI oparte na katalogu ponad 20 000 tytułów.

Runway od lat buduje swoją markę, koncentrując się na potrzebach filmowców, w odróżnieniu od konkurentów, takich jak OpenAI, którzy stawiają na bardziej uniwersalne narzędzia wideo. Gen-4 to kolejny krok w kierunku stworzenia kompleksowego procesu produkcyjnego wideo – od uchwycenia mimiki (dzięki funkcji Act-One) po generowanie spójnych sekwencji wideo. Firma uruchomiła także fundusz Hundred Film Fund, oferując twórcom do 1 miliona dolarów na produkcje wykorzystujące AI, co pokazuje jej ambicje w transformacji przemysłu filmowego.

Wprowadzenie Gen-4 jest określane jako „szczególny moment” w rozwoju technologii AI dla mediów. Choć model wciąż ma ograniczenia – np. generuje klatki w rozdzielczości 720p, co jest poniżej standardu 4K wymaganego w nowoczesnych produkcjach – jego możliwości wskazują na ogromny potencjał. To co wydawało się najtrudniejsze, czyli zachowanie spójności sceny, udało się uzyskać. Rozdzielczość wyniku to kwestia skali i mocy, a nie wyrafinowania „myślenia” AI. Nie da się ukryć, że wygenerowane przez najnowszy model Gen-4 klipy robią wrażenie. Ciekawe jak odpowie OpenAI ze swoim modelem Sora.

OpenAI udostępniło AI Sora – generatywną sztuczną inteligencję do tworzenia wideo

Jeśli artykuł Runway wprowadza Gen-4: coraz trudniej poznać, że wideo jest wygenerowane przez AI nie wygląda prawidłowo w Twoim czytniku RSS, to zobacz go na iMagazine.

![Weekendowa Lektura: odcinek 617 [2025-03-29]. Bierzcie i czytajcie](https://zaufanatrzeciastrona.pl/wp-content/uploads/2024/02/library.jpg)

![Wiemy wszystko o Nintendo Switch 2. Teraz spokojnie czekam na Nintendo Switch 2 OLED [OPINIA]](https://static.android.com.pl/uploads/2025/04/VS-YouTube-NintendoDirectNintendoSwitch2422025-5148.png)

![Dorastanie na Marsie [niepublikowany nigdzie indziej fragment książki]](https://naukatolubie.pl/app/uploads/2025/03/Niespokojnepokolenie_blog.png)

![Ali Alkhatib o biurokracji i utopii algorytmów [wywiad]](https://panoptykon.org/sites/default/files/2025-03/pismo-kwestionariusz-nguyen-dang-.jpg)