DeepMind muestra todas las formas en las que la AGI (inteligencia artificial general) podría acabar con la humanidad

Con todos los avances que se van haciendo con la inteligencia artificial vemos como esta va implementándose en cada vez más sitios e influye en nuestras vidas. Hay personas que en su día a día dependen de IA como ChatGPT para recibir asistencia y ayuda incluso en el trabajo. Otros la necesitan para poder ser La entrada DeepMind muestra todas las formas en las que la AGI (inteligencia artificial general) podría acabar con la humanidad aparece primero en El Chapuzas Informático.

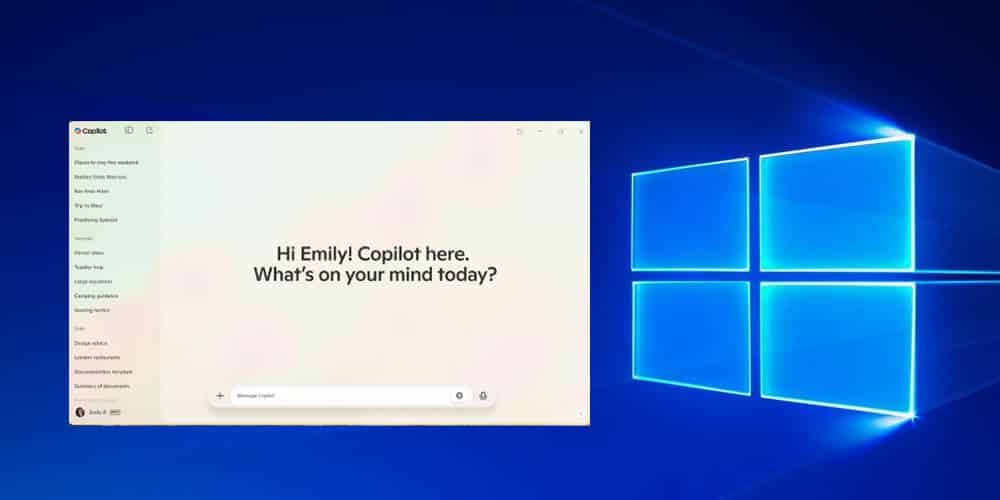

Con todos los avances que se van haciendo con la inteligencia artificial vemos como esta va implementándose en cada vez más sitios e influye en nuestras vidas. Hay personas que en su día a día dependen de IA como ChatGPT para recibir asistencia y ayuda incluso en el trabajo. Otros la necesitan para poder ser más rápidos a la hora de hacer tareas o simplemente por pura curiosidad y para generar contenido como las imágenes estilo Ghibli de hace poco. Sea como sea, la IA no va a desaparecer y va a ir a más, pues se espera que en un futuro próximo tengamos una inteligencia artificial más inteligente. Se espera que en unos años el ser humano logre desarrollar una inteligencia artificial general (AGI) y los investigadores de Google DeepMind han hablado de todas las formas en las que podría acabar con la humanidad.

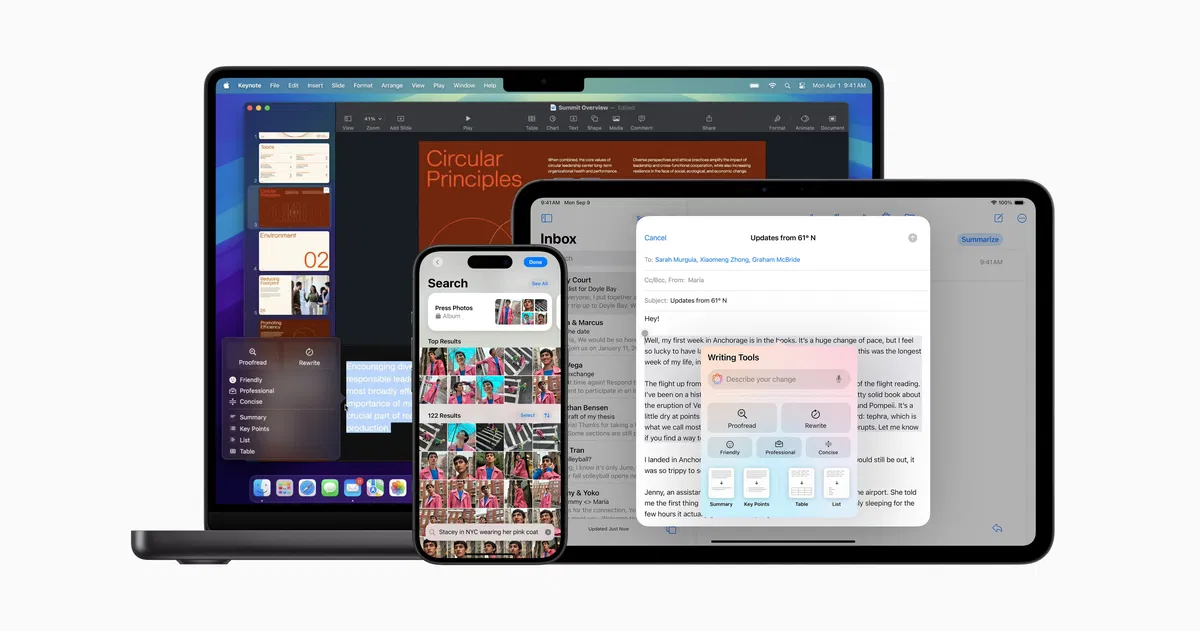

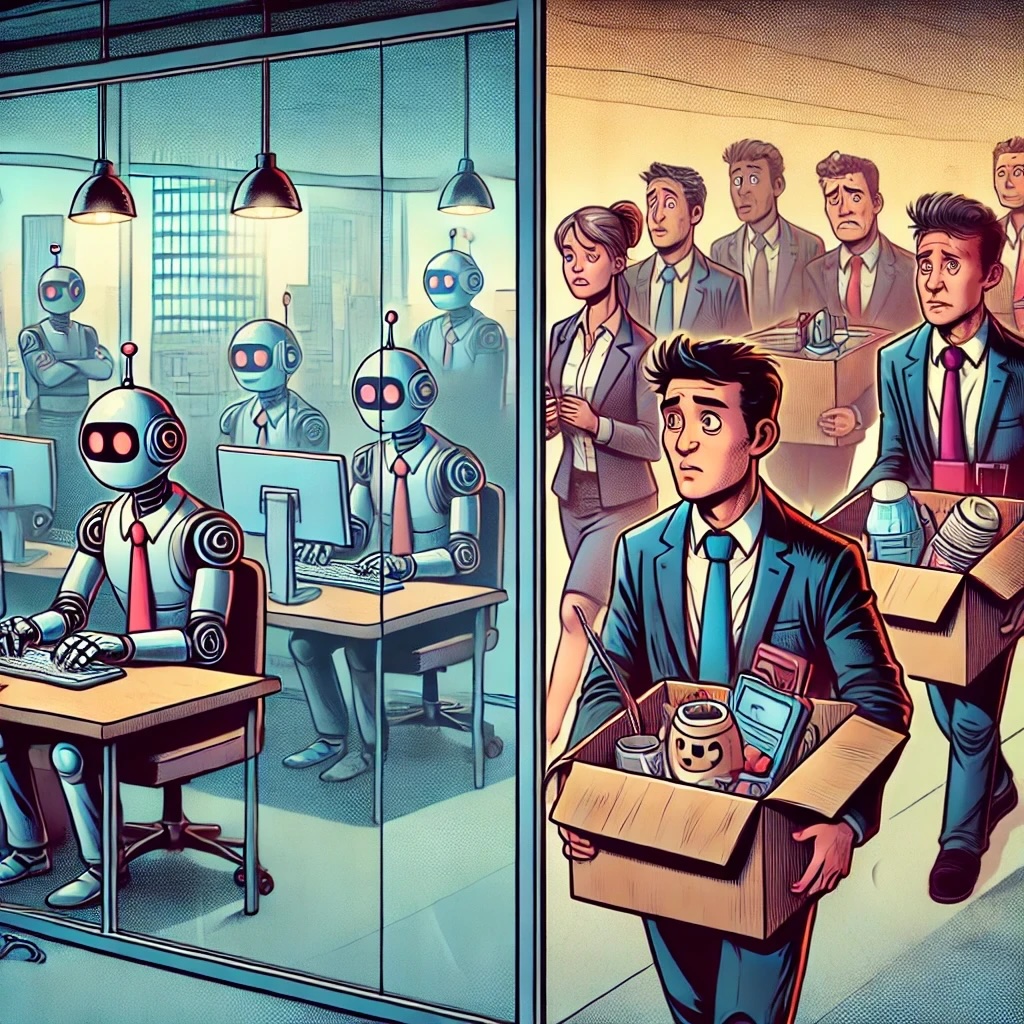

En el momento en el que la inteligencia artificial empezó a popularizarse sabíamos que no iba a parar hasta arrasar con todo. Se trata de una herramienta que a ojos de muchos es una revolución al completo, pues podemos ahorrarnos mucho tiempo de hacer trabajos tediosos y que costarían meses en cuestión de minutos. Aquí estamos hablando de demostraciones de como la IA generativa puede crear arte, imágenes, vídeos, música y novelas en cuestión de minutos, algo que sin duda a un ser humano le costaría muchísimo más tiempo.

Los ingenieros de Google DeepMind muestran las 4 principales formas en las que una AGI podría acabar con la humanidad

No sabemos que es lo que el futuro nos depara, este siempre es incierto, pero sin duda, con la inteligencia artificial metiendo presión, sabemos que todo podría acabar mal. Ya hemos visto que incluso cuando esta estaba verde y no la habían desarrollado mucho, ya había empresarios que empezaron a reemplazar a sus trabajadores por una inteligencia artificial. Empresas como Tesla ya han empezado a desarrollar robots humanoides capaces de andar y hacer varias tareas y Amazon ya ha comenzado a probar robots en sus almacenes para hacer tareas repetitivas.

El fin de los puestos de trabajo para los humanos no es tan descabellado, pero hay muchos que van más allá y creen que acabará con la humanidad, incluyendo a James Cameron. Ahora los investigadores de Google DeepMind han trabajado en un documento de 108 páginas que muestra los riesgos de desarrollar lo que se conoce como AGI (Inteligencia Artificial General), pues esta podría destruir a la humanidad.

En estos documentos nos encontramos con varios factores de riesgo potencial, empezando con un mal uso de la IA, pues las propias personas podrían ordenar a esta que cause daño a los humanos y estos serían a su vez enemigos de la propia inteligencia artificial, creando un conflicto. Para evitarlo tendrían que implementar protocolos de seguridad avanzados que se aseguren que no se cumplen estas órdenes, como las leyes de Isaac Asimov, pero más complejos.

El control de las IA depende de nosotros, los protocolos de seguridad y límites que pongamos, siempre y cuando no se los salten

El segundo caso de riesgo potencial sería el de la desalineación que implica que la IA realiza acciones que no quiere su desarrollador. Esto implicaría una rebeldía por parte de las IA y no seguiría los límites impuestos por su creador, algo que sin duda nos recuerda a obras de ciencia ficción donde el conflicto no acaba bien para los humanos. Los investigadores sugieren utilizar una supervisión más avanzada donde hay copias de la IA que se encargan de controlar las máquinas que se rebelan.

El tercer factor potencial de riesgo es el que las AGI no son perfectas y como IA que son podrían equivocarse a la hora de seguir órdenes o realizar las tareas que le pidamos de otra forma que no queremos. Si la equivocación acaba haciendo daño a la humanidad, aquí tendríamos otro gran problema. Los investigadores sugieren utilizar una medida de protección adicional para asegurarse que lo aprendido va a ser seguro.

Por último tenemos los riesgos estructurales que implican que las AGI podrían hacer daño empleando múltiples agentes, pero no tendrían culpa de forma individual. Para explicarlo han indicado que podrían juntarse varios agentes y acabar engañando con desinformación sin saber de donde proviene o quién ha sido el culpable. Habría que realizar investigaciones y descubrir quién ha empezado todo. Aún no tenemos fecha para el lanzamiento de la primer AGI, pero creen que podría aparecer en 2030, así que solo quedarían 5 años.

La entrada DeepMind muestra todas las formas en las que la AGI (inteligencia artificial general) podría acabar con la humanidad aparece primero en El Chapuzas Informático.

![Plataformas de streaming más usadas en España [2025]](https://www.trecebits.com/wp-content/uploads/2023/02/canales-streaming-150x150.webp?#)