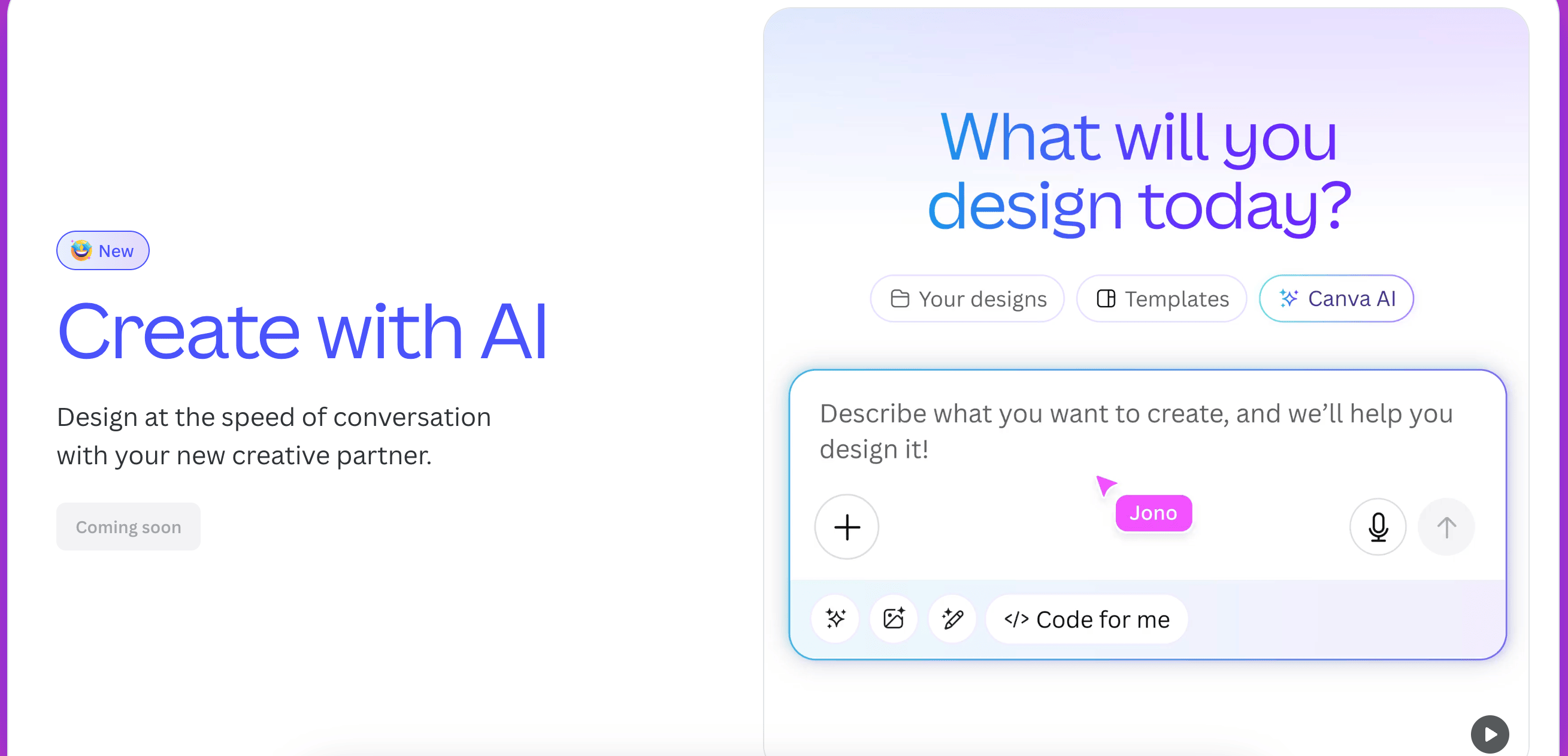

KI testet Algorithmus zum verlässlichen Unterbinden von „KI-Jailbreaks“

Anthropic hat ein neues Sicherheitssystem für sein Sprachmodell Claude entwickelt, das sogenannte Jailbreaks erschweren soll. Mit Constitutional Classifiers filtert das System problematische Anfragen, um zu verhindern, dass Claude unerwünschte Inhalte generiert. In 95 Prozent der getesteten Fälle zeigte sich das System erfolgreich – bietet bei der Implementierung aber auch Nachteile.

:quality(80)/p7i.vogel.de/wcms/77/81/778160cdf42db195f3bb723282065ce2/0122969592v1.jpeg?#)

:quality(80)/p7i.vogel.de/wcms/77/81/778160cdf42db195f3bb723282065ce2/0122969592v1.jpeg) Anthropic hat ein neues Sicherheitssystem für sein Sprachmodell Claude entwickelt, das sogenannte Jailbreaks erschweren soll. Mit Constitutional Classifiers filtert das System problematische Anfragen, um zu verhindern, dass Claude unerwünschte Inhalte generiert. In 95 Prozent der getesteten Fälle zeigte sich das System erfolgreich – bietet bei der Implementierung aber auch Nachteile.

Anthropic hat ein neues Sicherheitssystem für sein Sprachmodell Claude entwickelt, das sogenannte Jailbreaks erschweren soll. Mit Constitutional Classifiers filtert das System problematische Anfragen, um zu verhindern, dass Claude unerwünschte Inhalte generiert. In 95 Prozent der getesteten Fälle zeigte sich das System erfolgreich – bietet bei der Implementierung aber auch Nachteile.

,regionOfInterest=(1029,772)&hash=f6d43959338da8730f2364bfbf7e06c06bb2beb8ccfbb9fc1befe896e501bdb3#)

![SEO-Monatsrückblick März 2025: Google AIO in DE, AI Mode, LLMs + mehr [Search Camp 369]](https://blog.bloofusion.de/wp-content/uploads/2025/03/Search-Camp-Canva-369.png)

![Deals: Magic: The Gathering - Die Drachen sind los im neuen und besten Set des Jahres [Anzeige]](https://images.cgames.de/images/gamestar/4/dragonstorm-teaser_6348938.jpg?#)

:quality(80)/p7i.vogel.de/wcms/ff/b4/ffb40046e35d80b012f5d322d3606e21/0124003211v1.jpeg?#)

:quality(80)/p7i.vogel.de/wcms/b7/71/b771a4a0199910c14f6223162383d75f/0124144076v1.jpeg?#)

:quality(80)/p7i.vogel.de/wcms/82/3d/823d8418492c6bca797a6454b0d0bca5/0123745610v2.jpeg?#)

:quality(80)/p7i.vogel.de/wcms/c2/a8/c2a8858871bf84716844605387a32f8c/0123323806v2.jpeg?#)

:quality(80)/p7i.vogel.de/wcms/b6/60/b6603085f626d8035ed109ce21ddaef1/0120969640v1.jpeg?#)

:quality(80)/p7i.vogel.de/wcms/bc/5a/bc5ab0e19140158bfdb171533b29c69b/0123694005v1.jpeg?#)