Llama 4 auf WhatsApp und Instagram schon zu nutzen: Die besten multimodalen KI-Modelle bisher?

Llama ist Metas neue, offene KI – multimodal, leistungsstark und jetzt in WhatsApp und Instagram integriert. Das steckt hinter den Modellen Scout, Maverick und Behemoth.

Today is the start of a new era of natively multimodal AI innovation.

Mit diesem Satz läutet Meta offiziell den Release seiner Llama 4-Modelle ein – und dieser Satz ist nicht übertrieben.

Auf Threads ansehen

Meta bringt mit Scout und Maverick zwei sofort nutzbare Modelle ins Rennen – beide offen verfügbar auf llama.com und Hugging Face. Das Flaggschiff Behemoth bleibt vorerst in der Preview, dient aber schon jetzt als leistungsstarker „Teacher“ in der Co-Distillation der kleineren Modelle.

Während andere Big Player noch an der nahtlosen Integration arbeiten, ist Metas neuestes KI-Update außerdem schon live auf Plattformen wie Instagram, dem Facebook Messenger und auf WhatsApp. User können also direkt im Feed oder Chat auf die neuesten Modelle zugreifen – und erleben, was multimodale KI im Alltag bedeutet. Doch was genau steckt hinter Llama 4 Scout, Maverick und dem Preview-Modell Behemoth? Und warum feiern Entwickler:innen und KI-Expert:innen wie Jens Polomski bei einem Llama 4-Modell sogar von einem „der größten und leistungsfähigsten Modelle, die je gebaut wurden“?

Ein Blick in die Meta-Welt zeigt: Diese Modelle setzen neue Standards in Sachen Effizienz, Multimodalität und Offenheit – mit potenziellen Auswirkungen auf Marketing, Content-Erstellung und Kund:innenkommunikation.

Meta AI kommt endlich nach Deutschland:

So nutzt du sie auf WhatsApp und Instagram

Meta AI in WhatsApp und Instagram: Multimodale Intelligenz direkt im Messenger

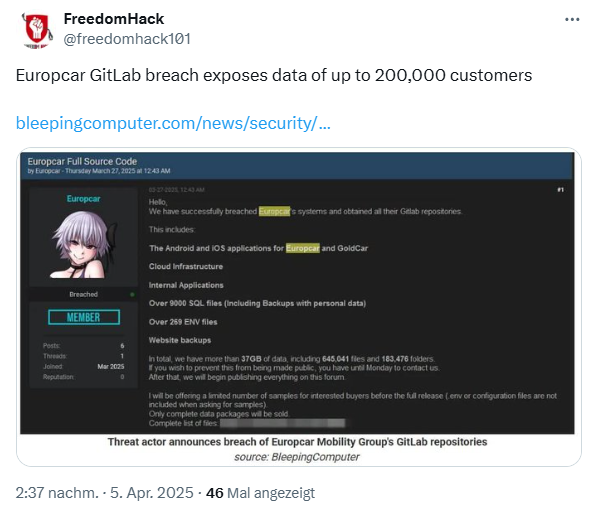

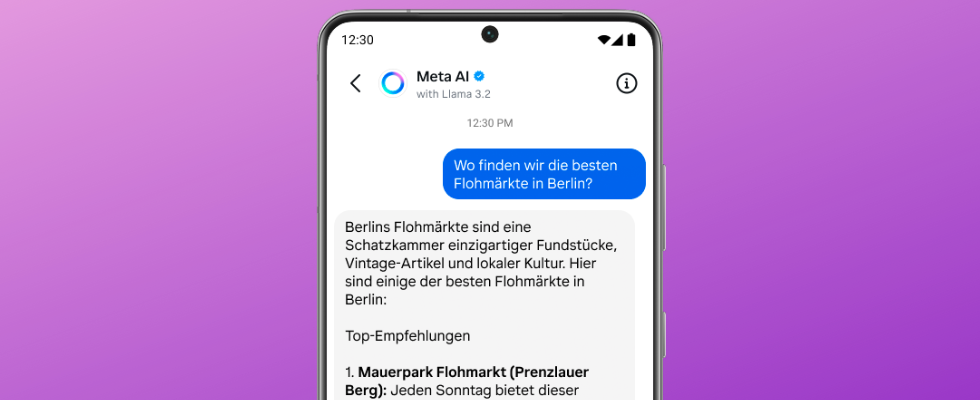

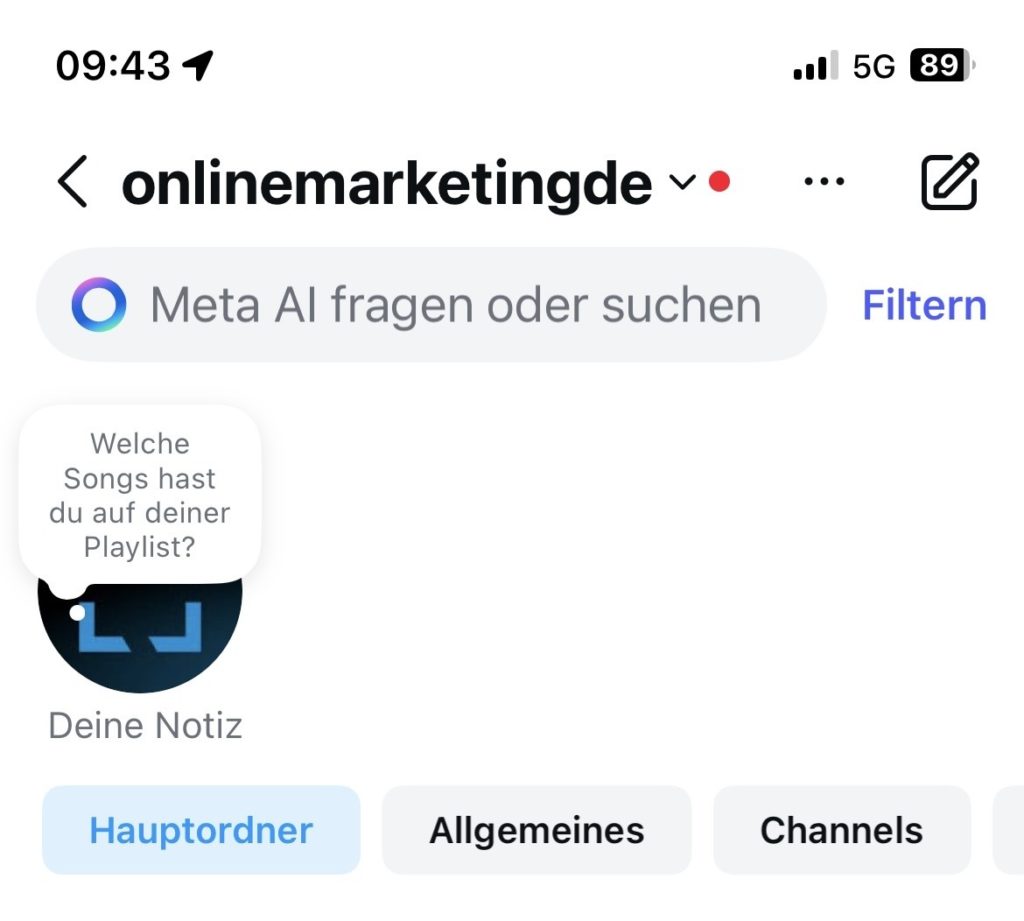

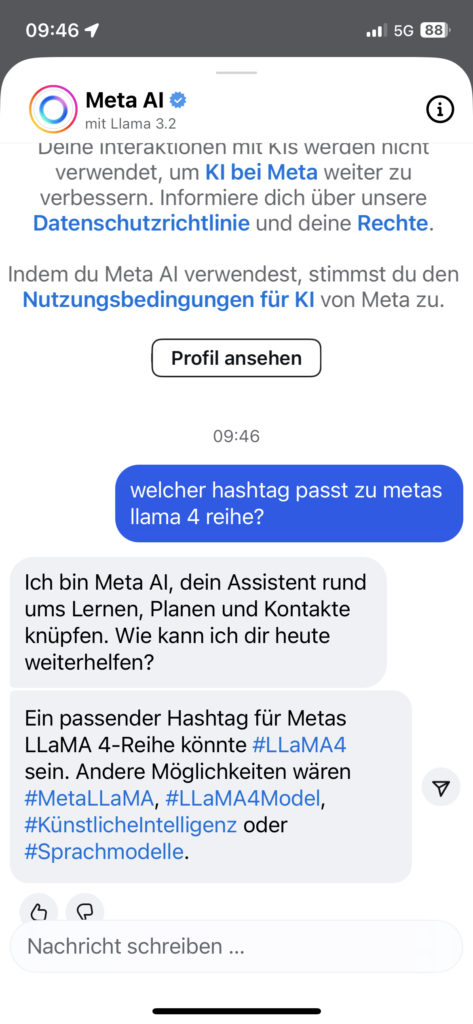

Ein Scroll durch die Instagram Direct Messages oder den WhatsApp Chats wirkt derzeit ziemlich futuristisch: Meta AI mit Llama 4 antwortet auf Eingaben, generiert auf Wunsch Bilder, analysiert Texte oder bietet kreative Impulse. Auch wir bei OnlineMarketing.de können Meta AI bereits direkt nutzen – etwa im Direct-Message-Bereich von Instagram. Allerdings bislang noch Llama 3.2, die Integration von Llama 4 dürfte aber zeitnah folgen. Dort erscheint die neue KI-Funktion prominent in der Suchleiste und lädt dazu ein, Fragen zu stellen oder Vorschläge zu erhalten. In unserem Test wurde beispielsweise gefragt: „Welcher Hashtag passt zu Metas Llama 4 Reihe?“. Die Funktion wirkt dabei nahtlos integriert und zeigt, wie natürlich sich Metas KI bereits in alltägliche Kommunikationsprozesse einfügt – ohne separate App oder technischen Aufwand.

Erste Eindrücke zeigen: Die Reaktionsgeschwindigkeit ist hoch, die Bildqualität ansprechend – und das Ganze ist eingebettet in ein intuitives Interface.

Auf Threads ansehen

Auch der Social-Media-Experte Jonah Manzano weist darauf hin, dass die Integration nicht nur auf WhatsApp, sondern auch auf Instagram und im Facebook Messenger sichtbar ist. Meta selbst bestätigt: Llama 4 kommt nicht nur auf die hauseigene Meta.AI Website, sondern auch zu alltagstauglichen Touchpoints – ein cleverer Schritt Richtung Massennutzung.

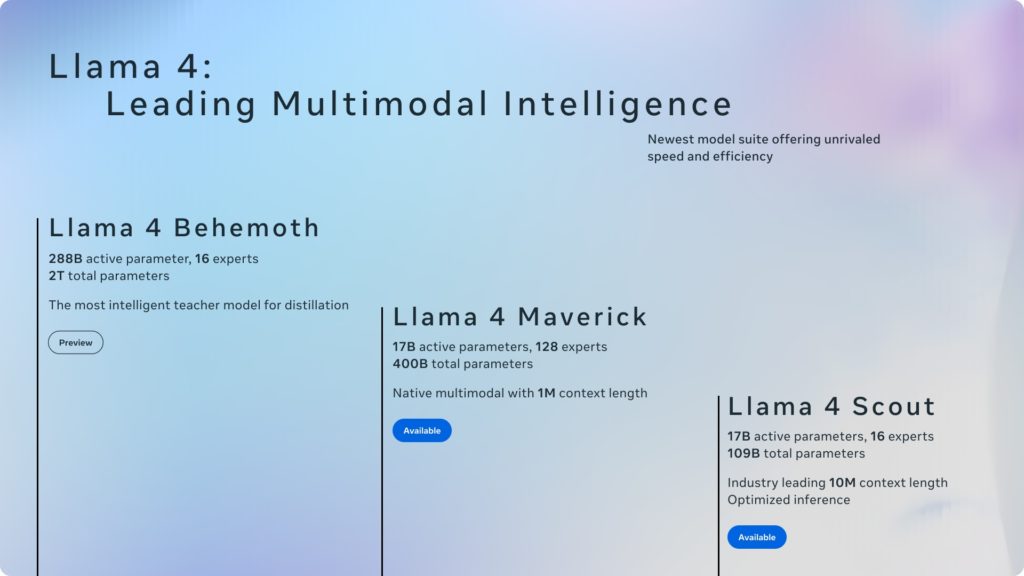

Llama 4: Scout, Maverick und Behemoth im Überblick – und was Zuckerberg dazu sagt

Mit der Llama 4-Serie bringt Meta drei neue Modelle auf den Markt, die sich in ihrer Architektur, Leistungsfähigkeit und Zielsetzung unterscheiden – aber alle auf native Multimodalität und Effizienz ausgelegt sind.

In einer kurzen Übersicht auf Threads hat Meta CEO Mark Zuckerberg die zentralen Eigenschaften der neuen Llama 4-Modelle zusammengefasst.

Auf Threads ansehen

In den Kommentaren betont er, dass Scout das leistungsstärkste kleine Modell sei, Maverick GPT-4o und Gemini Flash 2.0 übertreffe und Behemoth das „highest performing base model“ in Metas KI-Geschichte darstelle. Zudem kündigte er an, dass Meta in Kürze weitere Fortschritte im Bereich Reasoning veröffentlichen werde.

Ein Überblick über die Llama 4-Serie:

Llama 4 Scout läuft auf einer einzigen H100-GPU, nutzt 17 Milliarden aktive Parameter und 16 Experts – und kann bis zu zehn Millionen Tokens Kontext verarbeiten. Das ist branchenweit führend und macht das Modell ideal für lange Konversationen, komplexe Dokumentanalysen oder Multimodalaufgaben mit vielen Eingabedaten.

Llama 4 Maverick setzt auf eine leistungsfähige Mixture-of-Experts-Architektur mit 128 Experts bei gleicher aktiver Parameteranzahl. Es übertrifft laut Meta GPT-4o bei Aufgaben wie Reasoning, Coding und Bildverständnis – bei gleichzeitig geringerem Rechenaufwand im Vergleich zu Modellen wie DeepSeek. Besonders relevant: Maverick eignet sich durch seine Multimodalität auch für kreative Anwendungen und präzise visuelle Analysen.

Llama 4 Behemoth, das derzeit noch trainiert wird, ist das bislang größte Modell in der Reihe – mit über zwei Billionen Parametern. Erste Benchmarks zeigen, dass Behemoth leistungsstärker ist als GPT-4.5, Claude Sonnet 3.7 und Gemini Flash 2.0 Pro in mathematischen und naturwissenschaftlichen Aufgaben. Meta bezeichnet es als „Teacher“-Modell, das als Basis für die kleineren Varianten dient.

Was Llama 4 für Entwicklung, Marketing und Kreation bedeutet

Llama 4 ist nicht nur ein technisches Upgrade – es ist ein Werkzeug für konkrete Anwendungen. Entwickler:innen, Marketer und Creator profitieren gleichermaßen von der Kombination aus hoher Leistungsfähigkeit und offener Zugänglichkeit.

Besonders positiv fällt in der Tech Community auf, dass Meta trotz der beeindruckenden Performance an seinem Open-Source-Ansatz festhält. Tech-Expert:innen wie Jens Polomski feiern das Zehn-Millionen-Token-Kontextfenster und den Open-Access-Ansatz als „völlig neue Dimension für Multimodalität“. Sein Urteil:

Respekt, Meta.

Entwickler:innen profitieren außerdem von einer neuen Trainingsarchitektur mit Early Fusion, FP8-Precision und einem Curriculum, das anspruchsvolle Prompts gezielt in die Post Training Pipeline einspeist. So entstehen Modelle, die nicht nur intelligent, sondern auch anwendungsnah agieren – ob in Codierung, visuellem Verstehen oder Sprachverständnis.

Doch das Potenzial geht über die Entwicklung hinaus. Was auf den ersten Blick wie ein nettes Gimmick im Messenger wirkt, könnte die Art und Weise, wie Marken Inhalte erstellen und kommunizieren, grundlegend verändern. Llama 4 Scout erkennt visuelle Elemente, analysiert User-Intentionen und generiert Texte in passendem Stil – auf Wunsch auch multimodal, etwa durch die Kombination von Bildern und Text oder mehreren Input-Quellen gleichzeitig.

Für Content Teams und Agenturen bedeutet das: KI-gestütztes Copywriting, automatisiertes Visual Storytelling und neue Möglichkeiten im Community Management – direkt in der Plattform. Influencer können mithilfe von Scout etwa neue Ideen für Reels, Captions oder Karussells entwickeln und ihre Follower stärker einbinden. Meta selbst beschreibt Scout als das „beste multimodale Modell seiner Klasse“ – und lässt mit der breiten Integration in WhatsApp, Instagram und Messenger keinen Zweifel daran, dass diese Klasse nicht nur im Backend, sondern im Alltag zum Einsatz kommen soll.

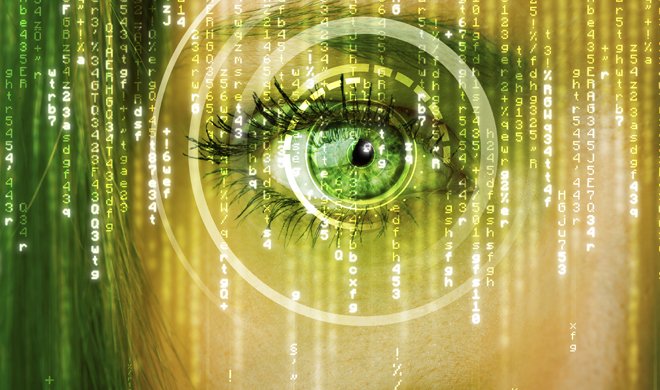

Transparenz und Verantwortung: Was User über Meta AI wissen sollten

So beeindruckend Metas Llama 4 auch ist – die Leistungsfähigkeit der drei Modelle beruht nicht nur auf technischer Raffinesse, sondern auch auf der massiven Datengrundlage, die dem Konzern zur Verfügung steht. Meta nutzt die Interaktionen mit seinen KI-Systemen, um diese weiter zu trainieren und zu verbessern – und greift dabei auf eine enorme Menge an Nutzer:innendaten zurück. Wer Meta AI nutzt, sollte sich darüber im Klaren sein, dass der Konzern persönliche Inhalte und Verhaltensmuster systematisch analysiert, um daraus leistungsfähigere Modelle zu entwickeln.

Gerade im Marketing- und Unternehmenskontext ist es daher essenziell, nicht nur die technologischen Möglichkeiten zu sehen, sondern auch die Frage nach Datenschutz, Datennutzung und ethischem Einsatz mitzubedenken. Die hohe Qualität von Meta AI hat ihren Preis – und der liegt nicht nur in GPU-Stunden, sondern oft auch in der Datenbereitstellung durch die Community selbst.

Llama 4 setzt neue Maßstäbe für multimodale KI in Produkt und Plattform

Mit der Llama-4-Reihe positioniert sich Meta klar als zentraler Player in der Entwicklung leistungsfähiger, multimodaler und offen zugänglicher KI-Modelle. Die Kombination aus hoher Effizienz, breitem Anwendungsspektrum und der nahtlosen Integration in Plattformen wie WhatsApp, Instagram und Messenger hebt Llama 4 von vergleichbaren Angeboten im Markt ab.

Durch Modelle wie Scout und Maverick wird multimodale KI nicht nur für Entwickler:innen und KI-Forschende, sondern auch für Marken, Content-Produzent:innen und Endnutzer:innen unmittelbar nutzbar. Behemoth, als leistungsstärkstes Basismodell, legt zudem die Grundlage für weitere Innovationen und zeigt, wie skalierbar Metas KI-Strategie ist.

Llama 4 steht damit nicht nur für neue Benchmarks – sondern für den nächsten Schritt in der praktischen Anwendung generativer KI: offen, effizient, multimodal und direkt im Alltag einsetzbar.

Meta testet eigenen KI-Chip und investiert Milliarden in KI-Ausbau

![SEO-Monatsrückblick März 2025: Google AIO in DE, AI Mode, LLMs + mehr [Search Camp 369]](https://blog.bloofusion.de/wp-content/uploads/2025/03/Search-Camp-Canva-369.png)

![Warum die Google Search Console eines der wichtigsten Relaunch-Werkzeuge ist [Search Camp 368]](https://blog.bloofusion.de/wp-content/uploads/2025/02/Search-Camp-Canva-368.png)

![Deals: LED there be light! - Diese Streifen sind eine viel günstigere Alternative zu Philips Hue [Anzeige]](https://images.cgames.de/images/gamestar/4/klyqa-strype-basic-teaser-2_6347303.jpg?#)

:quality(80)/p7i.vogel.de/wcms/d4/28/d42892f546f8309f080d52c054b3b245/0123934224v1.jpeg?#)

:quality(80)/p7i.vogel.de/wcms/fe/69/fe69c65a1d8fdc7605adc34a1fe08279/0123788698v2.jpeg?#)

:quality(80)/p7i.vogel.de/wcms/53/66/53666d0ad5146321d8d9a58bfb1ccb95/0124011502v2.jpeg?#)

:quality(80)/p7i.vogel.de/wcms/63/cf/63cf12cec8d640fada674a3efbad87c3/0124017609v2.jpeg?#)