Meta nutzt jetzt auch EU-User-Daten für KI-Training

In der EU werden deine Daten ab jetzt ebenfalls für das KI-Training von Meta verwendet, wenn du nicht widersprichst. Erfahre, welche Inhalte der Konzern nutzt und welche Ausnahmen es gibt.

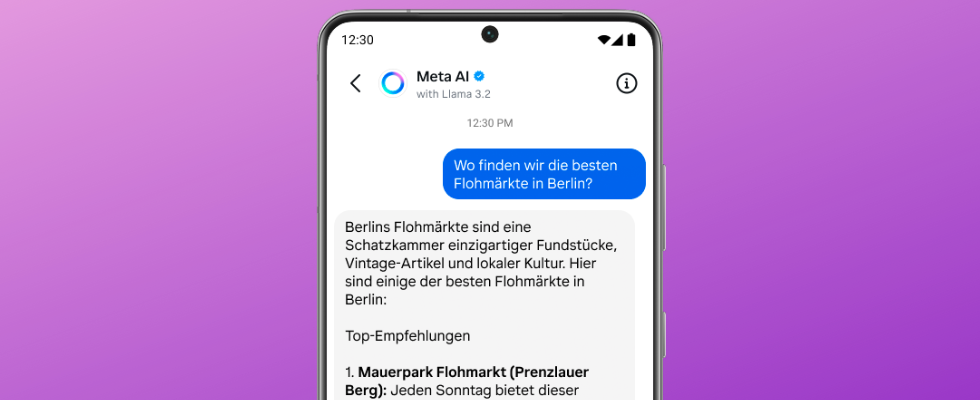

Ab dieser Woche nutzt Meta Milliarden von User-Daten aus Deutschland und weiteren EU-Ländern, um die eigene KI zu trainieren. Noch vor weniger als einem Jahr stoppte der Konzern den Roll-out der umfassenden Meta AI in der Europäischen Union, weil die irische Datenschutzbehörde gegen ein solches KI-Training mit User-Daten erfolgreich Beschwerde eingelegt hatte. Seinerzeit sah Meta in der Forderung der Behörde einen Rückschritt für europäische Innovation und Wettbewerb in der KI-Entwicklung. Seither sind einige Monate verstrichen, das European Data Protection Board hat Metas ursprünglichen Ansatz gebilligt und seit kurzem können User in der EU ebenso auf die Meta AI zugreifen, im Messenger, bei Instagram, Facebook oder auch WhatsApp. Erste Nutzer:innen haben dabei sogar Zugriff auf Metas brandneues Llama 4-Modell.

Wenig überraschend kommt daher jetzt die Nachricht, dass Meta doch bestimmte Nutzer:innendaten für das KI-Training heranziehen wird. Das rahmt der Konzern allerdings äußerst positiv mit dem Worten: „Making AI Work Harder for Europeans“. Während Datenschützer:innen und User beunruhigt sein mögen, gibt es eine Widerspruchsoption. Und es sind längst nicht alle Daten betroffen.

Meta AI kommt endlich nach Deutschland:

So nutzt du sie auf WhatsApp und Instagram

So nutzt Meta User-Daten in der EU: Mehr Kontext, mehr Werbung?

Die Datennutzung für das KI-Training soll laut Meta Millionen von User und Unternehmen langfristig unterstützen. Denn mehr Kontext von Nutzer:innen hilft dem Konzern, die KI mit Details zu Nutzungsgewohnheiten, Conten-Mustern und menschlicher Sprache zu optimieren. Dabei ist der Ansatz keineswegs Meta vorbehalten; man verweist im Blog Post auf die Praktik, die ebenso von der Konkurrenz genutzt wird.

[…] It’s important to note that the kind of AI training we’re doing is not unique to Meta, nor will it be unique to Europe. This is how we have been training our generative AI models for other regions since launch. We’re following the example set by others including Google and OpenAI, both of which have already used data from European users to train their AI models. We’re proud that our approach is more transparent than many of our industry counterparts.

Gerade diese Praktik aber besorgt manche User, die ihre Daten nicht weitergeben möchten. Datenschützer:innen hingegen fürchten, dass die für das KI-Training gesammelten Daten dazu beitragen könnten, schwer nachvollziehbare Copyright-Verstöße, Content-Aneignung und Privatsphäreeinschränkungen im Digitalraum zu fördern. Meta erhofft sich indes mehr Informationen für die KI-Optimierung und sicherlich auch wertvolle Kontextinformationen zur Optimierung künftiger Werbeausspielungen. Denn die Monetarisierung von Meta AI-Integrationen, etwa in der Suche auf Instagram, wird bereits diskutiert. CFO Susan Li erklärte im Earnings Call zum vierten Quartal 2024:

[…] There will, I think, be pretty clear monetization opportunities here over time including paid recommendations and including a premium offering, but that’s really not where we are focused in terms of the development of Meta AI today […].

Nun soll die Datennutzung in der EU das KI-Angebot auf die Bedürfnisse der User zuzuschneiden helfen. Dafür werden öffentliche Posts sowie Interaktionen mit der Meta AI eingesetzt. Doch User können das KI-Training auch ablehnen und es gibt eine Ausnahme bei der Datennutzung.

Opt-out als Option: So können User das KI-Training mit ihren Inhalten umgehen

Öffentliche Daten von Usern unter 18 Jahren werden von Meta nicht für das KI-Training genutzt. Alle anderen Nutzer:innen müssen sich aber darauf einstellen und sollen Benachrichtigungen auf den Plattformen wie Instagram und Facebook erhalten. Im Rahmen dieser Benachrichtigungen können sie über einen Link zu einem Formular gelangen, über das sie per Opt-out dem Daten-Training entsagen können. Dieses Formular soll einfach verständlich und einfach zu finden sein.

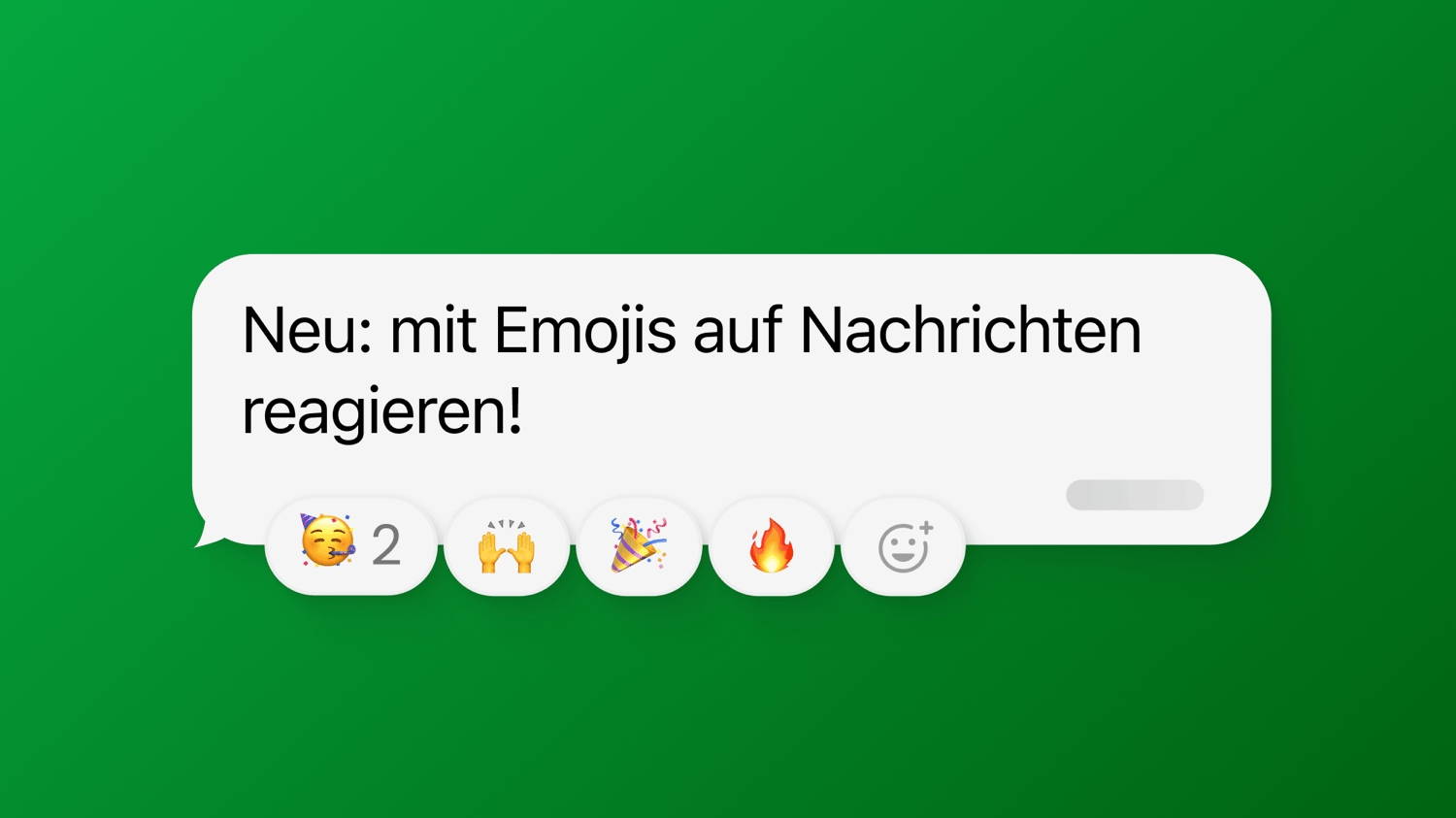

Nicht für das Training vorgesehen sind persönliche Nachrichten. Diese sind beispielsweise auf WhatsApp auch mit einer Ende-zu-Ende-Verschlüsselung versehen. Für Chats und Interaktionen mit der Meta AI gilt diese Verschlüsselung aber nicht. Allgemein werden die Inhalte, die User mit der Meta AI teilen, für die Optimierung der KI genutzt, sodass nur er Verzicht auf die Nutzung des KI-Bots sicherstellen dürfte, dass diese Daten nicht verwendet werden.

Es gilt für Nutzer:innen im EU-Raum also ab jetzt, eine Entscheidung bezüglich ihrer Bereitschaft zur Datenweitergabe auf Metas Plattformen zu treffen. Das gilt aber ebenso für die Nutzung von anderen Diensten, die mit öffentlichen Daten ihre KI trainieren – und das sind dieser Tage die meisten.

Llama 4 auf WhatsApp und Instagram schon zu nutzen:

Die besten multimodalen KI-Modelle bisher?

,regionOfInterest=(942,791)&hash=f88d02d1f1cfcdf218e7ea8d41d6cd20f3027b39322ba24f9d32742eddd6f758#)

,regionOfInterest=(221,219)&hash=fe2269091cfe3283ee258652379c636ad9bc8ca4c354db1a0a89482978a55a4d#)

![SEO-Monatsrückblick März 2025: Google AIO in DE, AI Mode, LLMs + mehr [Search Camp 369]](https://blog.bloofusion.de/wp-content/uploads/2025/03/Search-Camp-Canva-369.png)

![Deals: Magic: The Gathering - Die Drachen sind los im neuen und besten Set des Jahres [Anzeige]](https://images.cgames.de/images/gamestar/4/dragonstorm-teaser_6348938.jpg?#)

:quality(80)/p7i.vogel.de/wcms/ff/b4/ffb40046e35d80b012f5d322d3606e21/0124003211v1.jpeg?#)

:quality(80)/p7i.vogel.de/wcms/b7/71/b771a4a0199910c14f6223162383d75f/0124144076v1.jpeg?#)

:quality(80)/p7i.vogel.de/wcms/77/81/778160cdf42db195f3bb723282065ce2/0122969592v1.jpeg?#)

:quality(80)/p7i.vogel.de/wcms/82/3d/823d8418492c6bca797a6454b0d0bca5/0123745610v2.jpeg?#)