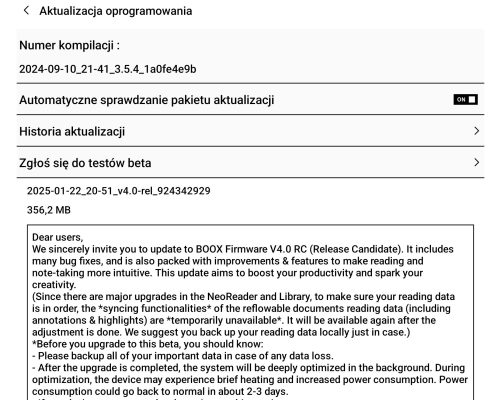

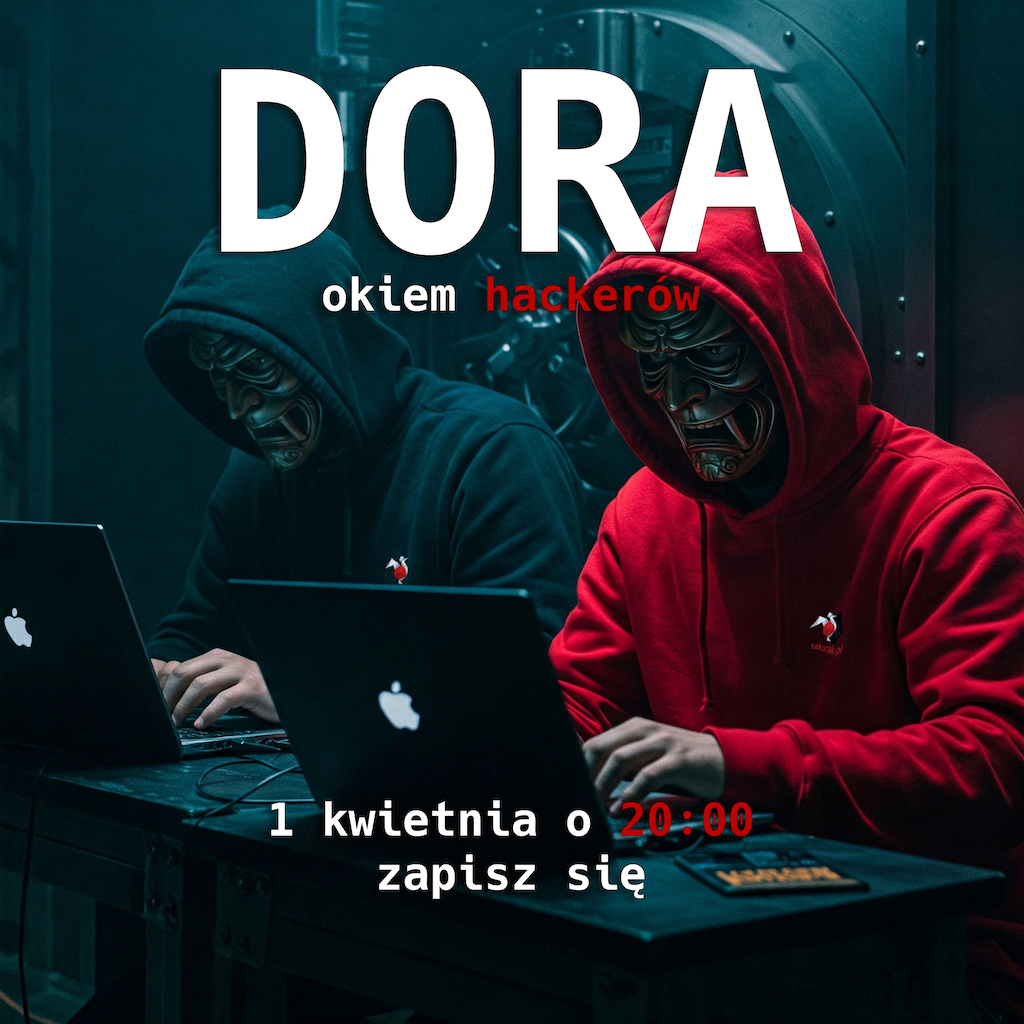

Coraz więcej AI w oszustwach telefonicznych

Globalne straty wynikające z cyberprzestępczości mogą osiągnąć wartość nawet 11,9 biliona dolarów do 2026 roku. Prognozy wskazują, że w ciągu pięciu lat kwota ta może wzrosnąć nawet o 65 proc., do poziomu blisko 20 bilionów dolarów w skali jednego roku. Działalność cyberprzestępców staje się coraz bardziej zorganizowana, a stosowane przez nich metody – wyrafinowane. W […]

Globalne straty wynikające z cyberprzestępczości mogą osiągnąć wartość nawet 11,9 biliona dolarów do 2026 roku. Prognozy wskazują, że w ciągu pięciu lat kwota ta może wzrosnąć nawet o 65 proc., do poziomu blisko 20 bilionów dolarów w skali jednego roku. Działalność cyberprzestępców staje się coraz bardziej zorganizowana, a stosowane przez nich metody – wyrafinowane. W atakach, zarówno tych wymierzanych w firmy, jak i indywidualnych użytkowników, coraz większą rolę odgrywa sztuczna inteligencja – czytamy raporcie Proxyrack.

Ataki cyberprzestępców są obecnie częściej wymierzane w przedsiębiorstwa, a nie w indywidualnych użytkowników. Nie oznacza to jednak, że zwykli internauci nie są podatni na zagrożenia online.

Często padają oni ofiarami ataków socjotechnicznych, takich jak phishing oraz jego pochodne. Jedna z takich metod – oszustwa telefoniczne, nazywane vishingiem – staje się szczególnie dużym zagrożeniem, gdy jest wspierana przez sztuczną inteligencję.

Cyberprzestępca-przedsiębiorca

Współczesne grupy cyberprzestępcze często funkcjonują na wzór typowych przedsiębiorstw. Mają złożone struktury organizacyjne, w tym działy sprzedaży, rekrutacji czy nawet systemy wynagrodzeń. Ich działalność jest dobrze zorganizowana i ukierunkowana na maksymalizację zysków finansowych.

RaaS jest jednym z powodów, dla których ataki ransomware stają się coraz bardziej powszechne. Model ten umożliwia bowiem przeprowadzanie zaawansowanych ataków także tym cyberprzestępcom, którzy nie mają odpowiednich umiejętności programistycznych do stworzenia własnych narzędzi. Przewiduje się, że w 2025 roku liczba ataków ransomware może wzrosnąć nawet o 57 proc. w porównaniu z rokiem 2024.

Zagrożenie, którego nie da się wykryć?

Sztuczna inteligencja staje się nieodłącznym elementem taktyk praktykowanych przez cyberprzestępców i jest obecnie wykorzystywana m.in. w celu modyfikacji istniejącego, złośliwego oprogramowania. Stosujący ją przestępcy szyfrują sygnatury (unikalne ciągi znaków służące do identyfikowania przez systemy bezpieczeństwa) niebezpiecznych plików, co umożliwia im omijanie klasycznych mechanizmów służących do wykrywania zagrożeń.

Przestępcy nierzadko łączą tę praktykę z innymi taktykami. Na przykład, w przypadku ataków ransomware decydują się na wykorzystanie złośliwego oprogramowania w wariancie sleeper. Po przedostaniu się do urządzenia ofiary, program ten, zgodnie ze swoją nazwą, pozostaje w stanie uśpienia do momentu jego aktywacji przez przestępcę. Celem tej taktyki jest stworzenie złudnego poczucia bezpieczeństwa i osłabienia czujności.

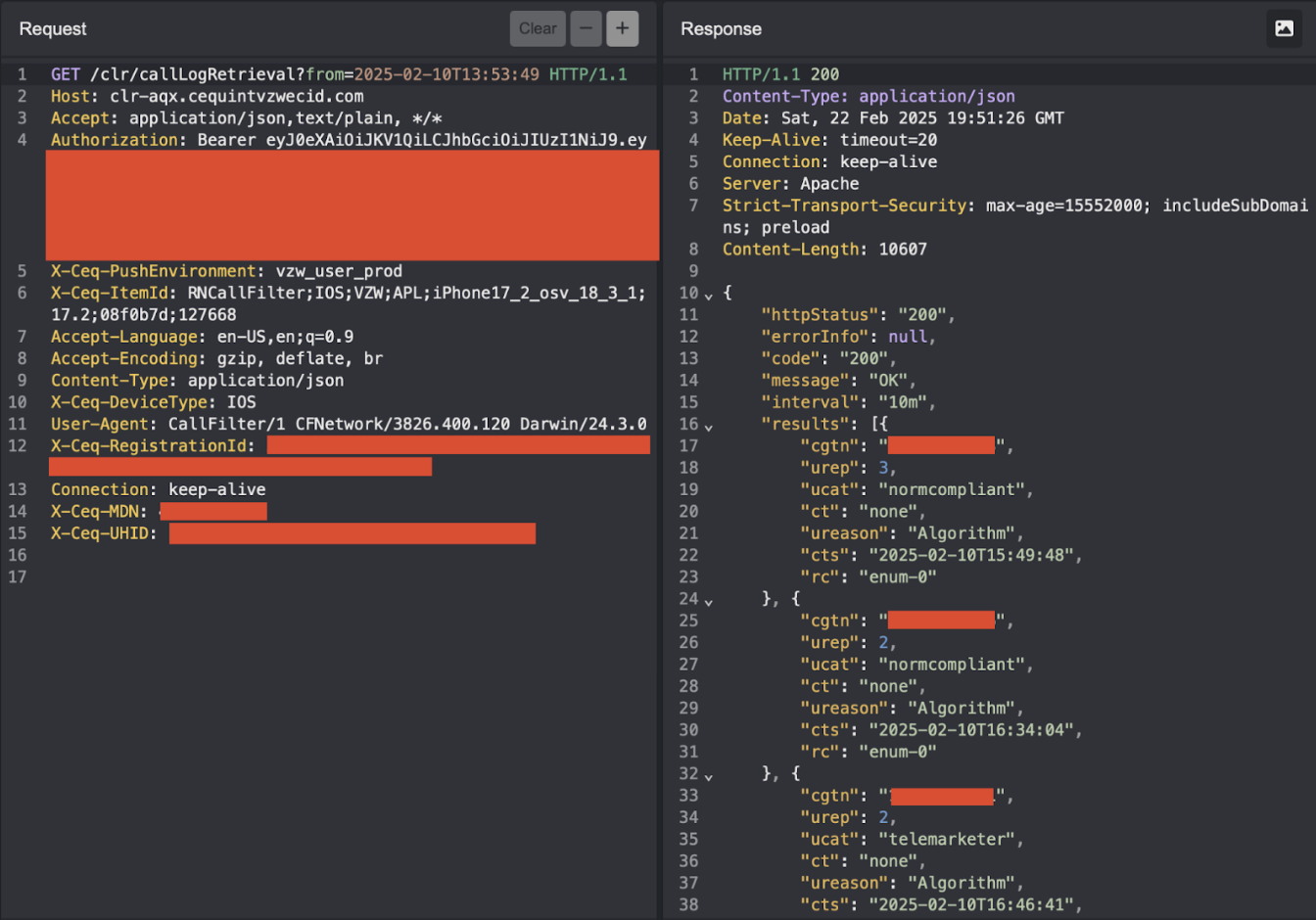

Aby osiągnąć maksymalny poziom widzialności sieci, warto wyposażyć się również w rozwiązania klasy EDR (Endpoint Detection and Response) oraz SIEM (Security Information and Event Management). Pierwsze z nich odpowiada za gromadzenie oraz analizę danych w czasie rzeczywistym z urządzeń końcowych – komputerów stacjonarnych, laptopów, telefonów i innych. Drugie zaś monitoruje, rejestruje i analizuje alerty bezpieczeństwa cyfrowego wpływające na firmową sieć. NDR, EDR oraz SIEM uzupełniają się, tworząc kompletny system ochronny, uwzględniający każdy aspekt infrastruktury sieciowej przedsiębiorstwa. Ich połączenie określa się mianem „triady widzialności w centrach operacji bezpieczeństwa SOC”.

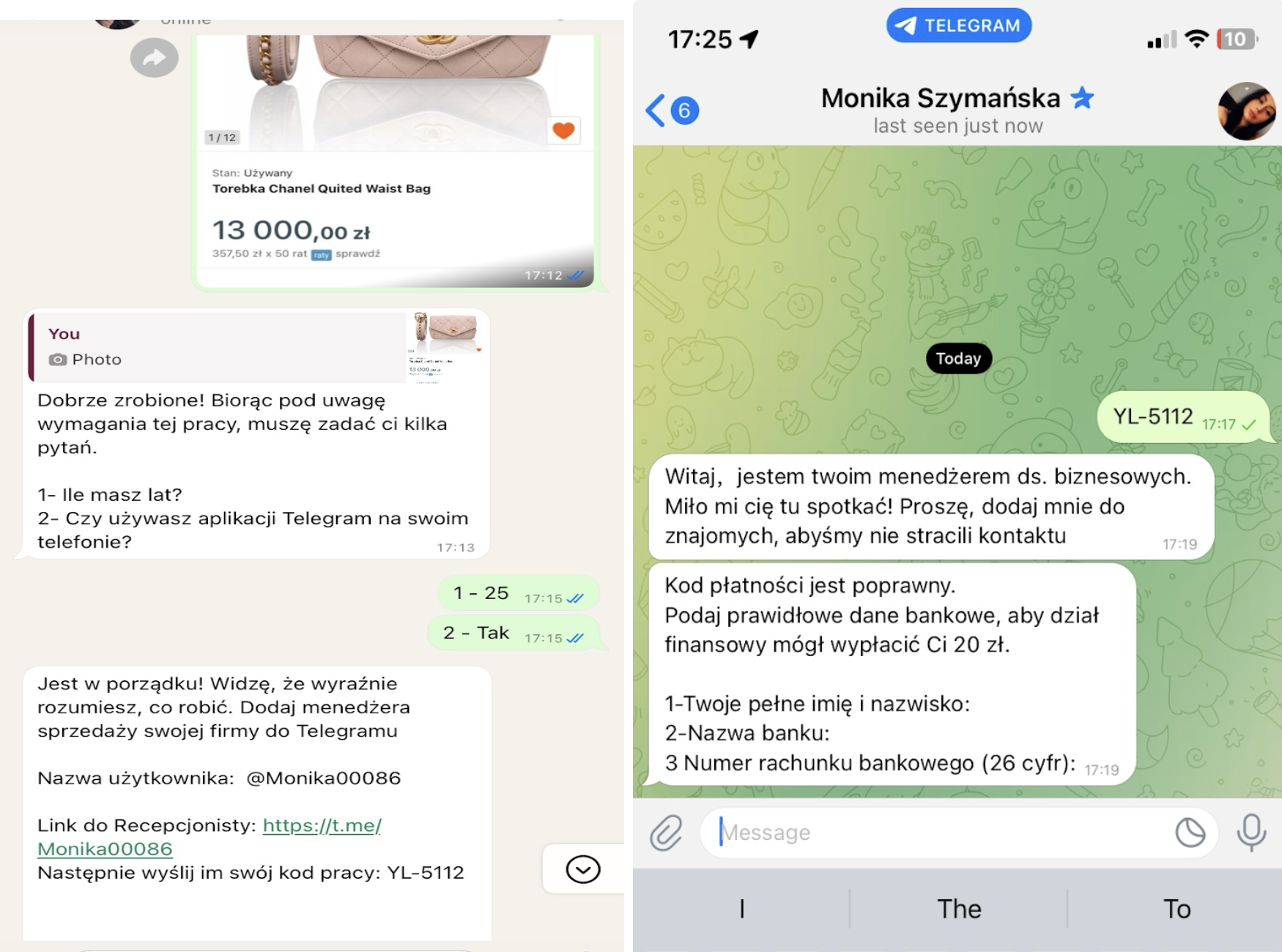

Uwaga na fałszywe telefony

Indywidualni użytkownicy także mogą paść ofiarą cyberataku. Popularność zyskuje m.in. vishing wspierany systemami sztucznej inteligencji.

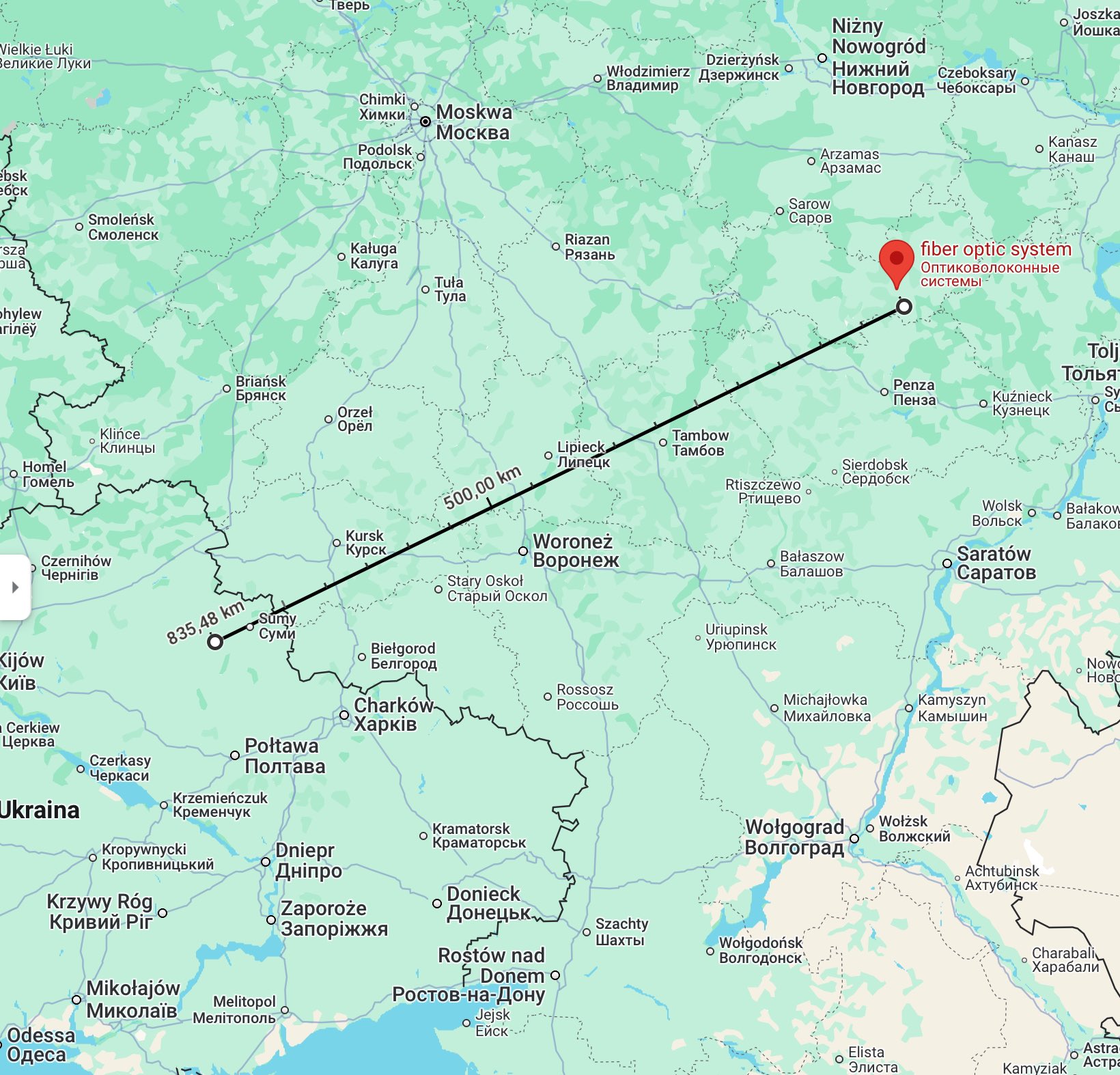

W tradycyjnych atakach vishingowych przestępcy kontaktują się telefonicznie z potencjalnymi ofiarami, podszywając się pod przedstawicieli instytucji finansowych lub urzędów państwowych w celu wyłudzenia wrażliwych danych. Sztuczna inteligencja umożliwia im jednak modyfikację tej techniki. Przestępcy mogą obecnie generować wypowiedzi o dowolnej treści, wypowiadane przez dowolną osobę – pod warunkiem, że są w posiadaniu jej próbki głosu. Ataki tego typu stają się szczególnie niebezpieczne w połączeniu z tzw. spoofingiem. Polega on na fałszowaniu wyświetlanego numeru telefonu w celu podszywania się pod inny podmiot lub osobę. W praktyce oznacza to więc, że przestępca jest w stanie zadzwonić do swojej ofiary z numeru, który wygląda jak ten należący do jej bliskiej osoby, a następnie przemówić jej głosem.

![Weekendowa Lektura: odcinek 618 [2025-04-06]. Bierzcie i czytajcie](https://zaufanatrzeciastrona.pl/wp-content/uploads/2024/02/library.jpg)

![Sprawdzam Gemini Live. Takiego AI aż chce się używać [OPINIA]](https://static.android.com.pl/uploads/2025/04/google-gemini-live-3-1280x853.jpg)

![Polski wydawca gasi pożar w związku z dochodzeniem względem gry Schedule 1. Przyczyny upatruje w błędnym tłumaczeniu [Aktualizacja]](https://www.gry-online.pl/i/h/22/481819069.jpg)

![Znajomi i sąsiedzi (2025) - recenzja premiery serialu [Apple]. Walić obrzydliwie bogatych!](https://pliki.ppe.pl/storage/936a2dfc4f0d5be2dfe5/936a2dfc4f0d5be2dfe5.jpg)

![Dorastanie na Marsie [niepublikowany nigdzie indziej fragment książki]](https://naukatolubie.pl/app/uploads/2025/03/Niespokojnepokolenie_blog.png)

![Siedem dekad wojny z bliska [RELACJA Z KOREI]](https://cdn.defence24.pl/2025/04/12/1920x1080px/xpZZIxkU5yGCo26F3SvGUZfts7vd9ccCf6sB0FcV.culk.jpg)

![Ali Alkhatib o biurokracji i utopii algorytmów [wywiad]](https://panoptykon.org/sites/default/files/2025-03/pismo-kwestionariusz-nguyen-dang-.jpg)