Scroll-Verbot für unter 16-Jährige? Diese EU-Länder fordern jetzt strikte Grenzen für Social Media

Frankreich, Spanien und Griechenland fordern strengere Jugendschutzmaßnahmen für digitale Plattformen. Ihr Plan: Altersgrenzen, Geräte-Checks und eine radikale Umgestaltung von Feeds. Der Druck auf Tech Player wächst.

Während Millionen Kinder täglich durch algorithmisch kuratierte Inhalte auf TikTok, Instagram und YouTube scrollen, steigt in Europa und darüber hinaus die Sorge um deren psychische Gesundheit. Frankreich, Spanien und Griechenland fordern deshalb tiefgreifende regulatorische Maßnahmen, die weit über bisherige Plattformrichtlinien hinausgehen. In einem gemeinsamen Vorstoß plädieren die drei Staaten für verpflichtende Altersverifikationen auf allen internetfähigen Endgeräten. Ziel ist es, den Zugang zu sozialen Netzwerken für Minderjährige stärker zu kontrollieren und deren mentale Belastung zu verringern.

France, Spain and Greece are pushing for mandatory age restrictions for users of social networks including Facebook and X, according to a document seen by Bloomberg https://t.co/ux39UqXeV0— Daniel Basteiro (@basteiro) May 15, 2025

Der Bloomberg-Redakteur Daniel Basteiro verweist auf Threads auf die Pläne der drei EU-Länder.

Social-Plattformen im Visier: Europa fordert Verantwortung auf allen Ebenen

Ein Blick auf das Verhalten der Plattformen selbst zeigt: Viele Social-Media-Konzerne gehen nicht nur sorglos mit User-Daten um, sondern ignorieren auch gezielt Hinweise auf problematische Inhalte. Unser Artikel aus September vergangenen Jahres zeigt, wie wenig Schutz junge Nutzer:innen bislang wirklich erfahren.

Verheerender Bericht über Social-Media-Konzerne:

Kaum Schutz und massive Datenspeicherung

Frankreich, Spanien und Griechenland fordern deshalb tiefgreifende regulatorische Maßnahmen, die weit über bisherige Plattformrichtlinien hinausgehen. In einem gemeinsamen Vorstoß plädieren die drei Staaten für verpflichtende Altersverifikationen auf allen internetfähigen Endgeräten. Ziel ist es, den Zugang zu sozialen Netzwerken für Minderjährige stärker zu kontrollieren und deren mentale Belastung zu verringern.

Wie Bloomberg berichtet, richtet sich die Initiative insbesondere gegen Plattformen wie Instagram, TikTok und X. Neben einer verbindlichen Altersgrenze sehen die Vorschläge auch konkrete Eingriffe in das Plattformdesign vor. Frankreichs Präsident Emmanuel Macron betonte im Rahmen der Initiative, soziale Netzwerke seien nachweislich

part of the cause of suffering and mental health problems.

Die psychischen Belastungen junger Nutzer:innen, so die Argumentation, resultieren nicht allein aus der Nutzung, sondern aus der gezielten Gestaltung digitaler Erlebnisse, die auf maximale Aufmerksamkeit ausgelegt sind.

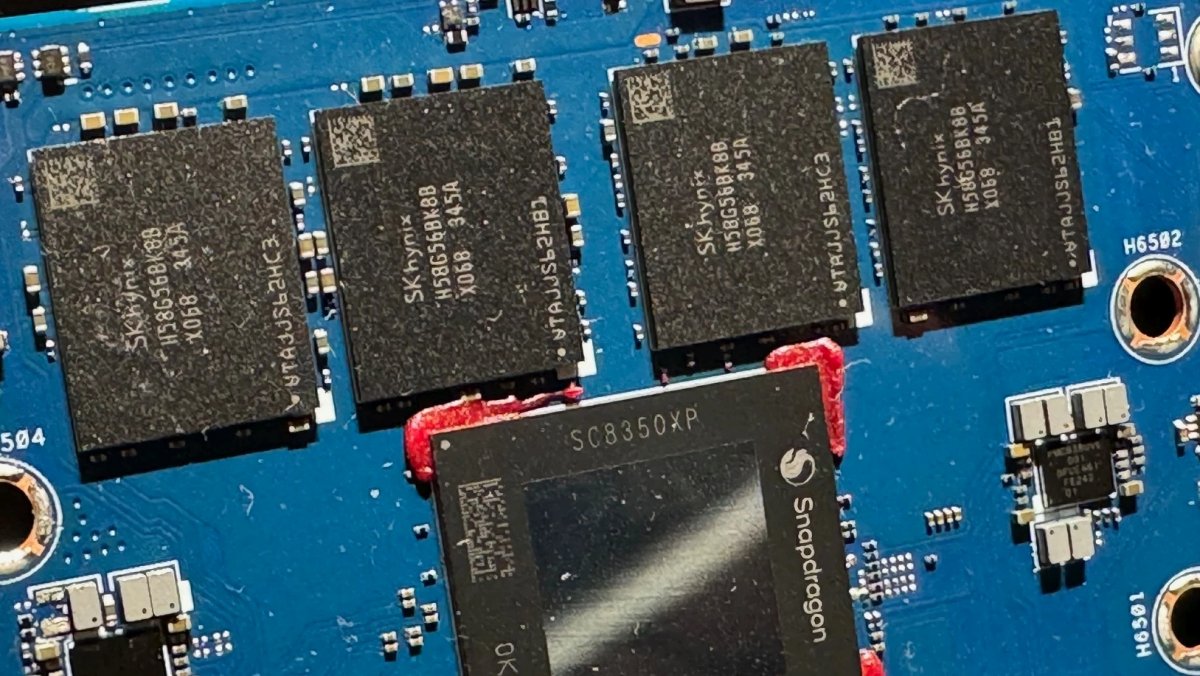

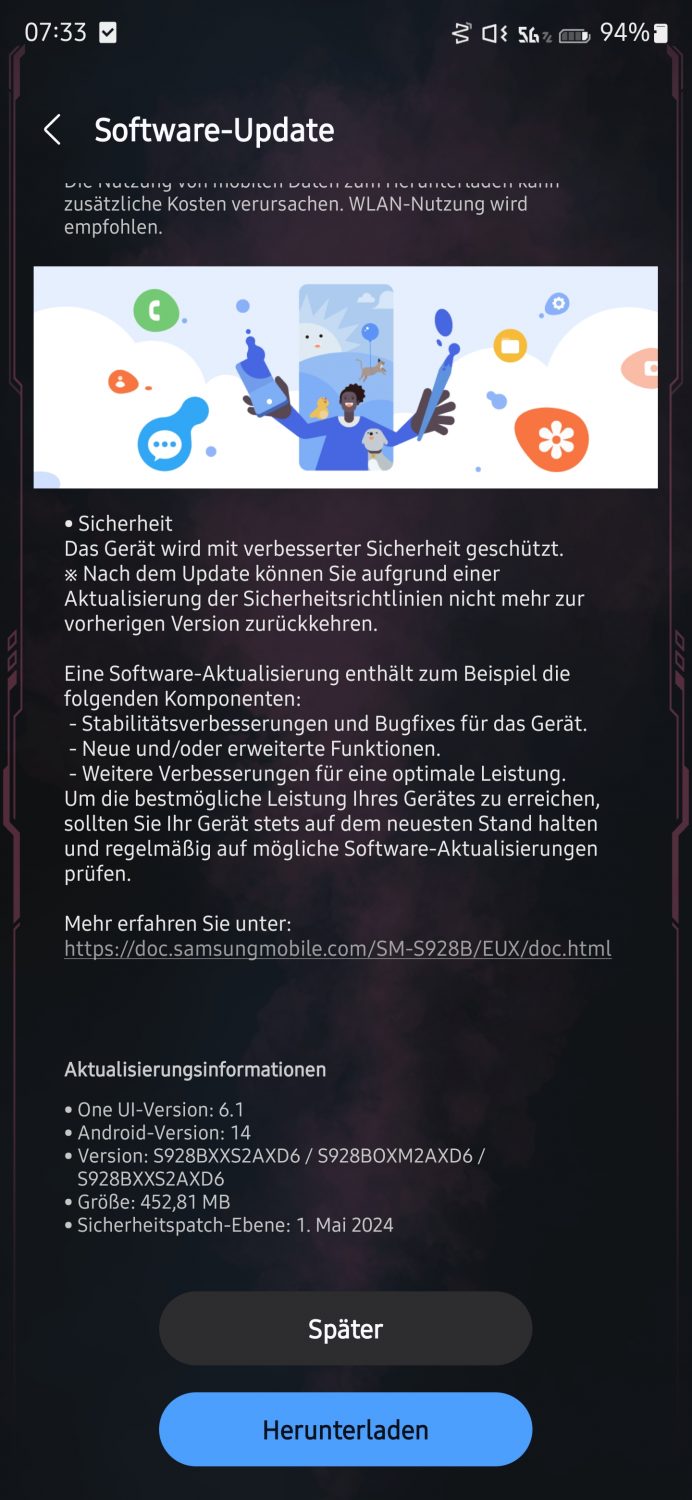

Auffällig ist: Die Forderungen betreffen nicht nur die Betreiber:innen der Plattformen, sondern auch die Hersteller:innen von Smartphones, Tablets und Laptops. Diese sollen künftig technische Voraussetzungen schaffen, um Altersverifikationen direkt auf Geräteebene zu ermöglichen. Generell markiert der Vorstoß einen Paradigmenwechsel in der europäischen Digitalpolitik – weg von freiwilligen Selbstverpflichtungen, hin zu gesetzlich verankerter Verantwortung entlang der gesamten digitalen Infrastruktur.

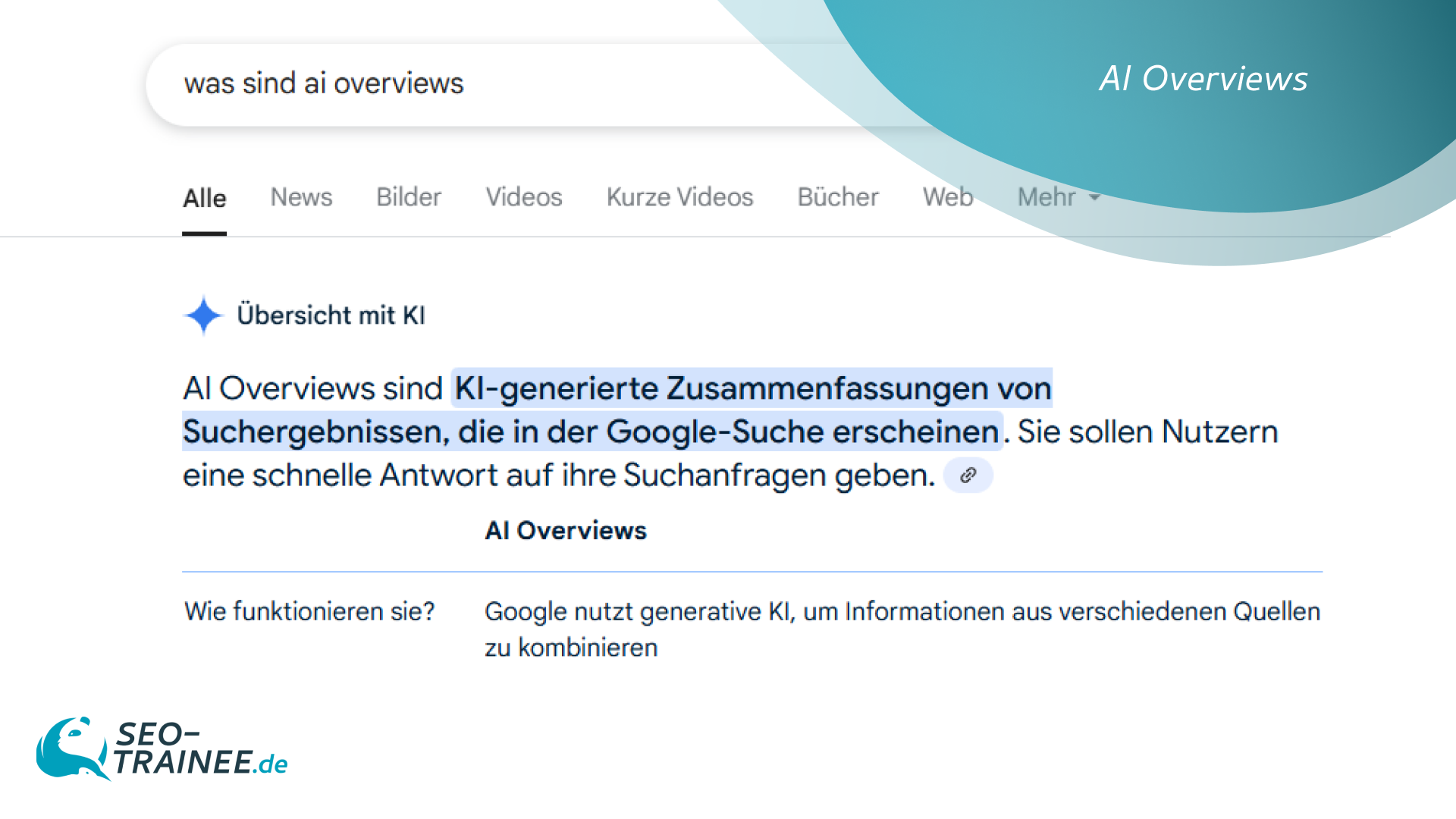

Algorithmisches Design unter Beobachtung: Feed, Pop-up und Autoplay im Fokus

Zentraler Kritikpunkt der europäischen Initiative ist die bewusste Gestaltung sozialer Plattformen. Funktionen wie personalisierte Feeds, Autoplay-Videos und algorithmisch getriebene Empfehlungssysteme werden zunehmend als Risikofaktoren eingestuft. Denn sie begünstigen ein langanhaltendes, teils zwanghaftes Nutzungsverhalten.

Insbesondere Kinder und Jugendliche sind anfällig für diese Mechanismen. Studien legen nahe, dass die permanente Verfügbarkeit von Inhalten, kombiniert mit Feedback-Systemen wie Likes und Shares, das emotionale Wohlbefinden negativ beeinflussen kann. Eine Studie der DAK, die auf ZDF.de thematisiert wird, zeigt, dass rund 680.000 Kinder und Jugendliche in Deutschland bereits als medienabhängig gelten – mit wachsender Tendenz. Auch das Bundesgesundheitsministerium warnt vor den Folgen übermäßiger Internetnutzung: Digitale Medien können zur Sucht werden, insbesondere bei jungen Menschen, die sich in einer emotional sensiblen Entwicklungsphase befinden.

Internationale Vorbilder: Australien geht mit gutem Beispiel voran

Der europäische Vorstoß ist kein Einzelfall. Weltweit mehren sich die Stimmen, die einen restriktiveren Umgang mit sozialen Medien für Kinder und Jugendliche fordern. Australien gehört dabei zu den Vorreitenden: Die Regierung hat bereits ein Gesetz verabschiedet, das Kindern und Jugendlichen unter 16 Jahren den Zugang zu sozialen Medien untersagt. Es soll ab Dezember 2025 in Kraft treten. Über die Pläne Australiens, dieses Gesetz zu verabschieden, haben wir Ende November 2024 berichtet. Mehr dazu im Artikel.

Präzedenzfall:

Australien beschließt Social-Media-Verbot für Kinder

Auch in Deutschland wird über mögliche Altersbeschränkungen für Social Media diskutiert. Bisher bleibt die Debatte jedoch weitgehend unverbindlich. Klare gesetzliche Vorgaben fehlen, ebenso wie ein gemeinsamer Plan für die Umsetzung technischer Schutzmechanismen.

Australien als Vorbild:

Mehrheit in Deutschland befürwortet Social-Media-Verbot für Kinder unter 16 Jahren

Wie reale Fälle und fiktive Dramen die Herausforderungen und Dringlichkeit einer Regulierung verdeutlichen

Die Netflix-Serie Adolescence zeigt auf drastische Weise, wie soziale Medien zur Eskalation psychischer Belastungen bei Jugendlichen beitragen können. Die Geschichte des 13-jährigen Jamie, der zum Täter wird und durch Cybermobbing und dem Konsum verstörender Inhalte Instabilität erlebt, macht die realen Risiken greifbar. Die Serie beleuchtet, wie Inhalte aus der „Manosphere“ und algorithmisch verstärkte Beiträge auf TikTok und Instagram zu verzerrten Selbstbildern und psychischer Überforderung führen können, berichtet unter anderem The Times. In Großbritannien hat Adolescence politische Reaktionen ausgelöst – etwa durch den Parent Pact, über den The Guardian berichtet, der ein Smartphone-Mindestalter fordert.

Ein reales Beispiel, das diese Risiken tragisch verdeutlicht, ist der Suizid der 14-jährigen Molly Russell. Davon hat ebenfalls The Guardian berichtet. Sie konsumierte über Monate hinweg tausende Beiträge zu Suizid und Selbstverletzung auf Instagram und Pinterest. Ein:e britische:r Gerichtsmediziner:in kam zu dem Schluss, dass diese Inhalte erheblich zu ihrem Tod beigetragen haben.

Der Fall sorgte international für Aufmerksamkeit und führte in Großbritannien zur Verabschiedung des Online Safety Act – ein Beispiel dafür, wie kulturelle Impulse und Einzelfälle politische Prozesse in Gang setzen können.

Neue Regeln für eine veränderte digitale Kindheit

Die Initiative von Frankreich, Spanien und Griechenland verdeutlicht den politischen Willen, Social-Media-Plattformen stärker zu regulieren. Altersverifikation, Einschränkungen algorithmischer Funktionen und eine veränderte Verantwortung für Gerätehersteller:innen könnten die europäische Digitallandschaft nachhaltig verändern.

Noch ist unklar, wie weit die Vorschläge in der EU tragen. Doch die Richtung ist gesetzt: Kinder und Jugendliche sollen künftig nicht mehr alleine dem Einfluss kommerziell optimierter Plattformen ausgesetzt sein. Stattdessen rückt der Schutz mentaler Gesundheit ins Zentrum politischer Gestaltung.

Für Plattformen, Marken und politische Akteur:innen bedeutet das: Der Umgang mit jungen Nutzer:innen ist keine Designfrage mehr, sondern eine gesellschaftliche Verantwortung.

![Deals: OLED, aber anders! - Kein anderer OLED-TV ist wie dieser Samsung zum Tiefstpreis [Anzeige]](https://images.cgames.de/images/gamestar/4/titelbild-samsung-s95d-oled-tv77-zoll-großer-fernseher-abverkauf_6354328.jpg?#)

![Deals: Neuer Saugroboter-Hammer - Brutale Leistung, super Ausstattung - und das so günstig? [Anzeige]](https://images.cgames.de/images/gamestar/4/dreame-l40s-pro-ultra-neuer-saugroboter-wischfunktion-station-bester-saugroboter-preis-leistung-2025-roborock-alternative-_6354002.jpg?#)

:quality(80)/p7i.vogel.de/wcms/29/81/2981228e15e6c04bbc02519fb0e88d4a/0124646314v2.jpeg?#)

:quality(80)/p7i.vogel.de/wcms/d6/ad/d6ad92d26fb0cbb63373ef6ab8f0d5dc/0124726936v2.jpeg?#)

:quality(80)/p7i.vogel.de/wcms/3c/90/3c90dae1bd8ace95abb861d64a28591a/0124726749v1.jpeg?#)

:quality(80)/p7i.vogel.de/wcms/8a/fe/8afe405b9e0c706205333d2a6f2a04d6/0124568746v2.jpeg?#)