Allarme FBI: preoccupanti attacchi deepfake audio e campagne di phishing

Campagne di phishing con deepfake audio colpiscono funzionari e cittadini. L'FBI consiglia cautela con messaggi vocali sospetti.

La crescente minaccia dei deepfake vocali sta scuotendo il settore della sicurezza informatica, tanto da spingere l’FBI a emettere un allarme ufficiale per sensibilizzare su un fenomeno sempre più sofisticato e pericoloso.

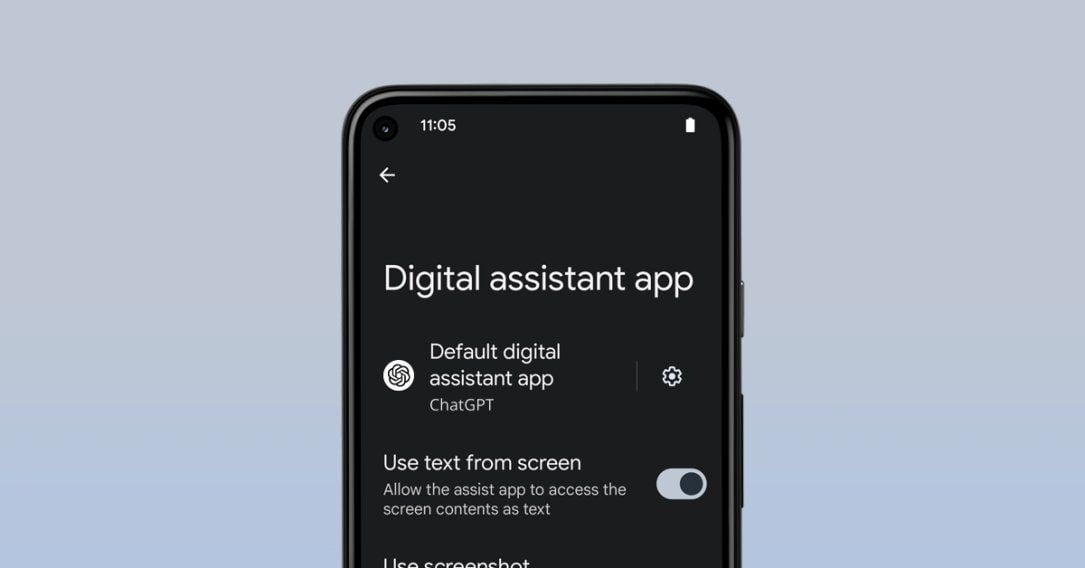

Questa tecnica, che utilizza audio generato dall’AI, è stata sfruttata in una campagna fraudolenta mirata a impersonare funzionari governativi americani. L’obiettivo? Diffondere malware e accedere a dati sensibili attraverso una combinazione di comunicazioni vocali e testuali che imitano perfettamente le caratteristiche delle vittime designate.

Attiva da aprile 2025, questa operazione criminale ha preso di mira principalmente funzionari federali e statali, sia in servizio che in pensione, estendendosi anche ai loro contatti personali. Gli attaccanti utilizzano messaggi vocali falsificati per instaurare fiducia, invitando poi le vittime a spostare la conversazione su piattaforme alternative. Successivamente, tramite link apparentemente innocui, compromettono i dispositivi delle vittime, ottenendo così accesso a informazioni riservate.

I deepfake audio sono utilizzati per diffondere malware

La portata di queste frodi informatiche non è isolata. Nel 2024, ad esempio, la piattaforma LastPass è stata vittima di un attacco simile, dove una telefonata deepfake imitava la voce del CEO dell’azienda. In un altro caso, una campagna di chiamate automatiche con la riproduzione della voce del presidente americano Joe Biden è stata usata per manipolare elettori nel New Hampshire. Questi episodi sottolineano quanto sia urgente un’azione collettiva per contrastare queste minacce.

Secondo gli esperti, il successo di queste campagne malevole è dovuto alla capacità dei criminali di sfruttare le tecnologie avanzate relative all’AI per creare contenuti audio che appaiono autentici anche agli ascoltatori più attenti. La tecnologia ha raggiunto un livello tale da rendere quasi impossibile distinguere tra una voce reale e una contraffatta, mettendo in discussione la fiducia nelle comunicazioni vocali tradizionali.

Per difendersi, l’FBI raccomanda un approccio scettico verso qualsiasi comunicazione che richieda azioni immediate, come cliccare su link o fornire dati personali. È essenziale verificare l’autenticità dei messaggi attraverso canali ufficiali alternativi. La collaborazione tra istituzioni governative, aziende tecnologiche e cittadini consapevoli è fondamentale per mitigare i rischi associati a queste nuove forme di phishing e altre attività fraudolente.

.jpg)

/https://www.html.it/app/uploads/2025/05/flux_image_552038_1747389185.jpeg)

/https://www.html.it/app/uploads/2025/05/altman-openai.jpg)

/https://www.html.it/app/uploads/2025/04/gmail-newsletter.jpg)